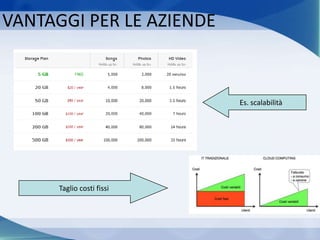

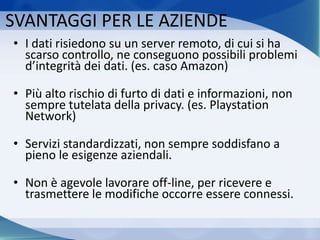

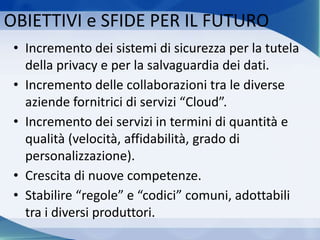

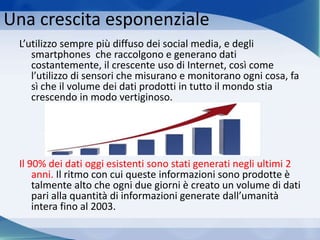

Il documento tratta l'importanza crescente del cloud computing e dei big data, evidenziando come aziende e servizi online sfruttino queste tecnologie per migliorare l'efficienza e ridurre i costi. Vengono discussi vantaggi e svantaggi per utenti e aziende, con focus su aspetti come sicurezza, privacy e accessibilità dei dati. Infine, si esplorano le sfide future e il ruolo vitale dei data scientist nel gestire e analizzare grandi volumi di informazioni.