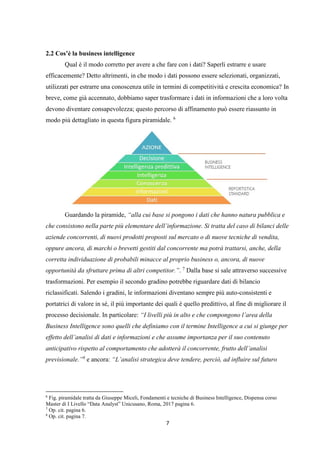

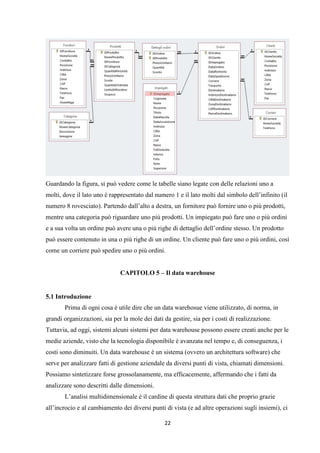

Il documento tratta dell'importanza del data warehouse nella business intelligence e descrive le metodologie per trasformare i dati in informazioni utili per le decisioni aziendali. Viene analizzato il ruolo dei big data e della business intelligence, evidenziando la necessità di un approccio sistematico nella gestione delle informazioni. Inoltre, si discutono le componenti tecniche e le linee guida per un efficace progetto di data warehouse.