2019/9/25-6に開催されたUnite Tokyo 2019の講演スライドです。

竹原 涼(株式会社セガゲームス)

山田 英伸(株式会社セガゲームス)

こんな人におすすめ

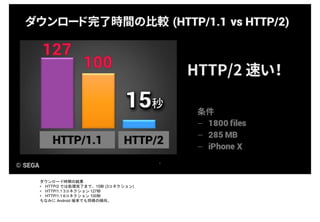

・アセットのダウンロード時間を短縮したいと思っているプログラマ

・HTTP/2 通信に興味を持っているプログラマ

受講者が得られる知見

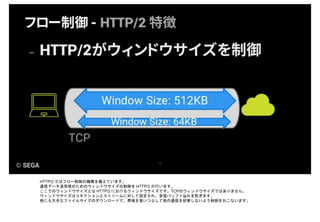

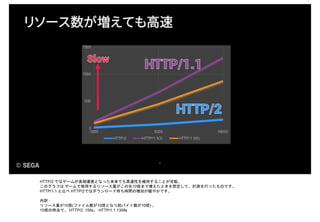

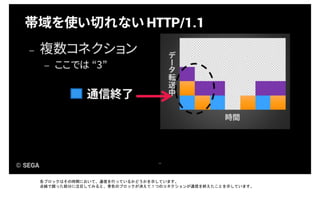

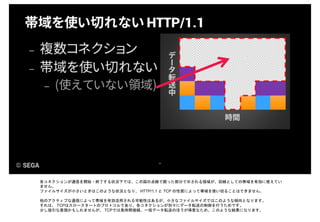

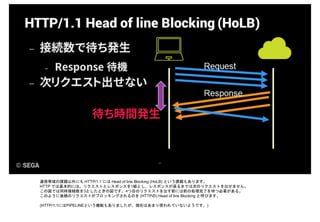

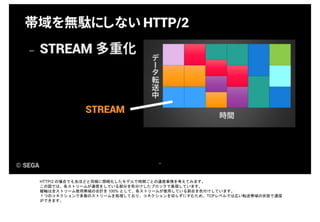

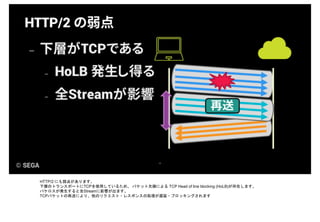

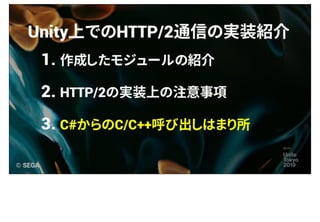

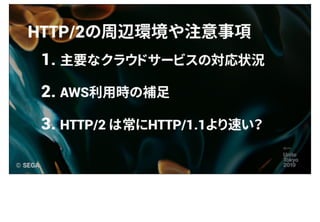

・ アセットダウンロードに効果的な HTTP/2通信の概要

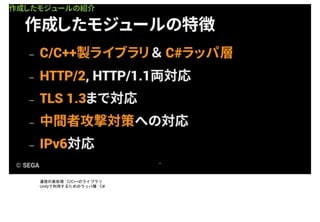

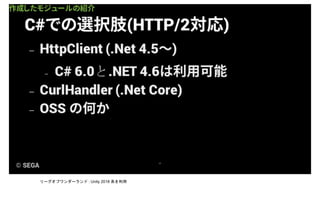

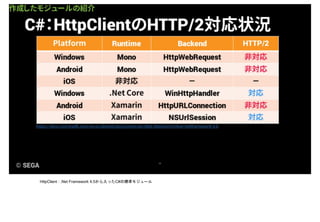

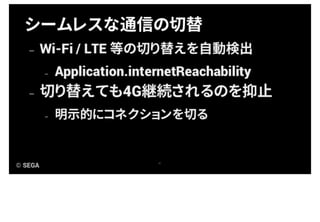

・Unity上での HTTP/2通信の実装事例

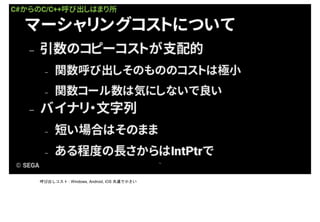

・ネイティブプラグイン(C/C++)の実装事例

Unityのイベント資料はこちらから:

https://www.slideshare.net/UnityTechnologiesJapan/clipboards