More Related Content

PDF

PDF

ユークリッド距離以外の距離で教師無しクラスタリング PDF

行列およびテンソルデータに対する機械学習(数理助教の会 2011/11/28) PDF

PDF

PDF

ZIP

PDF

パターン認識 第12章 正則化とパス追跡アルゴリズム What's hot

PDF

パターン認識と機械学習 §6.2 カーネル関数の構成 PDF

Infinite SVM - ICML 2011 読み会 PDF

PDF

PDF

PDF

PDF

PDF

PDF

整数格子点上の劣モジュラ被覆に対する高速アルゴリズム PDF

PDF

Integrating different data types by regularized unsupervised multiple kernel... PDF

PDF

最近傍探索と直積量子化(Nearest neighbor search and Product Quantization) PDF

PDF

機械学習による統計的実験計画(ベイズ最適化を中心に) PDF

クラシックな機械学習の入門 6. 最適化と学習アルゴリズム PPTX

Viewers also liked

ODP

PDF

PDF

PDF

PDF

PDF

正則化つき線形モデル(「入門機械学習第6章」より) PPTX

PDF

Logistic Regression Analysis PDF

PPTX

PDF

スパースモデリング、スパースコーディングとその数理(第11回WBA若手の会) PDF

Similar to Ml ch7

ODP

PPTX

PDF

20190721 gaussian process PPTX

PDF

PDF

PPTX

PPTX

Machine Learning Seminar (1) PDF

PPTX

PDF

サポートベクターマシン(SVM)の数学をみんなに説明したいだけの会 PPTX

PDF

【Zansa】第12回勉強会 -PRMLからベイズの世界へ PPTX

More from Ryo Higashigawa

PDF

TypeScript で型を上手く使う試み.pdf PPTX

PPTX

AWS を始める時に気をつけるべき課金周りの仕組みと設定.pptx PPTX

``完璧に理解した``WEB の裏側の仕組み.pptx PPTX

PPTX

ODP

これからはじめるための JavaScript 開発環境 ODP

Ml ch7

- 1.

- 2.

- 3.

- 4.

- 5.

- 6.

- 7.

- 8.

- 9.

- 10.

- 11.

- 12.

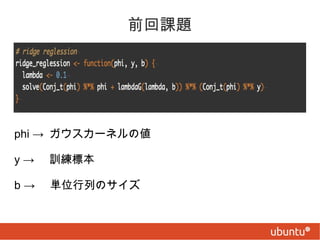

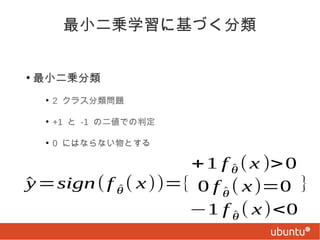

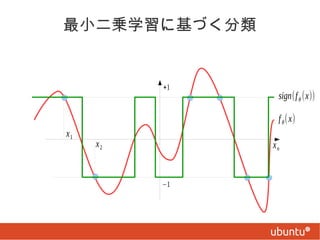

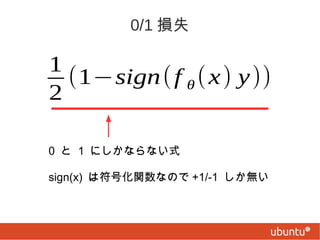

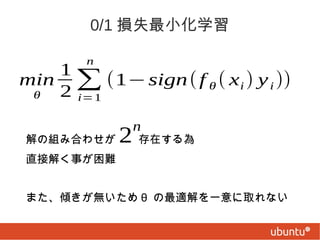

0/1 損失最小化学習

n

1

min ∑(1− sign ( f θ ( x i ) y i ))

2 i=1

θ

2

n

解の組み合わせが 存在する為

直接解く事が困難

また、傾きが無いため θ の最適解を一意に取れない

- 13.

- 14.

- 15.

- 16.

- 17.

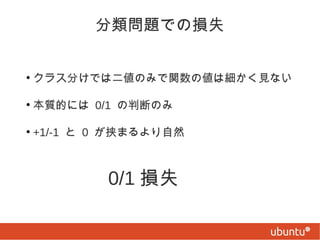

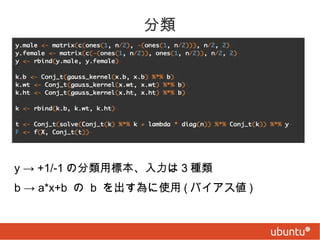

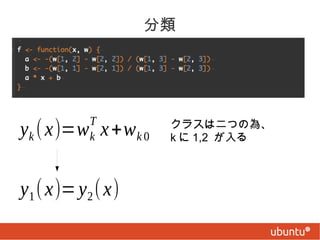

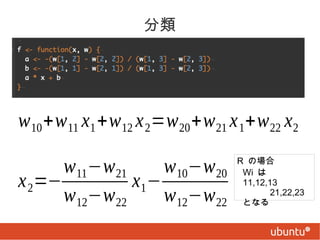

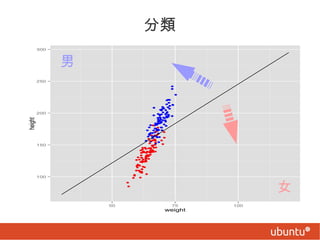

分類

w 10 +w11 x1 +w 12 x 2=w 20 +w 21 x 1+w 22 x2

w 11−w 21

w 10−w 20

x 2=−

x1−

w 12−w 22

w 12−w 22

R の場合

Wi は

11,12,13

21,22,23

となる

- 18.

- 19.

- 20.