Analisis Regresi

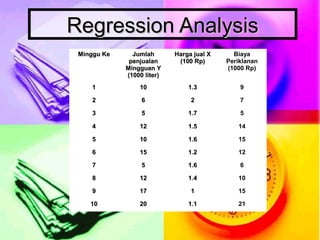

- 1. Regression AnalysisRegression Analysis Minggu KeMinggu Ke JumlahJumlah penjualanpenjualan Mingguan YMingguan Y (1000 liter)(1000 liter) Harga jual XHarga jual X (100 Rp)(100 Rp) Biaya Periklanan (1000 Rp) 11 1010 1.31.3 9 22 66 22 7 33 55 1.71.7 5 44 1212 1.51.5 14 55 1010 1.61.6 15 66 1515 1.21.2 12 77 55 1.61.6 6 88 1212 1.41.4 10 99 1717 11 15 1010 2020 1.11.1 21

- 4. Regression AnalysisRegression Analysis Penjualan = 16.406 – 8.248 Hargajual + 0.585 Biayaiklan = - 0.490 Hargajual + 0.571 Biayaiklan sig (0.007) (0.007) (0.003)

- 5. Regression AnalysisRegression Analysis MULTIKOLINEARITAS.MULTIKOLINEARITAS. 1. R. Square yang tinggi tapi uji t sedikit yang signifikan1. R. Square yang tinggi tapi uji t sedikit yang signifikan 1. Terdapat koefisien korelasi antar var independen yang tinggi c

- 6. MULTIKOLINEARITAS.MULTIKOLINEARITAS. 3. Eigenvalue dan Condition Index (CI) Rule of the thumb: CI :10 sd 31,62 ---- multicol moderat sd kuat : di atas 31,62 --- multicol sangat kuat Model ini mengadung 4 dimensi dengan CI = 228.441 jadi > 31.62 shg terdapat molticol sangat kuat

- 7. MULTIKOLINEARITAS.MULTIKOLINEARITAS. 4.Tolerance (TOL) dan Variance Inflation Factor (VIF) Nilai ukuran TOL dan VIF menunjukan besaran suatu var independen terpilih tidak dapat dijelaskan atau dapat dijelaskan melalui var independen yang lain layaknya seperti R square. Rumus : TOLj = 1/VIFj = ( 1 – R2j ) 1. nilai TOL = 0 terdapat perfect collinearity (multikollinearitas sempurna), 2. nilai TOL = 1 tidak terdapat multikollinearitas. Umumnya pada nilai TOL = 0.1 (atau nilai VIF= 10) telah dicurigai adanya multikollinearitas, 3. semakin mendekati NOL nilai TOL (atau nilai VIF semakin besar) semakin kuat multikollinearitasnya. 4. Sayangnya alat ini tidak dapat menunjukan variabel independen mana yang multikol terutama bila var independennya cukup banyak.

- 8. MULTIKOLINEARITAS.MULTIKOLINEARITAS. Dalam kasus ini TOL pendpt = 0.001 lebih mendekati angka NOL dari pada mendekati angka SATU maka, model ini terdapat multikollinearitas demikian pula untuk TOL kekayaan = 0.001. Kita juga dapat melihat dari VIF pendptan = 702.008 dan VIF kekayaan = 699.722 yang besar dan VIF jmlkeluarg yang rendah yaitu 1.460

- 9. MULTIKOLINEARITAS.MULTIKOLINEARITAS. Perbaikan Masalah Multikollinearitas Apakah yang dapat kita lakukan bila terdapat multikollinearitas yang serius ? Kita mempunyai dua pilihan yaitu : 1. Dibiarkan saja 2. Lakukan beberapa hal di bawah ini yang paling tepat dengan model anda Kita dapat menggunakan model regresi yang mengandung multikol asalkan hanya untuk prediksi bukan untuk menginterpretasikan koefisien regresi yang ada, karena pada prediksi/peramalan yang penting adalah adanya kesalahan yang kecil.

- 10. Perbaikan Masalah Multikollinearitas a.Informasi Apriori Katakanlah kita mempunyai model sebagai berikut : Y = β0 + β1 X1+ β2 X2+ µ Dimana Y = Konsumsi, X1 = pendapatan dan X2 = Kekayaan X1 dan X2 multikol, bila dari teori ekonomi atau penelitian sebelumnya terdapat informasi bahwa tingkat perubahan Y sebagai akibat perubahan X1 adalah 0,10 kali perubahan Y sebagai akibat tingkat perubahan X2 atau β1= 0,10 β2 , sehingga persamaan diatas dapat kita tuliskan kembali sebagai berikut : Y = β0 + 0,10 β2 X1+ β2 X2+ µ atau Y = β0 + β2 (0,10 X1+ X2) + µ, kalau misalkan (0,10 X1+ X2) = X3, maka model menjadi Y = β0 + β2 X3 + µ, bila β2 , dapat dihitung maka β1 dapat diketahui dimana β1= 0,10 β2 . Contoh: YY X1X1 X2X2 X3=0.10X1 +X3=0.10X1 + X2X2 7070 8080 810810 818818 6565 100100 10091009 10191019 9090 120120 12731273 12851285

- 11. Perbaikan Masalah Multikollinearitas b. Menggabungkan antara data cross-sectional dan data time-series c. Mengeluarkan satu atau lebih variabel independen dengan korelasi yang tertinggi terutama yang mempunyai koeffisien regresi terendah. Persamaan regresi yang ada dari model kita adalah : Y = 3.751 X1 -2.761 X2 -0.158 KL Sig (0.047) (0.116) (0.062) Koeffisien Korelasi antara kekayaan dan pendapatan sebesar -0.999, maka ditempat ini terdapat multikollinearitas yang tinggi. Oleh karena itu kita dapat mengeluarkan variabel kekayaan karena tidak sig dan mempunyai koeffisien regresi yang laebih kecil dari variabel pendapatan. Pengedropan (mengeluarkan) ini dapat menyebabkan terjadinya misspecifikasi model (kita kehilangan suatu variabel yang seharusnya ada dalam model) d.Transformasi variabel Transformasi dapat dilakukan untuk mengurangi hubungan linear antar variabel independen dengan cara merubah dalam bentuk logaritma natural yaitu X1* = Log X1 atau dengan bentuk beda pertama (first different) yaitu X1* = X1t – X1t-1, hal ini terutama bila data kita adalah data time series. e.Penambahan Data baru f. Gunakan analisa Faktor (lihat pada Analisis Faktor) ; Analisis ridge regression

- 12. UJI HOMOSKEDASTISITASUJI HOMOSKEDASTISITAS Tujuan uji Homoskedastisitas adalah menguji apakah dalam model regresi terdapat kesamaan varian residual satu pengamatan terhadap pengamatan lainnya. Model regresi yang baik adalah yang homoskedastisitas, sebaliknya bila varian residual berbeda disebut : Heteroskedastisitas. Pada data cross-section kemungkinan adanya heteroskedastisitas besar karena terdiri dari berbagai ukuran (misal perusahaan kecil, menengah, besar) Cara mendeteksi adanya Homoskedastisitas: 1.Metode Informal (misal : Metode Graphik) 2.Metode Formal (misal : uji Park; uji dari White; Uji Glejser; Uji Rank korelasi dll)

- 13. Cara mendeteksi adanya Homoskedastisitas: Methode Graphik Metode ini mengambarkan titik-titik yang memuat nilai var dependen ramalan yang distandarisasi (ZPRED) dengan nilai residual (SRESID) Ambil data ujilinear.sav dengan bentuk persamaan Y = b0 + b1X1+ b2 X21 + e, kita akan uji ada atau tidak homoskedastisitas. Lakukan langkah- langkah sebagai berikut: 1.Dari menu Analyse, -- Regression, -- Linear, -- Masukkan Y pada kotak Dependent dan X1 dan X21 pada kotak Independent, -- method,pilih Enter, kmd klik kotak Plots, keluar kotak sebagai berikut: masukkan pada kotak Y variabel SRESID dan kotak X variabel ZRED, kmd klik Continue dan OK. Kita akan dapatkan gambar PLOT seperti dibawah ini:

- 15. AUTOKORELASIAUTOKORELASI Bila terjadi korelasi antara residual (kesalahan pengganggu) perode t dengan periode t-1 (sebelumnya) keadaan ini disebut ada masalah Autokorelasi. Hal ini sering muncul karena data yang kita gunakan adalah data time series. Cara Mendeteksi Adanya Autokorelasi: 1.Uji Durbin-Watson (DW test) 2. Uji Box-Ljung Statistic

- 18. Cara memperbaiki adanya autokorelasi:Cara memperbaiki adanya autokorelasi:

- 19. Cara memperbaiki adanya autokorelasi:Cara memperbaiki adanya autokorelasi:

- 20. Cara memperbaiki adanya autokorelasi:Cara memperbaiki adanya autokorelasi:

- 21. Cara memperbaiki adanya autokorelasi:Cara memperbaiki adanya autokorelasi:

- 22. Cara memperbaiki adanya autokorelasi:Cara memperbaiki adanya autokorelasi:

- 23. Cara memperbaiki adanya autokorelasi:Cara memperbaiki adanya autokorelasi:

- 24. Cara memperbaiki adanya autokorelasi:Cara memperbaiki adanya autokorelasi:

- 25. Cara memperbaiki adanya autokorelasi:Cara memperbaiki adanya autokorelasi:

- 26. Cara memperbaiki adanya autokorelasi:Cara memperbaiki adanya autokorelasi: