日曜数学会Vol5 up用 bessel関数

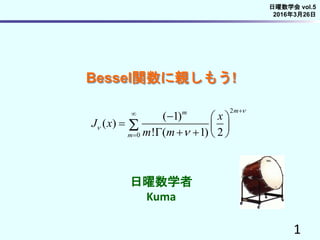

- 1. 1 Bessel関数に親しもう! 日曜数学者 Kuma 日曜数学会 vol.5 2016年3月26日 2 0 ( 1) ( ) ! ( 1) 2 mm m x J x m m

- 2. Agenda 2 1. 自己紹介 2. Bessel関数は難しくない? 3. カメラのレンズとBessel関数 4. LTEもWiMAXもBessel関数~FM変調~

- 4. Bessel関数は難しくない? 4 2 0 ( 1) ( ) ! ( 1) 2 mm m x J x m m 第1種Bessel関数 ( )cos( ) ( ) ( ) lim sin( ) n n n J x n J x Y x n → 第2種Bessel関数 第1種Bessel関数(各νについて) 2 2 2 '' ' ( ) 0x y xy x y Besselの微分方程式 なんか減衰振動っぽい?? なるほど、さっぱりわからん

- 5. Bessel関数は難しくない? 5第1種Bessel関数Jの近似 減衰振動で近似できる 次数は位相の違いだけ 2 2 1 ( ) cos 4 2 2 1 ( ) sin 4 v v J x x x Y x x x ; ; X>>1 漸近展開

- 6. Bessel関数のルーツ 6 太鼓の膜の振幅を解析→Besselの微分方程式に帰着 振幅=0 円対象な波動 がBessel関数の正体 角度の条件⇔ベッセルの次数n 振幅の条件⇔ゼロ点の次数m 𝜆0 𝜆1 𝜆 𝑚 x=L 𝜆 𝑚 , ( ) n m nR J L 2 2 2 2 1 0 R R n R

- 7. 7http://web.tuat.ac.jp/~katsuaki/el/EL2008/slide_hikari04.pdf 2 ( sin ) ( ) sin sin , 1.22 m J ka I ka ka F F w F で暗点と なる 。 カメ ラ の 値を 光波長を と し て 第一暗環半径 𝜃 𝑎 𝑤 種別 記録密 度比 スポット サイズ F値 波長 CD 1 720 nm 0.77 780 nm DVD 1.4倍 600 nm 0.77 650 nm (赤) BD 6.4倍 285 nm 0.59 405 nm (青) カメラのF値とBessel関数

- 8. RRH (増幅機) 局舎 全国へ セクタ2 セクタ1 電波の繋がる仕組み BBU (変調部) SW(ルータ) 伝送装置 F[Hz] FM FM FM ユーザー1 ユーザー2 800 MHz帯 LTE Ether

- 9. 9 FM変調のスペクトルはBessel関数 cos( sin ) ( )cos( )n n m t J m n t http://www11.atwiki.jp/denpaarray/pages/40.html http://www.circuitdesign.jp/jp/technical/modulation/modulation_FM.asp FM変調の例:FMラジオ、通信 中心周波数 高さ=ベッセル 高次 FM FM波形 高次

- 11. 11 太鼓の膜の振動とBessel 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 ( , , ) 1 1 u u t u u u c t x y u u u u c t 極座標 振幅 振幅=0 角度の条件⇔ベッセルの次数n 振幅の条件⇔ゼロ点の次数m x=L 𝜆 𝑚 2 2 2 2 2 2 2 2 2 2 ( ) ( ) ( ) 1 0 u T t R T c T t n R R n R を仮定 , , ( ) cos ( ) cos( ) ( ) n m n m n c T t t L n R J L

- 12. 12 太鼓の膜の振動とBessel http://www.natural-science.or.jp/article/20101108184753.php (n,m)=(0,0) (n,m)=(0,1) (n,m)=(0,2) (n,m)=(1,0) (n,m)=(1,1) (n,m)=(1,2) 叩く場所が対称性を失うと 高次ベッセル関数が出る傾向 中心を叩くと0次ベッセルのみ

- 13. 13 なぜ回折像がベッセル関数になるか 回折像はレンズの開口形状のフーリエ変換となる (フレネル-キルヒホフの公式) 円形の開口関数のフーリエ変換はJ(x)/xである 波面 sin( )kx t ホイヘンスの素元波 ※二次元フーリエ変換を指す

- 14. フレネルーキルヒホフの積分公式 14第 4 章 フレネル・キルヒホッフの回折理論 (東海大) ' 1 ( ) 4 ' , ( , ') ' S jkR jkR S jk e e U U P U n R R n e R W r r r r r r r r が素元波 / nは閉曲面 の法線方向の方向微分 電磁波の空間部分U(x,y,z)はHelmholtz方程式に従う。 Green関数論を用いると R 0 0 0 ' ' ( ) ( ', ') ' ', x y jk x y s s S U P A x y e dx dy A ス ク リ ーンま で( 距離s ) が波長に比べ十分遠いと し て は開口面上の電界振幅 A(x,y)の二次元フーリエ変換! ホイヘンスの原理 の正当化