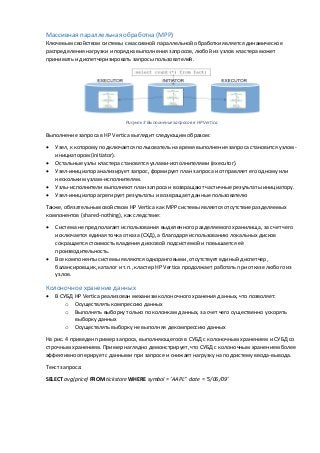

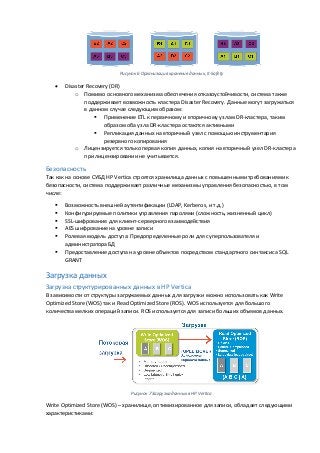

Документ описывает архитектуру и функциональные возможности системы управления базами данных HP Vertica, разработанной для эффективной обработки больших объемов данных с использованием принципов массивной параллельной обработки и колоночного хранения. В нем представлены ключевые аспекты, такие как механизмы загрузки и анализа данных, поддержка интеграции с инструментами бизнес-аналитики, отказоустойчивость и безопасность системы. Также рассматриваются требования к аппаратному обеспечению и администрированию, включая возможности масштабирования и оптимизации производительности.