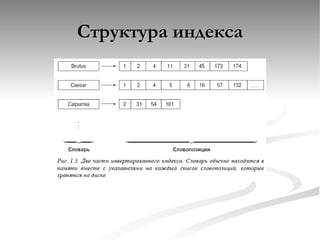

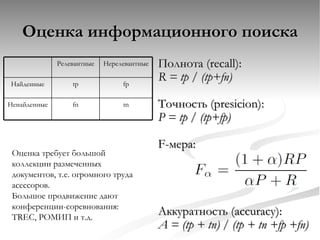

Документ охватывает основы информационного поиска, включая определение, методы индексирования и оценки поисковых систем. Описываются ключевые модели, такие как булева и векторная модели, а также важность автоматической обработки текста. Рассматриваются методы оценки качества поиска, включая полноту, точность и f-меру.