More Related Content

PDF

PDF

テンソル多重線形ランクの推定法について(Estimation of Multi-linear Tensor Rank) PDF

[DL輪読会]Measuring abstract reasoning in neural networks PDF

Large Scale Incremental Learning PDF

PDF

【基調講演】『深層学習の原理の理解に向けた理論の試み』 今泉 允聡(東大) PPTX

PDF

What's hot

PPTX

PDF

PoisoningAttackSVM (ICMLreading2012) PDF

PDF

PDF

PDF

PDF

PDF

PPTX

[DL輪読会]Monaural Audio Source Separationusing Variational Autoencoders PDF

PDF

単語分散表現を用いた多層 Denoising Auto-Encoder による評価極性分類 PPTX

Image net classification with deep convolutional neural network PPT

Deep Auto-Encoder Neural Networks in Reiforcement Learnning (第 9 回 Deep Learn... PPTX

CG Image Recognition with Deep Learning PDF

KDD2014勉強会: Large-Scale High-Precision Topic Modeling on Twitter ODP

Introduction to "Facial Landmark Detection by Deep Multi-task Learning" Viewers also liked

PDF

PDF

PDF

PDF

PDF

エンジニアから飛んでくるマサカリを受け止める心得 PDF

PDF

PDF

Topological data analysis PDF

Tutorial of topological_data_analysis_part_1(basic) PDF

PDF

PDF

Similar to SSA-SOINN

PPTX

Pythonとdeep learningで手書き文字認識 KEY

PDF

PDF

PDF

PFI Christmas seminar 2009 PPTX

PPT

PDF

東京都市大学 データ解析入門 8 クラスタリングと分類分析 1 PDF

オンライン凸最適化と線形識別モデル学習の最前線_IBIS2011 PDF

PDF

PDF

PDF

2007 IEEE ICDM DMC task1 result PDF

PDF

PPTX

PDF

第3回集合知プログラミング勉強会 #TokyoCI グループを見つけ出す PDF

Appendix document of Chapter 6 for Mining Text Data PDF

ACL2011読み会: Query Weighting for Ranking Model Adaptation PDF

Semi-supervised Active Learning Survey Recently uploaded

PDF

エンジニアが選ぶべきAIエディタ & Antigravity 活用例@ウェビナー「触ってみてどうだった?Google Antigravity 既存IDEと... PDF

Machine Tests Benchmark Suite. Explain github.com/alexziskind1/machine_tests #2 PDF

Machine Tests Benchmark Suite. Explain github.com/alexziskind1/machine_tests #1 PDF

20251210_MultiDevinForEnterprise on Devin 1st Anniv Meetup PPTX

楽々ナレッジベース「楽ナレ」3種比較 - Dify / AWS S3 Vector / Google File Search Tool PDF

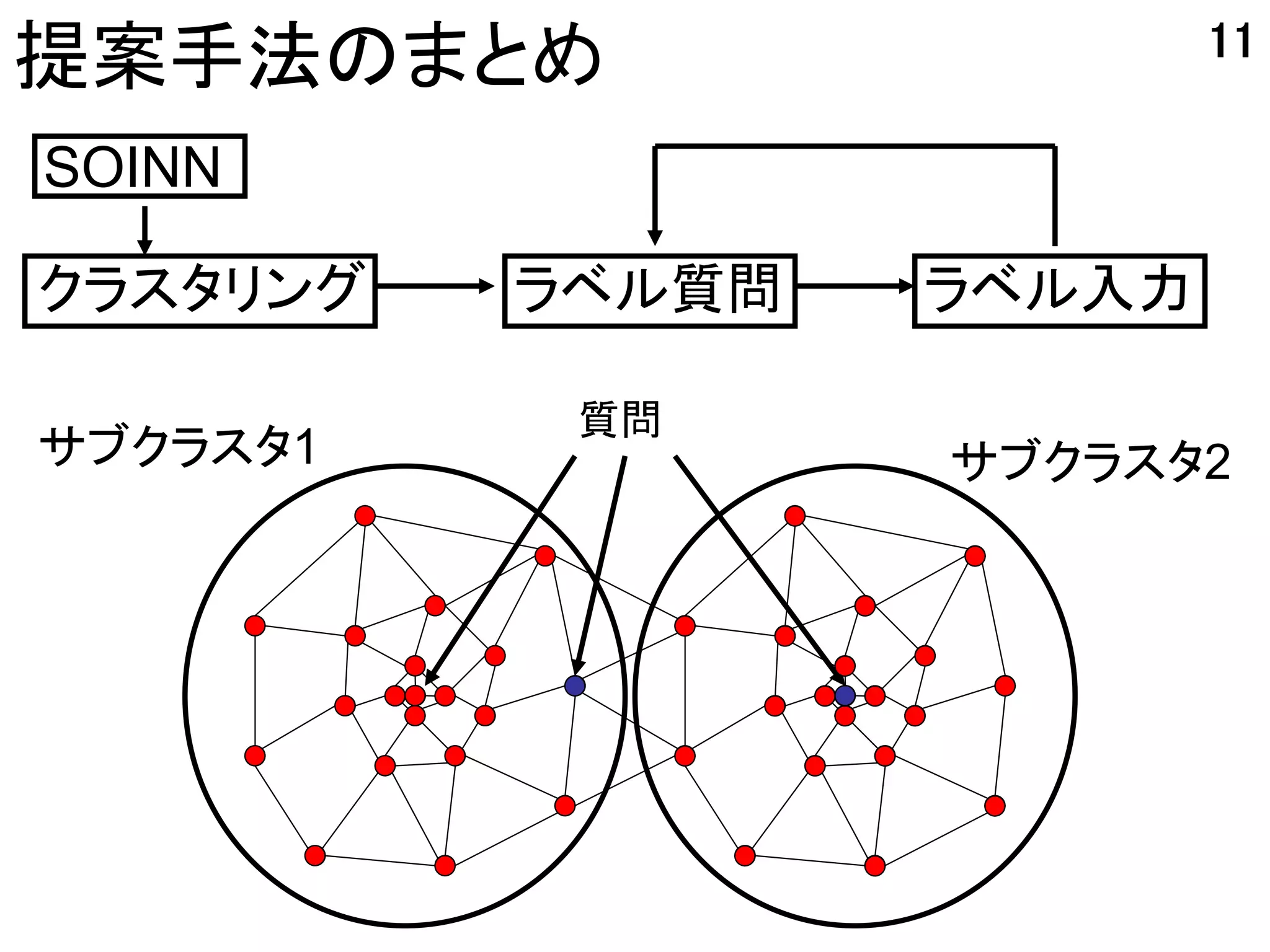

流行りに乗っかるClaris FileMaker 〜AI関連機能の紹介〜 by 合同会社イボルブ SSA-SOINN

- 1.

- 2.

- 3.

2

従来の準教師付き(能動)学習

Generative Model [Nigamet al., 2000]

Co-Training [Blum and Mitchell, 1998], [Muslea et al., 2002]

TSVM [Bennett and Demiriz, 1999]

GRF [Zhu et al., 2003]

・バッチ学習 →膨大なメモリが必要

・クラス数は事前に与える →新しいクラスの追加が困難

実環境には…

膨大な数のデータ

新しい概念(クラス)の発生

オンラインで追加学習可能なシステム

が重要

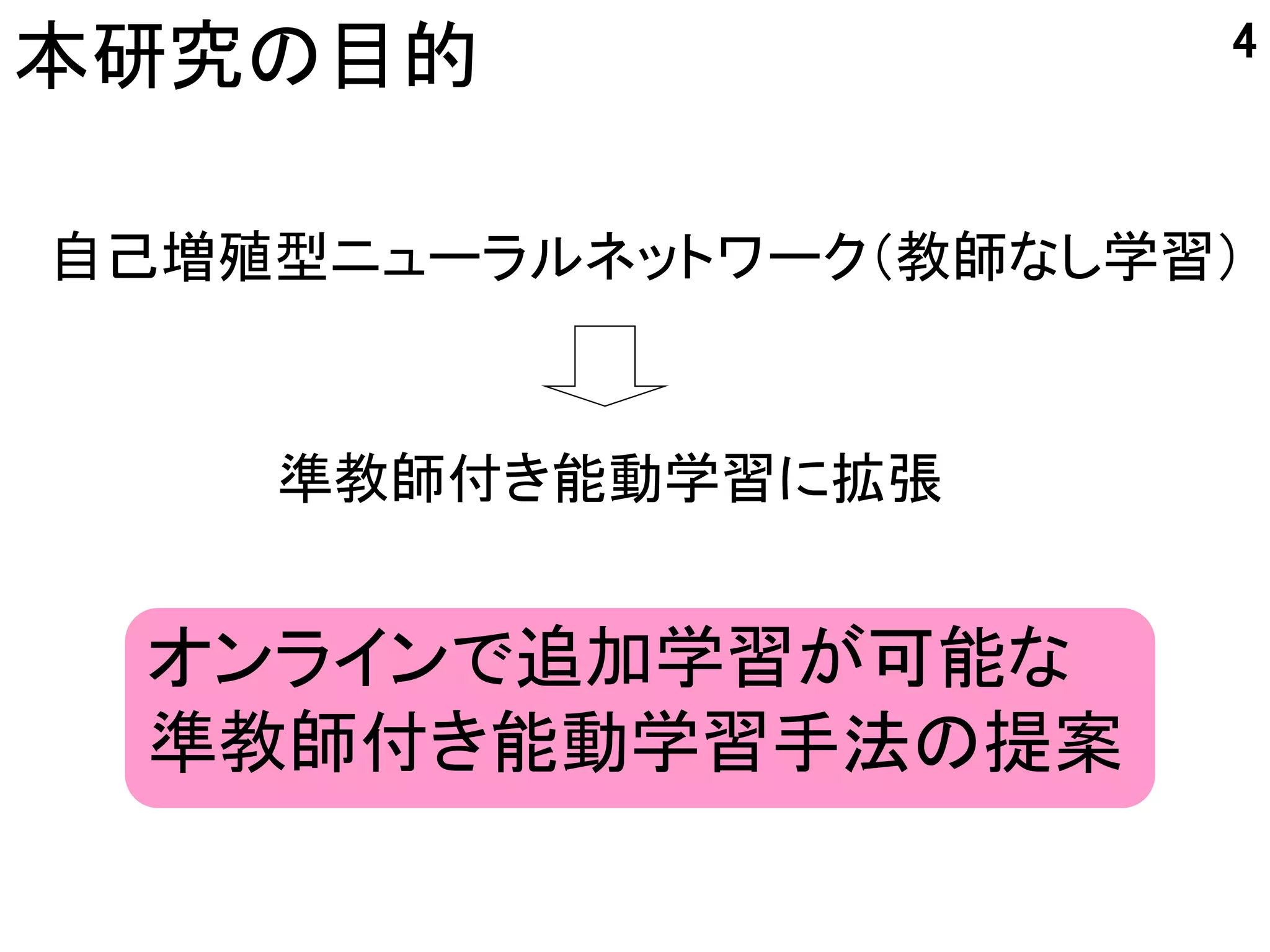

- 4.

3

自己増殖型ニューラルネットワーク

(SOINN) [Shen, 2006]

教師なし学習の手法

分布を

近似

入力データ SOINN

長所

ネットワーク構造(ノードや辺の数)を自律的に獲得

オンライン学習である

追加学習が可能

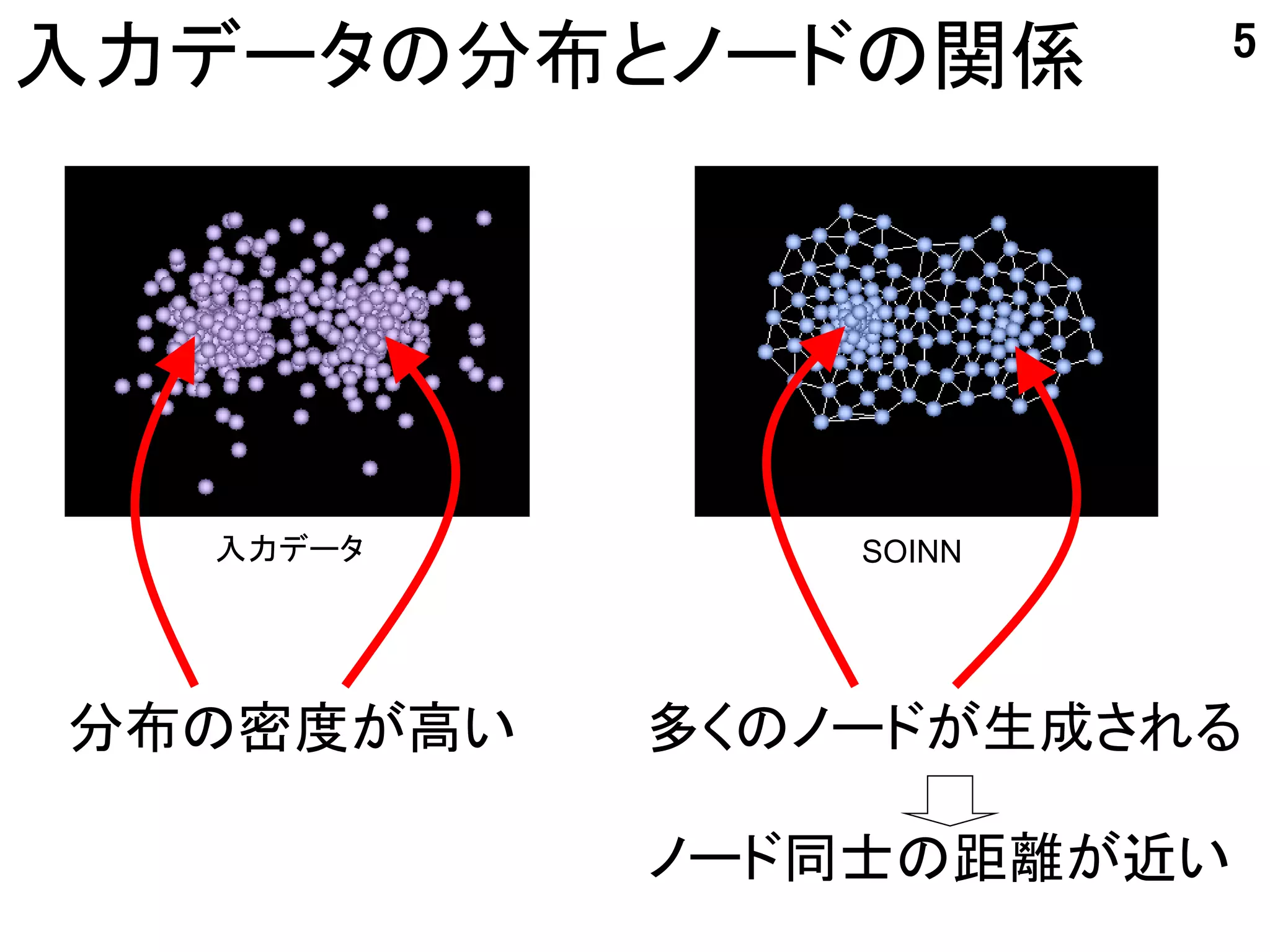

- 5.

- 6.

- 7.

- 8.

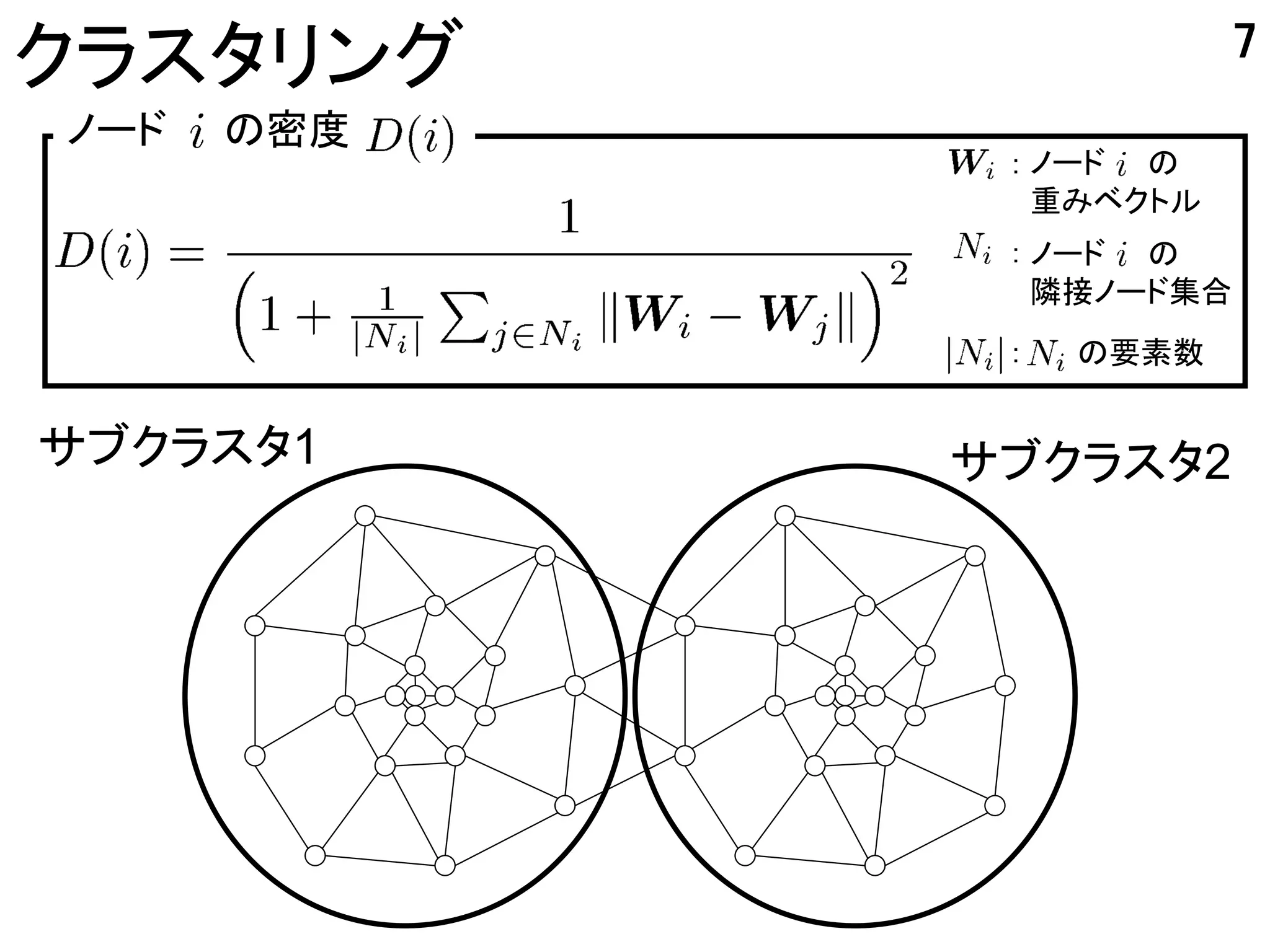

7

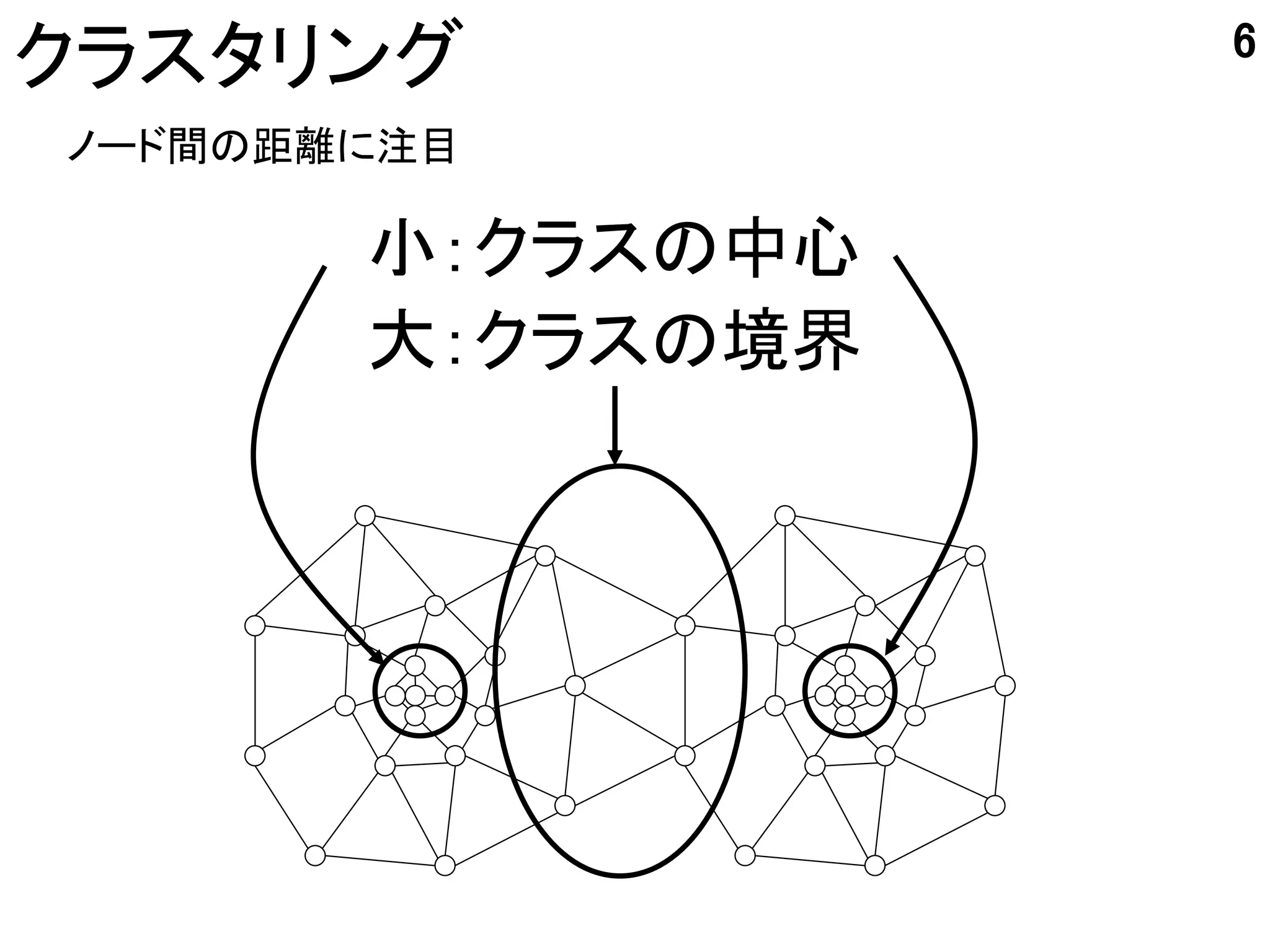

クラスタリング

ノード の密度

: ノード の

重みベクトル

: ノード の

隣接ノード集合

: の要素数

サブクラスタ1 サブクラスタ2

- 9.

8

サブクラスタのグループ化

ノードの密度分布

密度の頂点と谷間の差 < 閾値

サブクラスタをグループ化

サブクラスタ1 2 3 4 5 6 7

細かく分かれすぎる

グループ1 グループ2 階層構造

クラスタ1

[小倉ら, 2007] と同様の考えかた

違い:密度の定義,クラスタの階層構造

- 10.

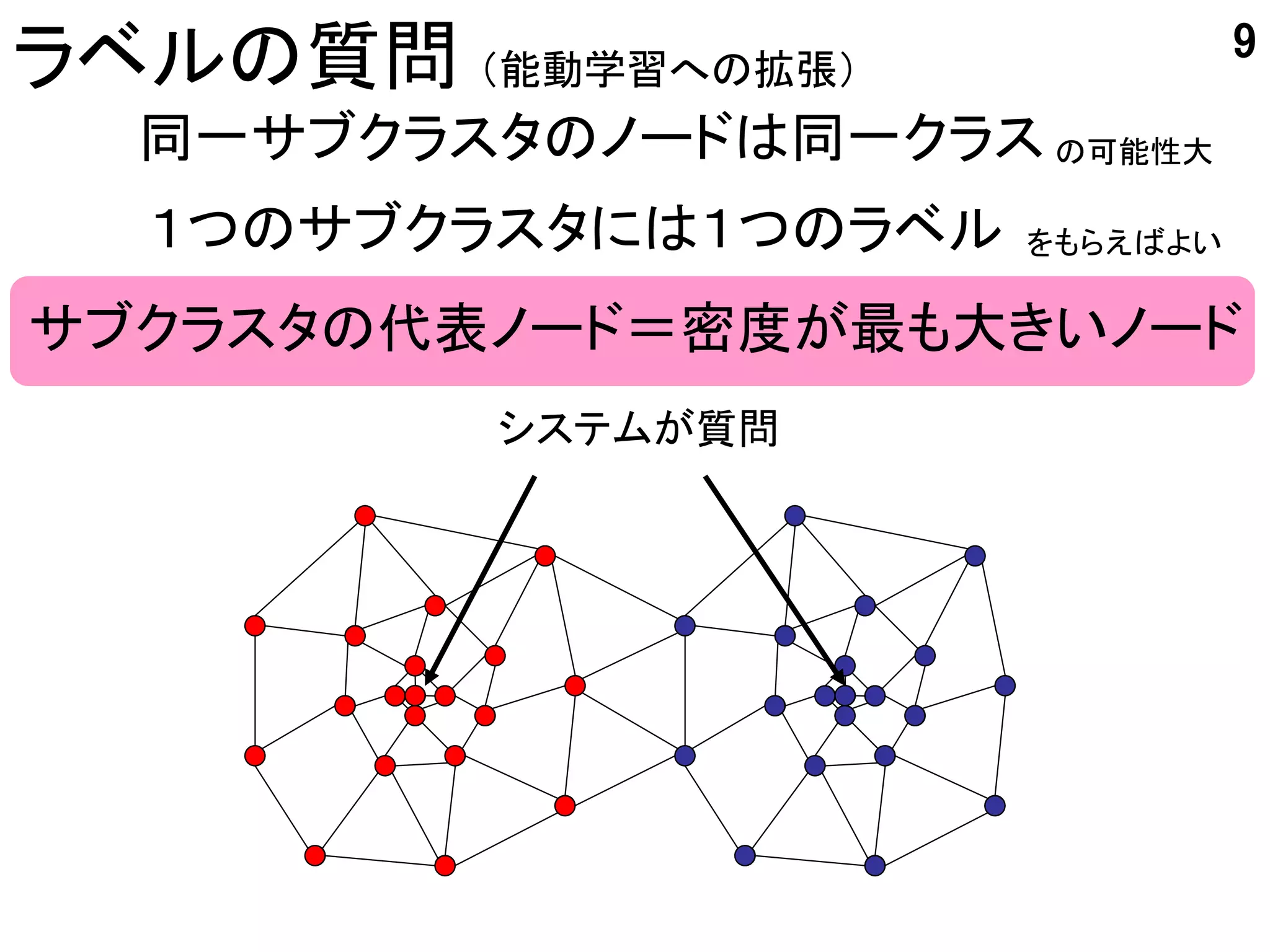

9

ラベルの質問 (能動学習への拡張)

同一サブクラスタのノードは同一クラス の可能性大

1つのサブクラスタには1つのラベル をもらえばよい

サブクラスタの代表ノード=密度が最も大きいノード

システムが質問

- 11.

- 12.

- 13.

- 14.

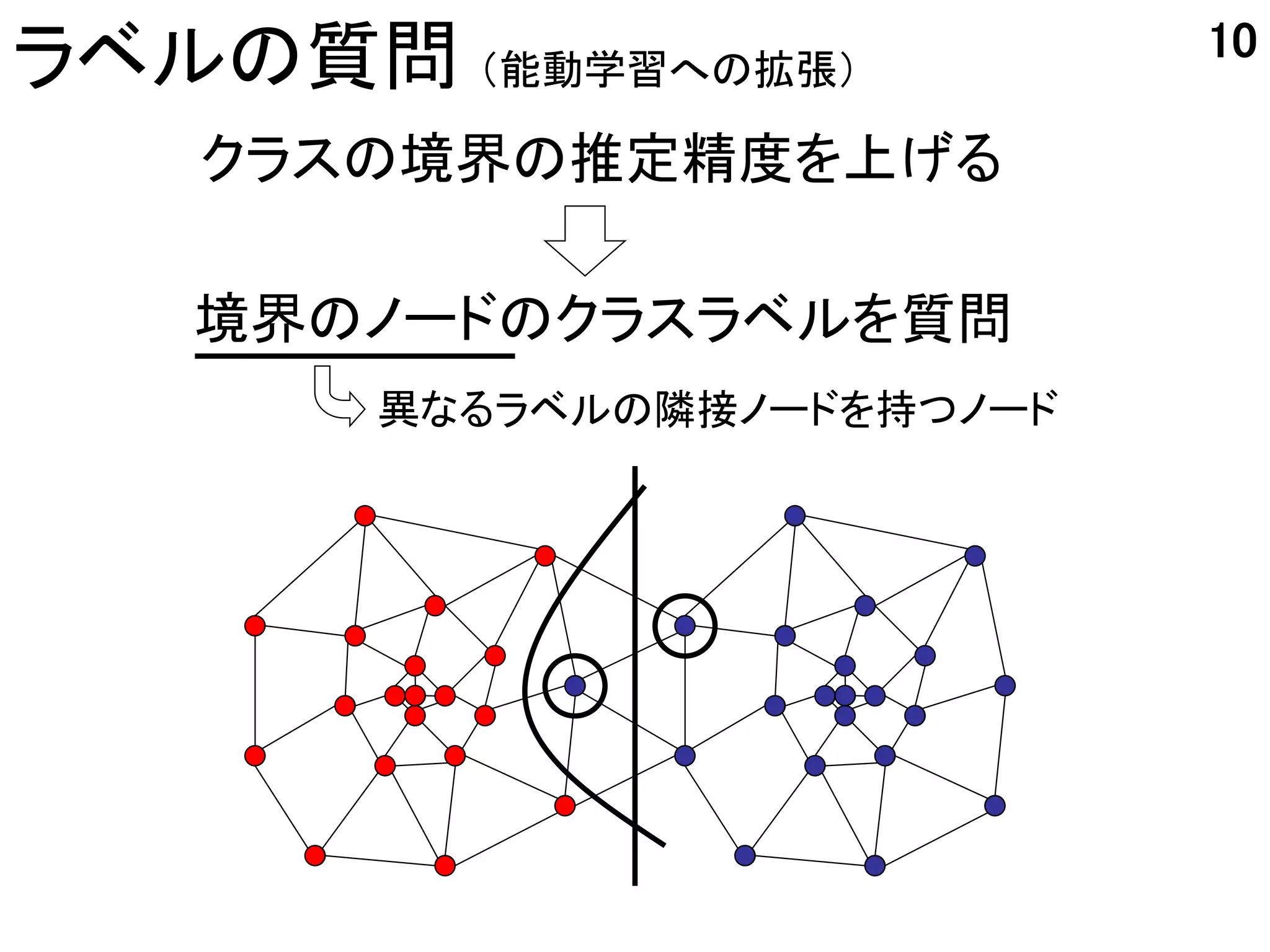

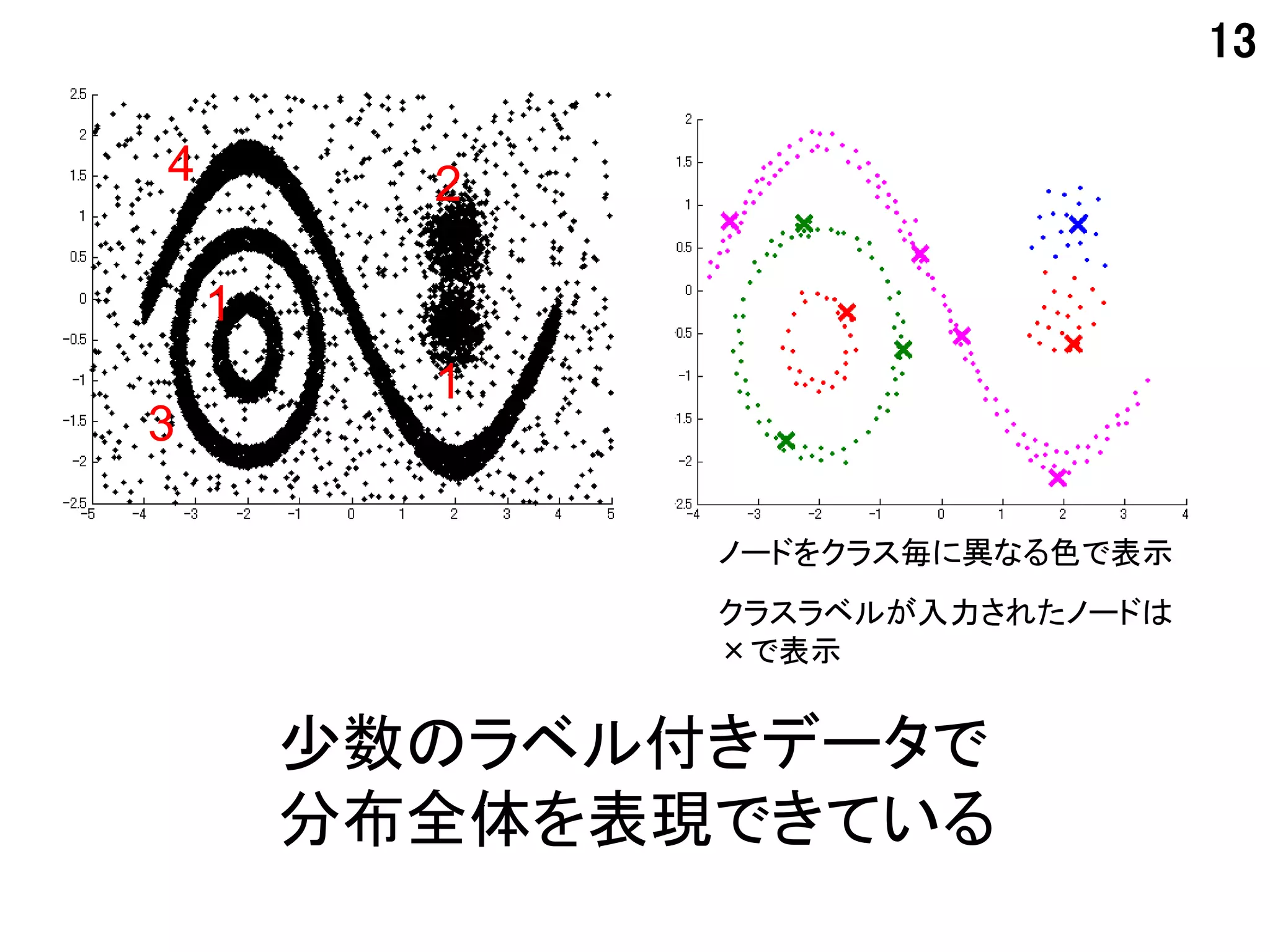

13

4 2

1

1

3

ノードをクラス毎に異なる色で表示

クラスラベルが入力されたノードは

×で表示

少数のラベル付きデータで

分布全体を表現できている

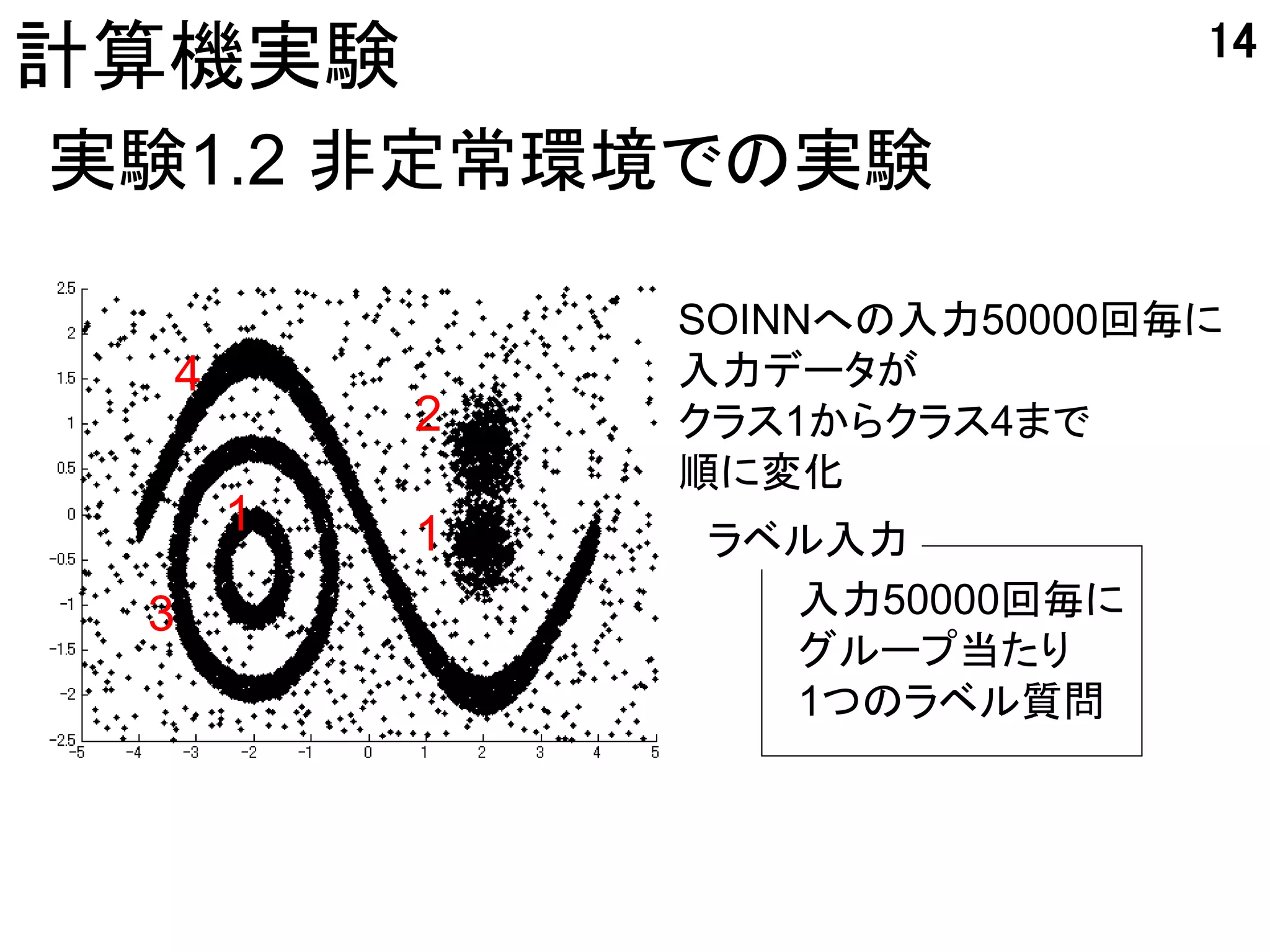

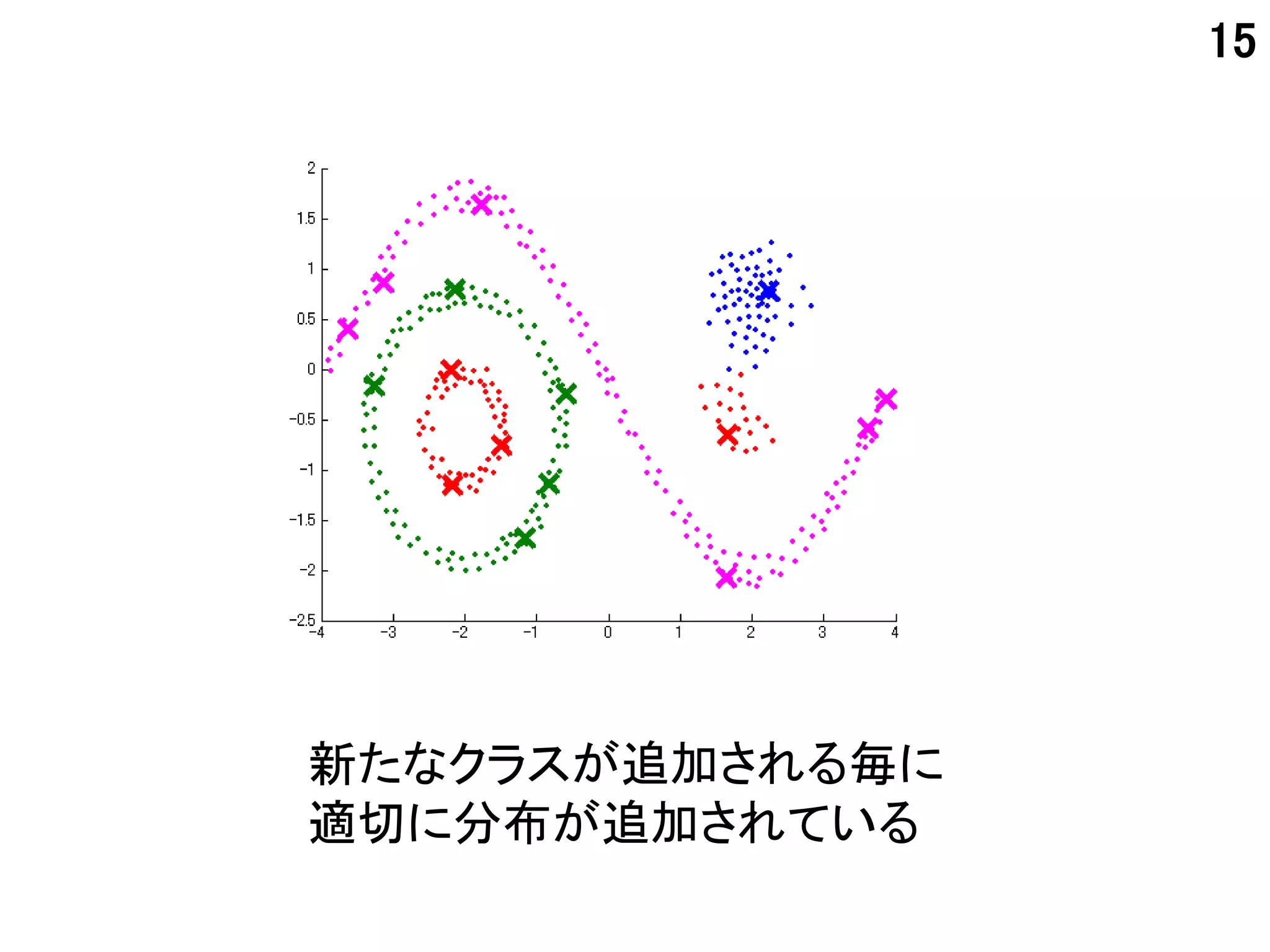

- 15.

- 16.

- 17.

- 18.

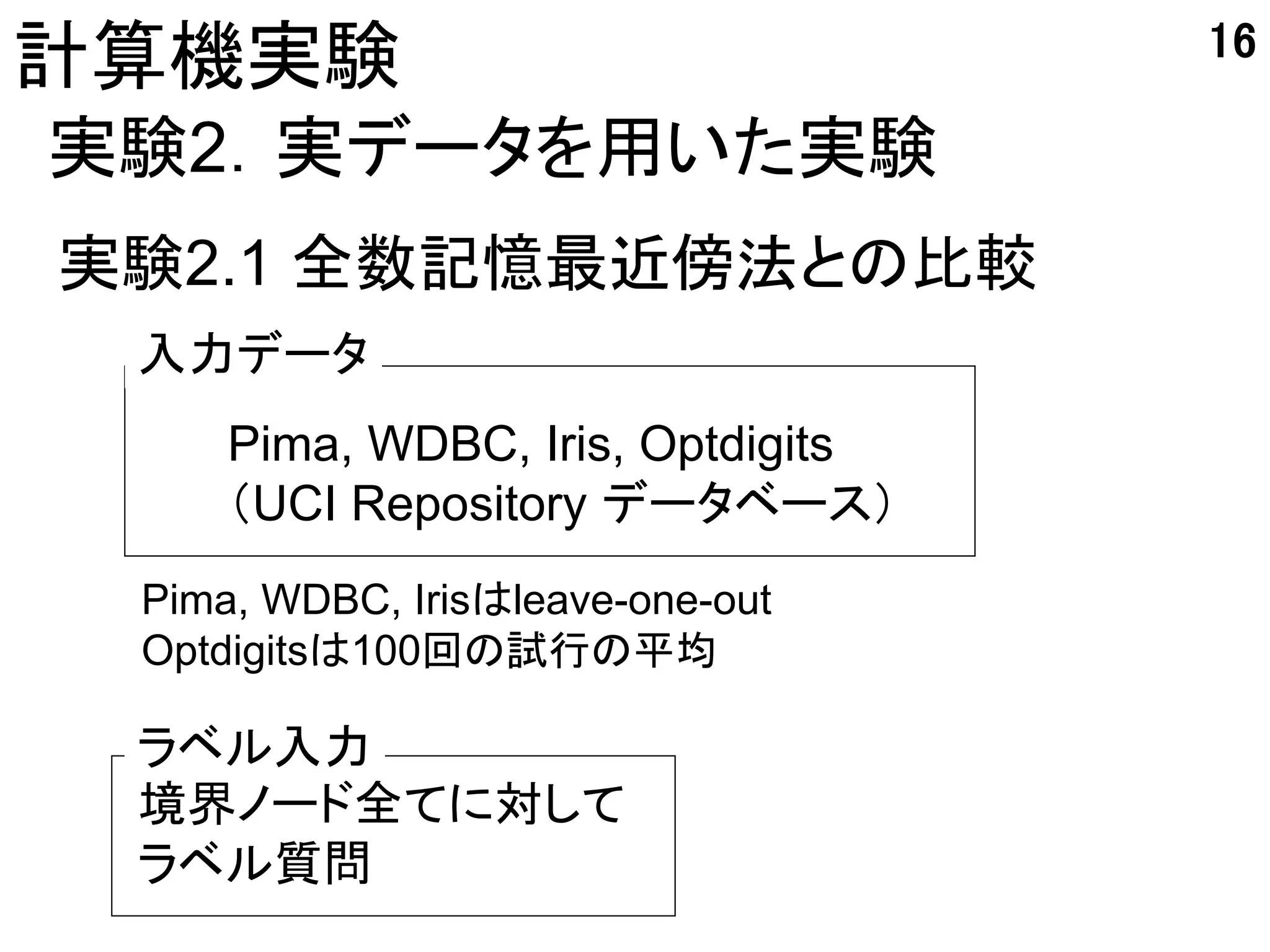

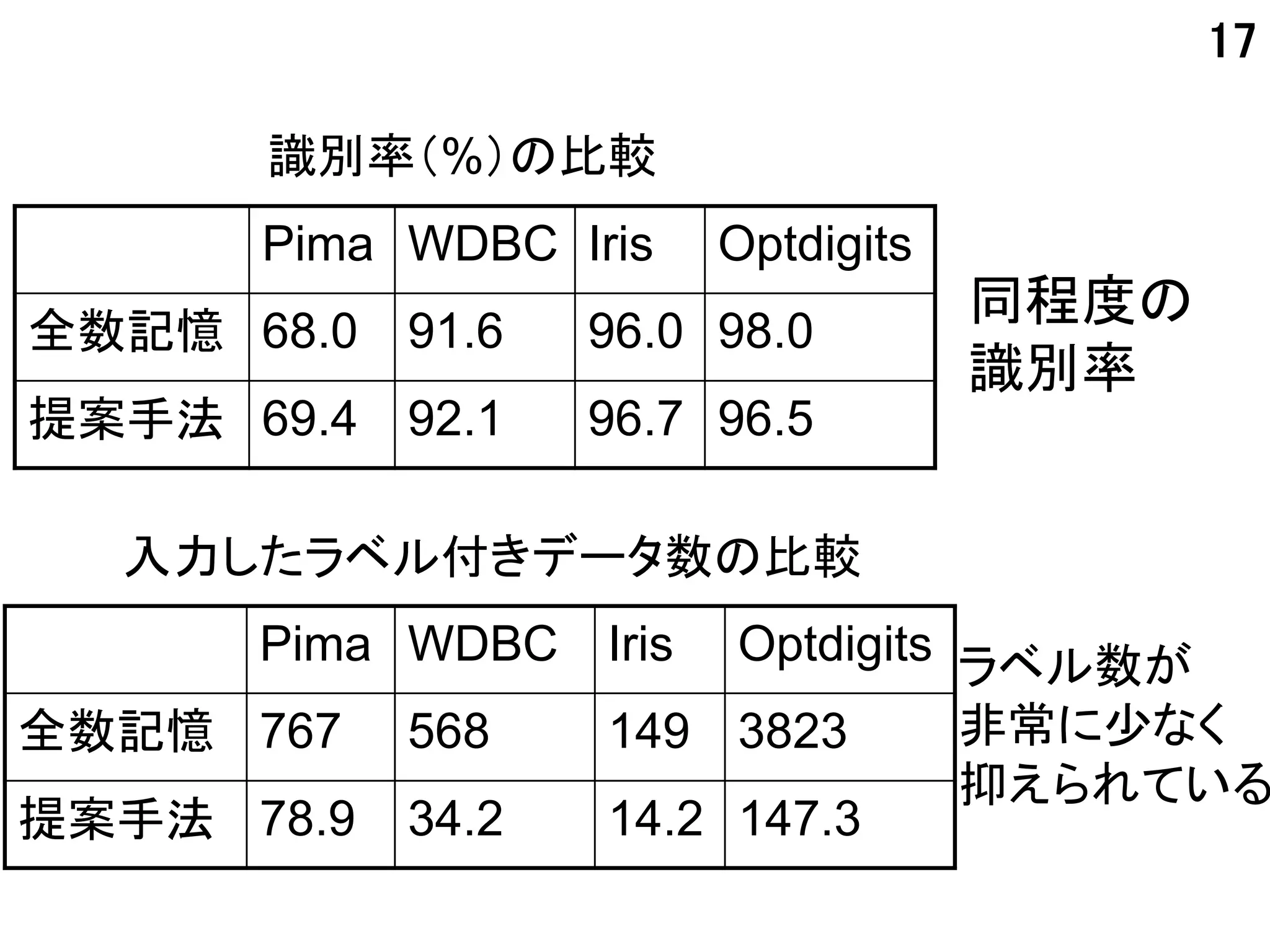

17

識別率(%)の比較

Pima WDBC Iris Optdigits

同程度の

全数記憶 68.0 91.6 96.0 98.0

識別率

提案手法 69.4 92.1 96.7 96.5

入力したラベル付きデータ数の比較

Pima WDBC Iris Optdigits ラベル数が

全数記憶 767 568 149 3823 非常に少なく

抑えられている

提案手法 78.9 34.2 14.2 147.3

- 19.

- 20.

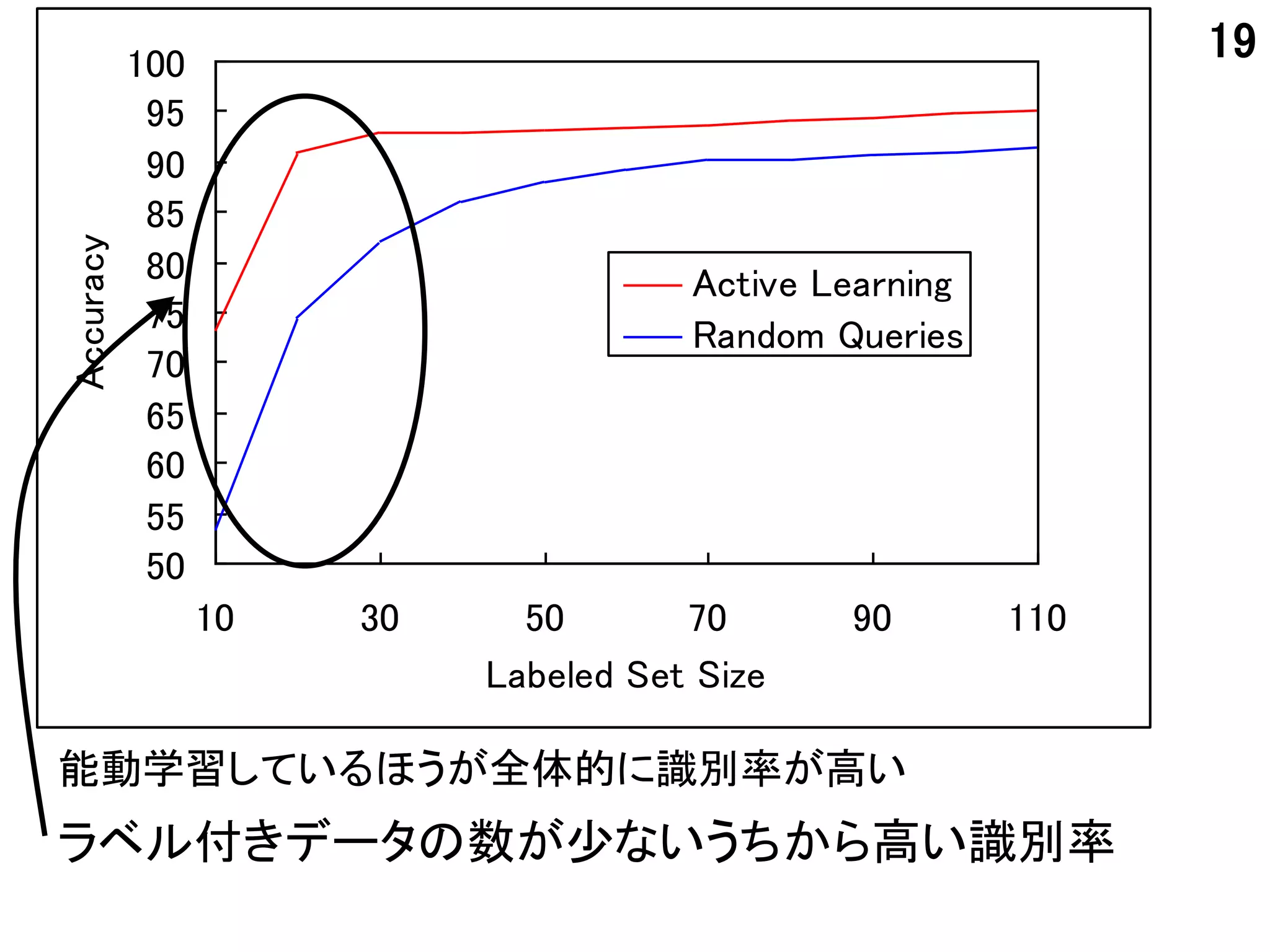

100

19

95

90

85

Accuracy

80 Active Learning

75

Random Queries

70

65

60

55

50

10 30 50 70 90 110

Labeled Set Size

能動学習しているほうが全体的に識別率が高い

ラベル付きデータの数が少ないうちから高い識別率

- 21.

- 22.

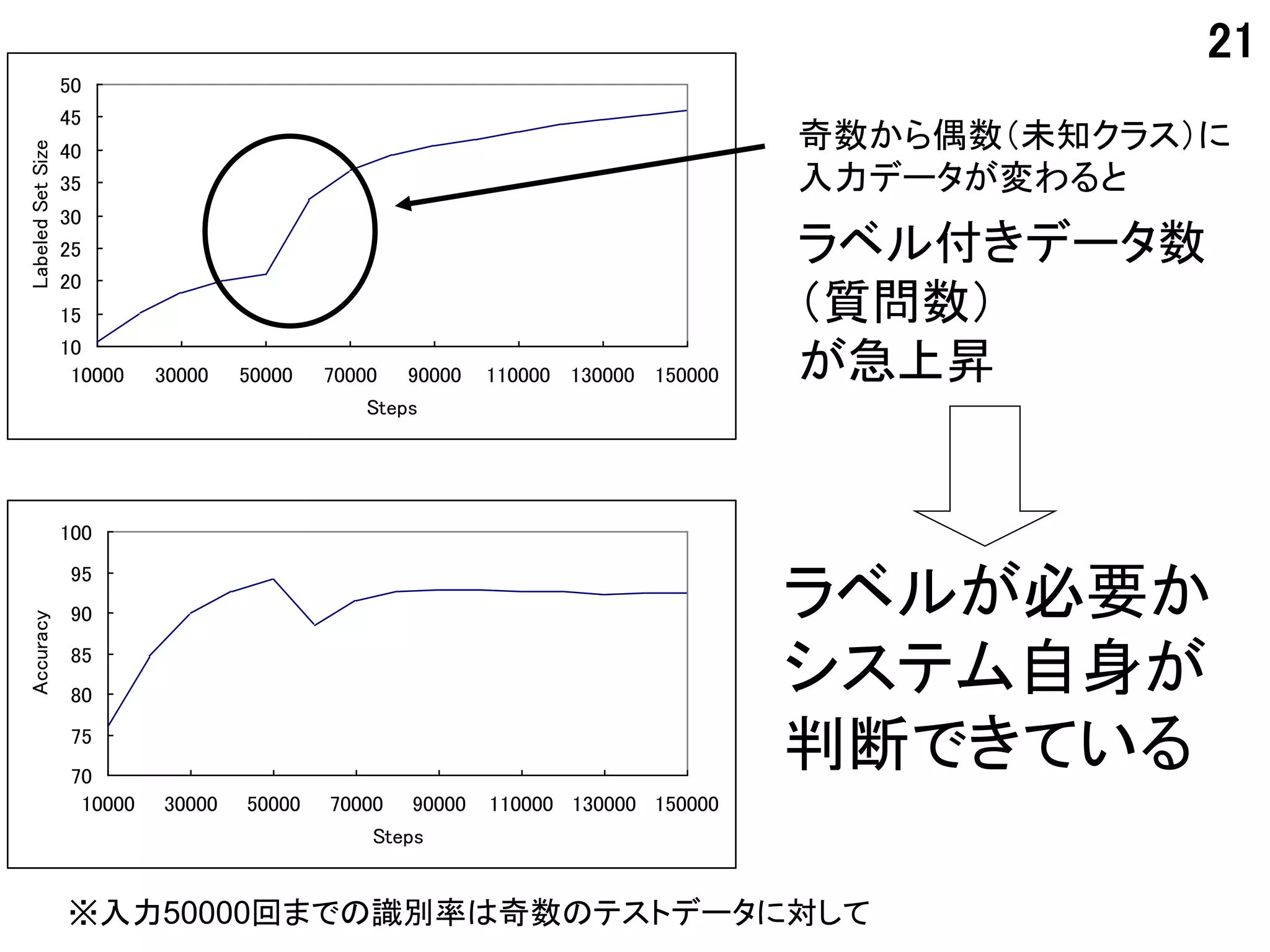

21

50

45

奇数から偶数(未知クラス)に

Labeled Set Size

40

35 入力データが変わると

30

25 ラベル付きデータ数

20

15 (質問数)

10

10000 30000 50000 70000 90000 110000 130000 150000 が急上昇

Steps

100

95

90 ラベルが必要か

Accuracy

85

80

システム自身が

75

70

判断できている

10000 30000 50000 70000 90000 110000 130000 150000

Steps

※入力50000回までの識別率は奇数のテストデータに対して

- 23.

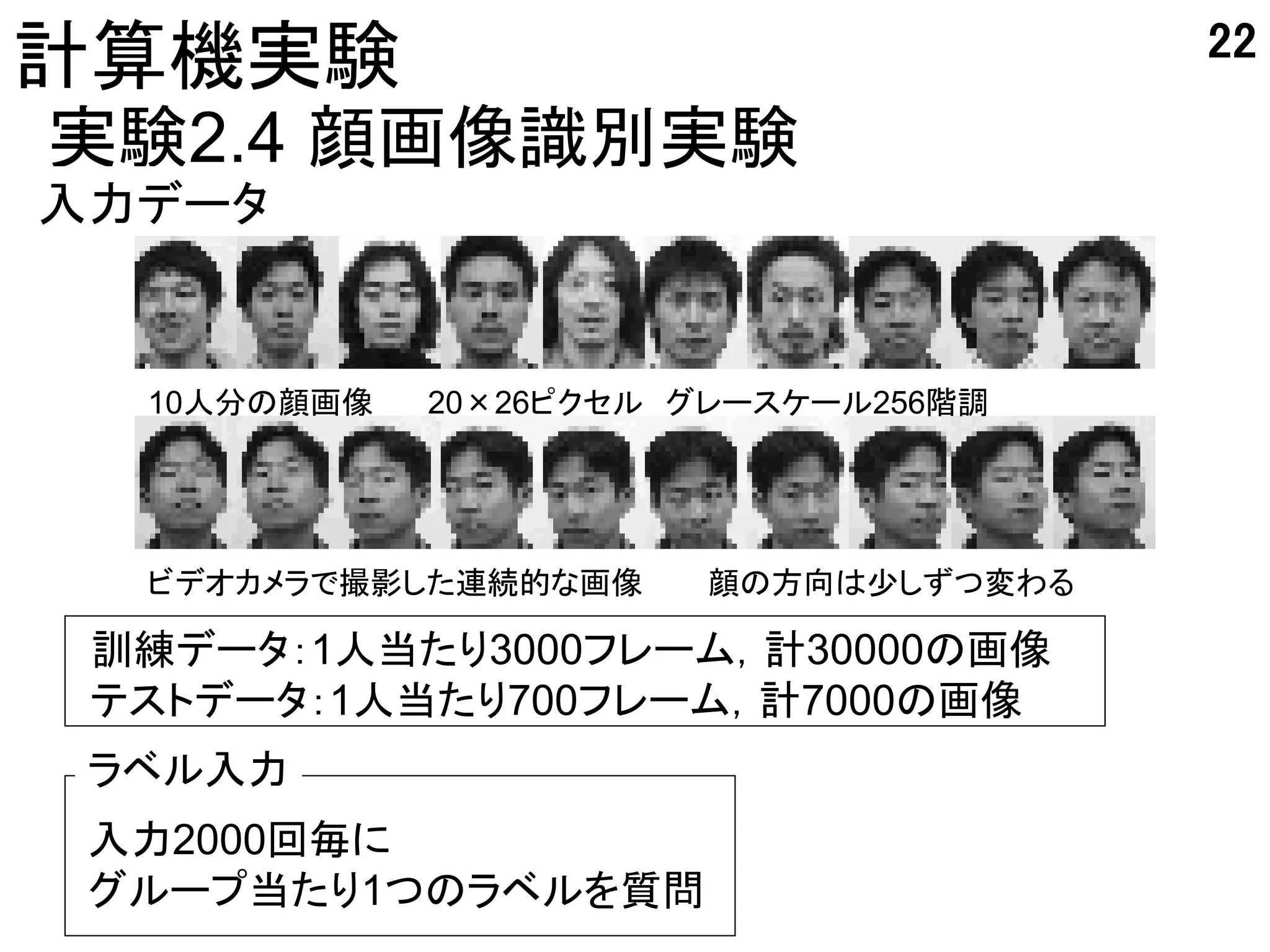

22

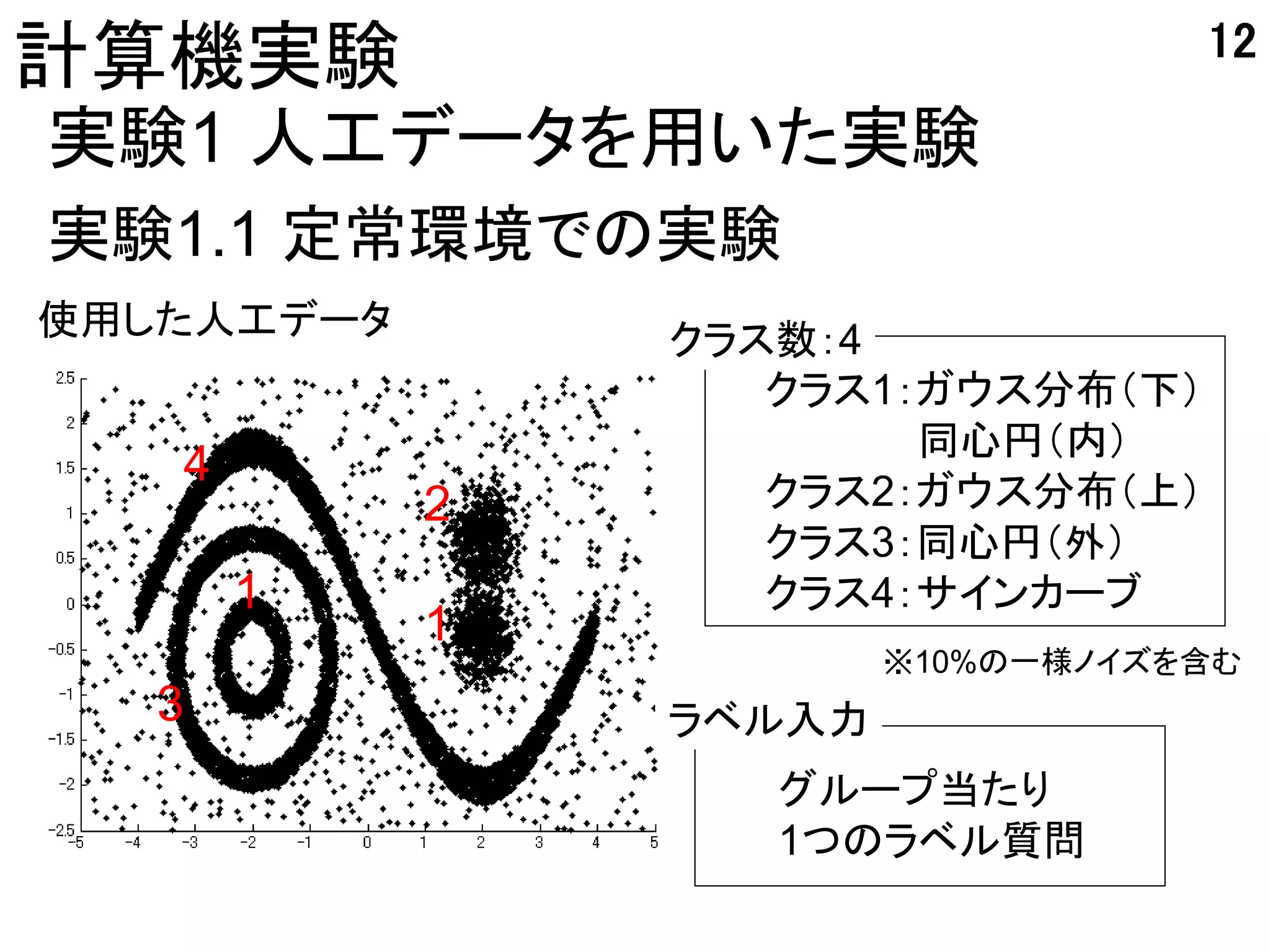

計算機実験

実験2.4 顔画像識別実験

入力データ

10人分の顔画像 20×26ピクセル グレースケール256階調

ビデオカメラで撮影した連続的な画像 顔の方向は少しずつ変わる

訓練データ:1人当たり3000フレーム,計30000の画像

テストデータ:1人当たり700フレーム,計7000の画像

ラベル入力

入力2000回毎に

グループ当たり1つのラベルを質問

- 24.

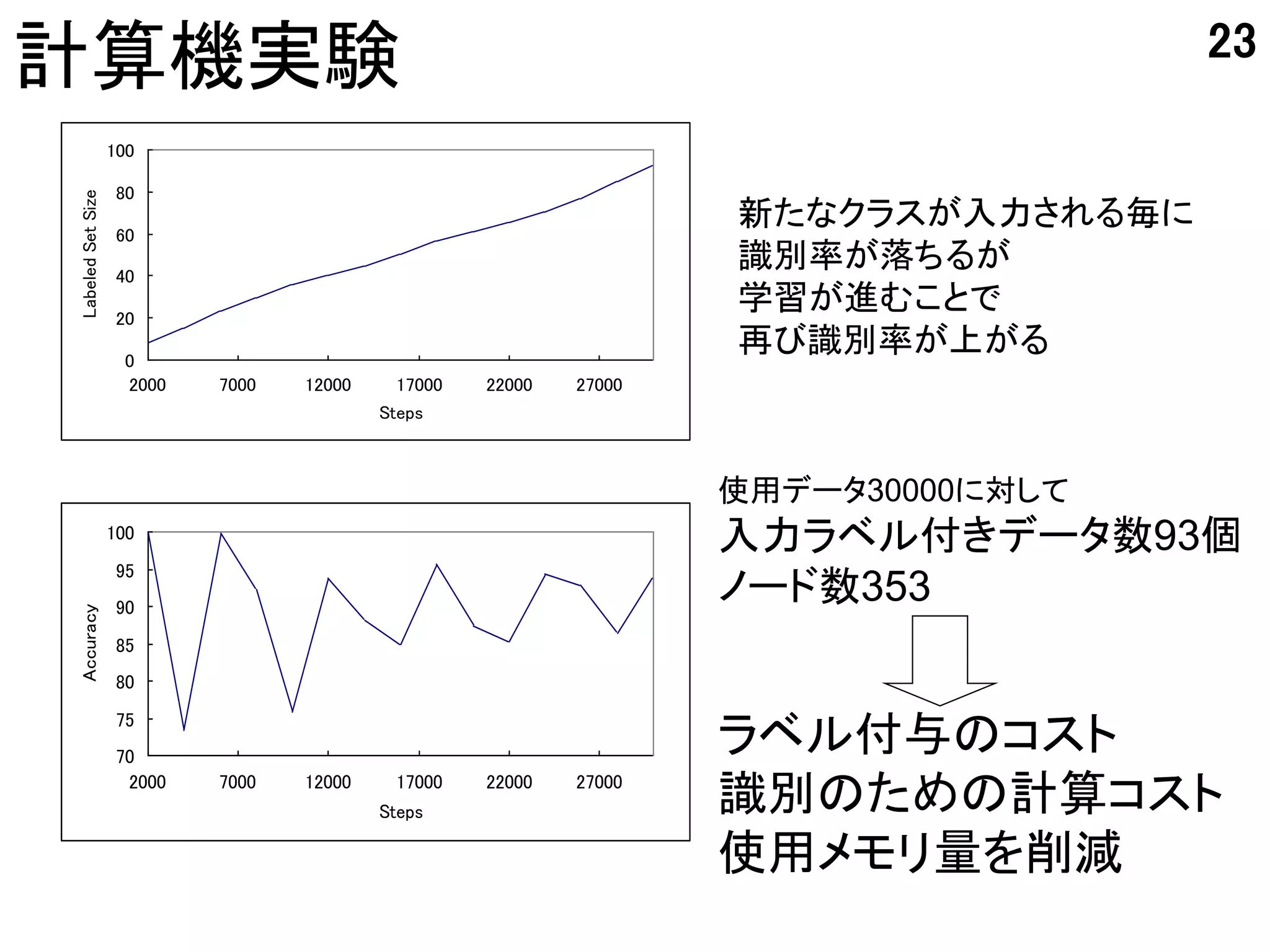

23

計算機実験

100

80

Labeled Set Size

60

新たなクラスが入力される毎に

40

識別率が落ちるが

20

学習が進むことで

0

再び識別率が上がる

2000 7000 12000 17000 22000 27000

Steps

使用データ30000に対して

100

入力ラベル付きデータ数93個

95

90

ノード数353

Accuracy

85

80

75

70

ラベル付与のコスト

2000 7000 12000 17000

Steps

22000 27000

識別のための計算コスト

使用メモリ量を削減

- 25.

24

成果

SOINNを拡張して

オンラインで追加学習が可能な

準教師付き能動学習手法を提案

今後の課題

識別率のさらなる向上

![2

従来の準教師付き(能動)学習

Generative Model [Nigam et al., 2000]

Co-Training [Blum and Mitchell, 1998], [Muslea et al., 2002]

TSVM [Bennett and Demiriz, 1999]

GRF [Zhu et al., 2003]

・バッチ学習 →膨大なメモリが必要

・クラス数は事前に与える →新しいクラスの追加が困難

実環境には…

膨大な数のデータ

新しい概念(クラス)の発生

オンラインで追加学習可能なシステム

が重要](https://image.slidesharecdn.com/ssa-soinn-110813054053-phpapp01/75/SSA-SOINN-3-2048.jpg)

![3

自己増殖型ニューラルネットワーク

(SOINN) [Shen, 2006]

教師なし学習の手法

分布を

近似

入力データ SOINN

長所

ネットワーク構造(ノードや辺の数)を自律的に獲得

オンライン学習である

追加学習が可能](https://image.slidesharecdn.com/ssa-soinn-110813054053-phpapp01/75/SSA-SOINN-4-2048.jpg)

![8

サブクラスタのグループ化

ノードの密度分布

密度の頂点と谷間の差 < 閾値

サブクラスタをグループ化

サブクラスタ1 2 3 4 5 6 7

細かく分かれすぎる

グループ1 グループ2 階層構造

クラスタ1

[小倉ら, 2007] と同様の考えかた

違い:密度の定義,クラスタの階層構造](https://image.slidesharecdn.com/ssa-soinn-110813054053-phpapp01/75/SSA-SOINN-9-2048.jpg)