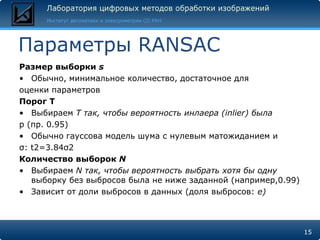

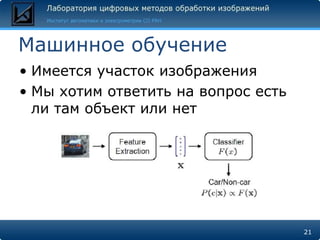

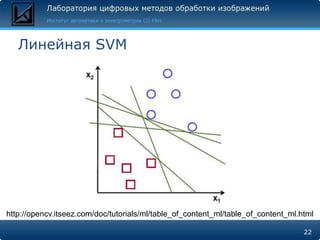

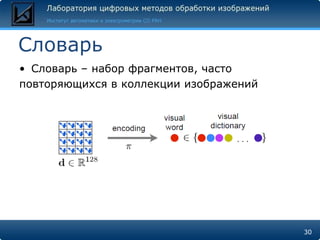

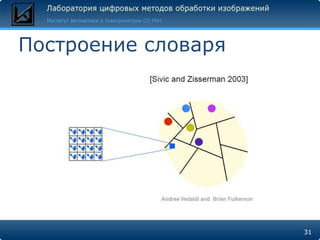

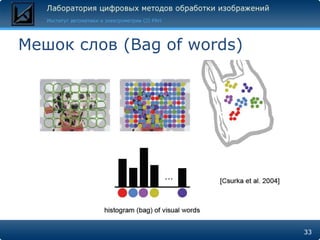

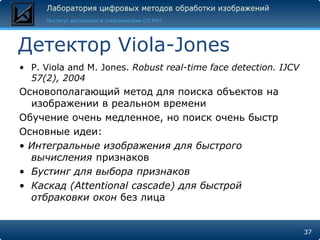

Документ охватывает методы обнаружения объектов, включая подходы, такие как RANSAC и алгоритм Виолы-Джонса. Основное внимание уделяется описанию ключевых понятий, таких как локальные особенности, дескрипторы, и использование SVM для классификации изображений. Также рассматриваются высокоуровневые идеи, такие как построение мешков слов и применение методов машинного обучения для поиска объектов на изображениях.

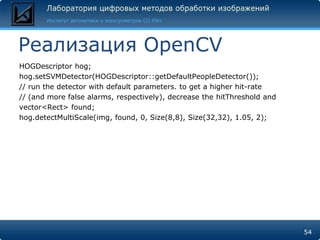

![Линейная SVM (реализация)

// Set up training data

float labels[4] = {1.0, -1.0, -1.0, -1.0};

Mat labelsMat(3, 1, CV_32FC1, labels);

float trainingData[4][2] = { {501, 10}, {255, 10}, {501, 255}, {10, 501} };

Mat trainingDataMat(3, 2, CV_32FC1, trainingData);

// Set up SVM's parameters

CvSVMParams params; params.svm_type = CvSVM::C_SVC;

params.kernel_type = CvSVM::LINEAR;

params.term_crit = cvTermCriteria(CV_TERMCRIT_ITER, 100, 1e-6);

// Train the SVM

CvSVM SVM;

SVM.train(trainingDataMat, labelsMat, Mat(), Mat(), params);

float response = SVM.predict(sampleMat);

Вопрос: как должна выглядеть sampleMat?

24](https://image.slidesharecdn.com/l06detection-111031000517-phpapp02/85/L06-detection-24-320.jpg)

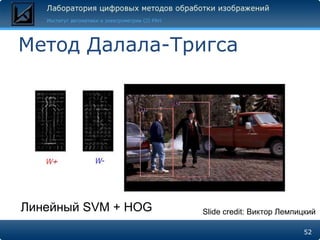

![Далал-Тригс vs. Виола-Джонс

• Для лиц Виола-Джонс работает почти идеально

• Для пешеходов Далал-Тригс аккуратнее (но медленнее)

• [Dollar et al. BMVC’09]: Виола-Джонс на правильных

каналах не хуже Далала-Тригса

Slide credit: Виктор Лемпицкий

55](https://image.slidesharecdn.com/l06detection-111031000517-phpapp02/85/L06-detection-55-320.jpg)

![Что осталось «за бортом»

• Локализация объектов и Хаф-леса

[Juergen Gall & Victor Lempitsky,

Class-Specific Hough Forests for

Object Detection, CVPR 2009]

• Неявная модель формы [Leibe,

Leonardis & Schiele IJCV’08]

• Обобщенное преобразование Хафа

57](https://image.slidesharecdn.com/l06detection-111031000517-phpapp02/85/L06-detection-57-320.jpg)