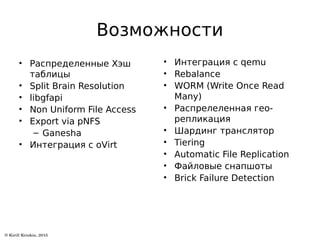

Документ описывает архитектуру и возможности файловой системы GlusterFS, которая является масштабируемой сетевой файловой системой для облачного хранения и мультимедиа. В нем представлены ключевые термины, типы томов и уровни трансляторов, а также описаны дополнительные возможности, такие как репликация и гео-репликация. Также указаны ссылки на ресурсы для получения дополнительной информации.

![Определение

• GlusterFS = GNU + Cluster

– масштабируемая

– сетевая файловая система

– ориентированная на интенсивный

обмен данными типа:

●

облачное хранилище

●

потоковое мультимедиа,

– использующая типовое [commodity]

оборудование](https://image.slidesharecdn.com/glusterfs-export-150731122613-lva1-app6891/85/GlusterFS-2-320.jpg)

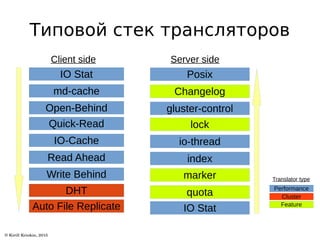

![Типы [уровни] трансляторов

● Storage

● Debug

● Cluster

● Encryption

● Protocol

● Performance

● Binding

● System

● Scheduler

● Реализация

дополнительных

возможностей

[квоты, фильтры,

блокировки]](https://image.slidesharecdn.com/glusterfs-export-150731122613-lva1-app6891/85/GlusterFS-5-320.jpg)