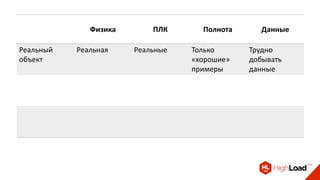

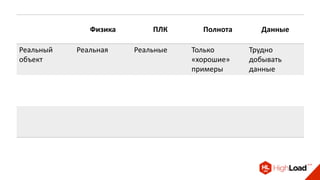

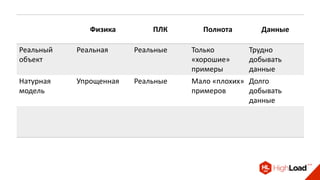

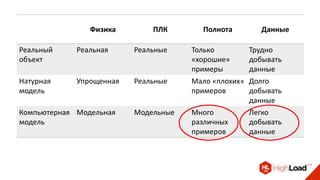

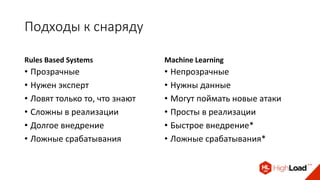

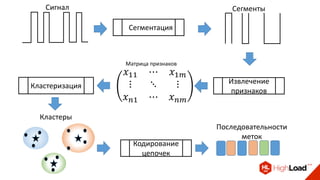

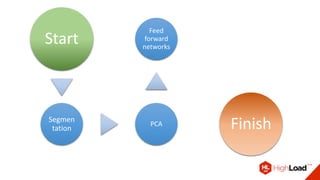

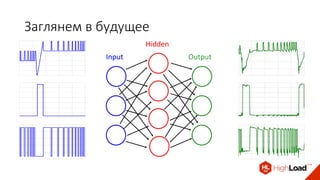

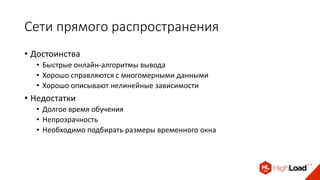

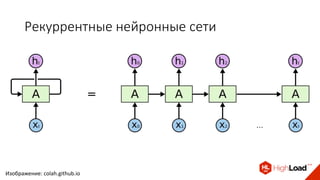

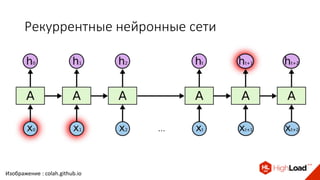

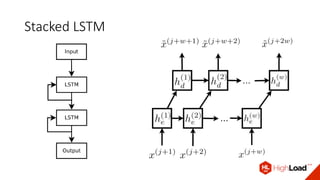

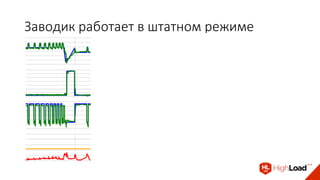

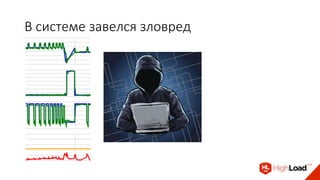

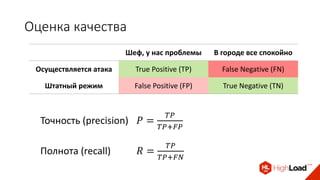

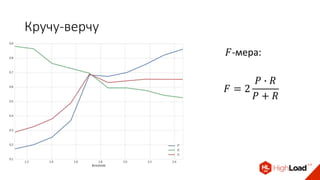

Документ обсуждает применение нейронных сетей для улучшения кибербезопасности в промышленности, подчеркивая необходимость анализа и трудности в сборе данных. Рассматриваются различные методы машинного обучения, их преимущества и недостатки, а также важные метрики для оценки эффективности. Документ также упоминает важные исследования и практические примеры в области обнаружения аномалий и прогнозирования временных рядов.