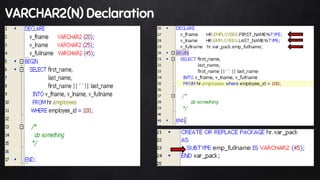

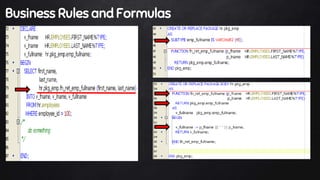

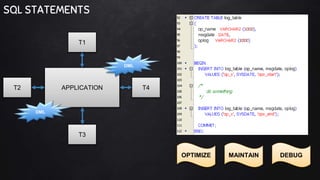

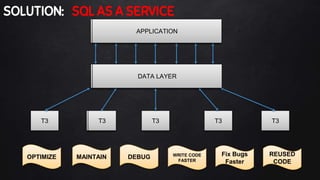

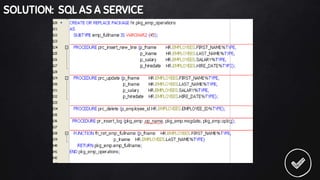

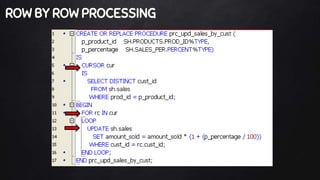

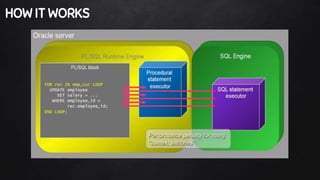

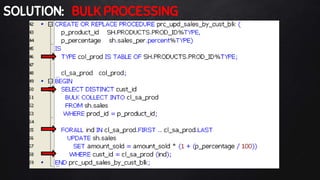

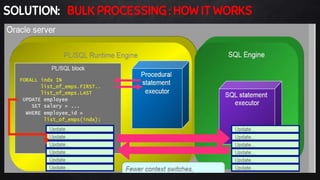

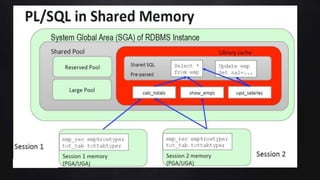

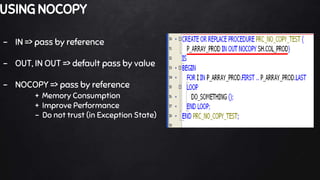

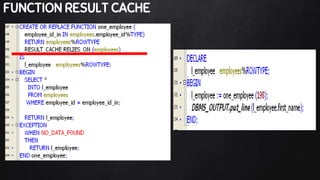

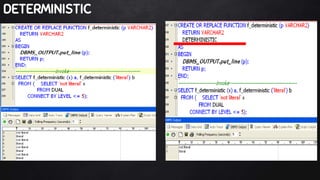

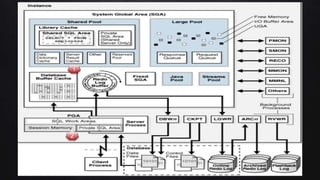

This document discusses best practices for PL/SQL including avoiding hard coding, row-by-row processing, and memory management. It recommends using SQL as a service, bulk processing, bulk collect with limit clause, and NOCOPY hint for memory. It also discusses data caching techniques like deterministic functions, PGA caching, and function result cache to improve performance.