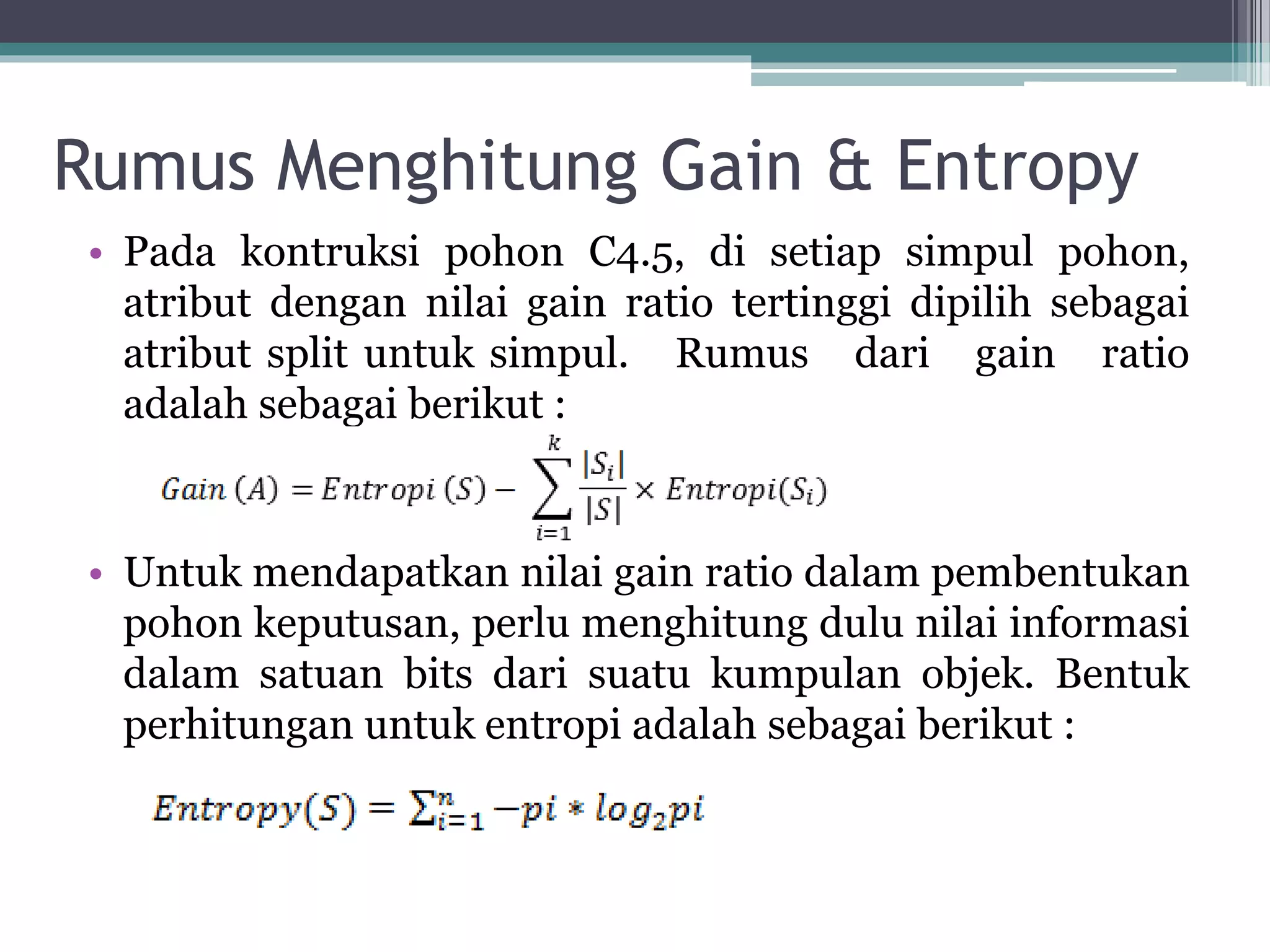

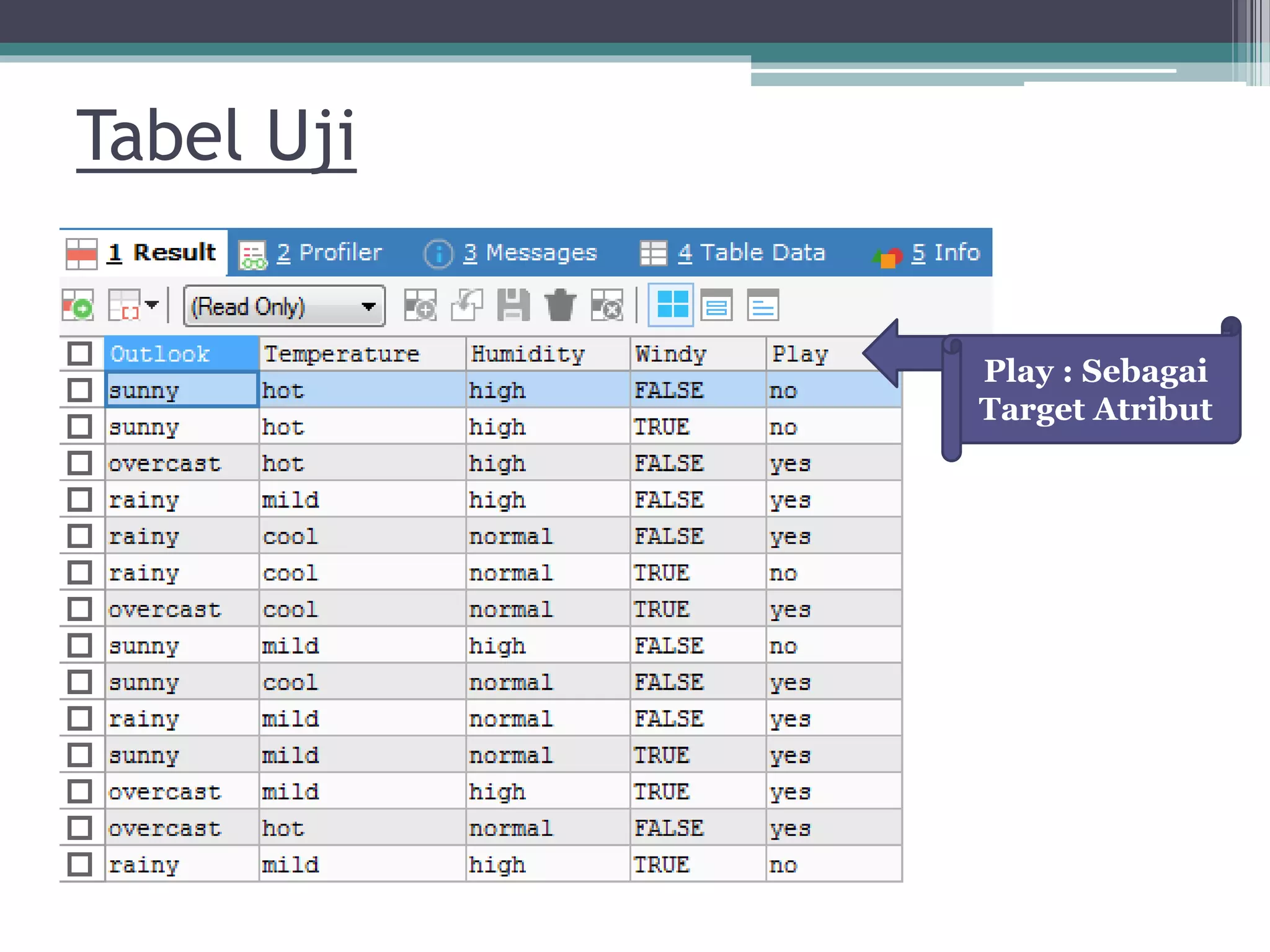

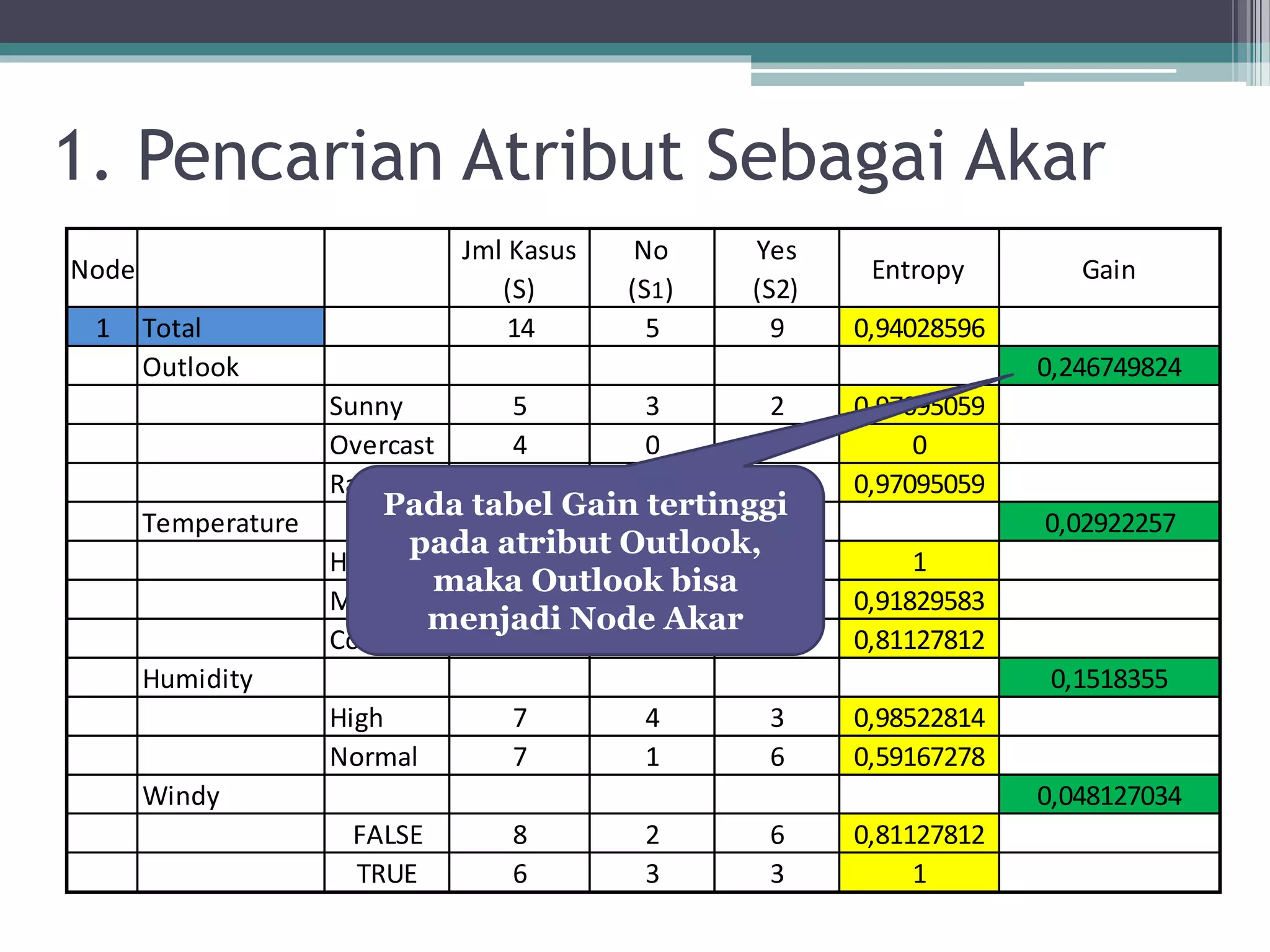

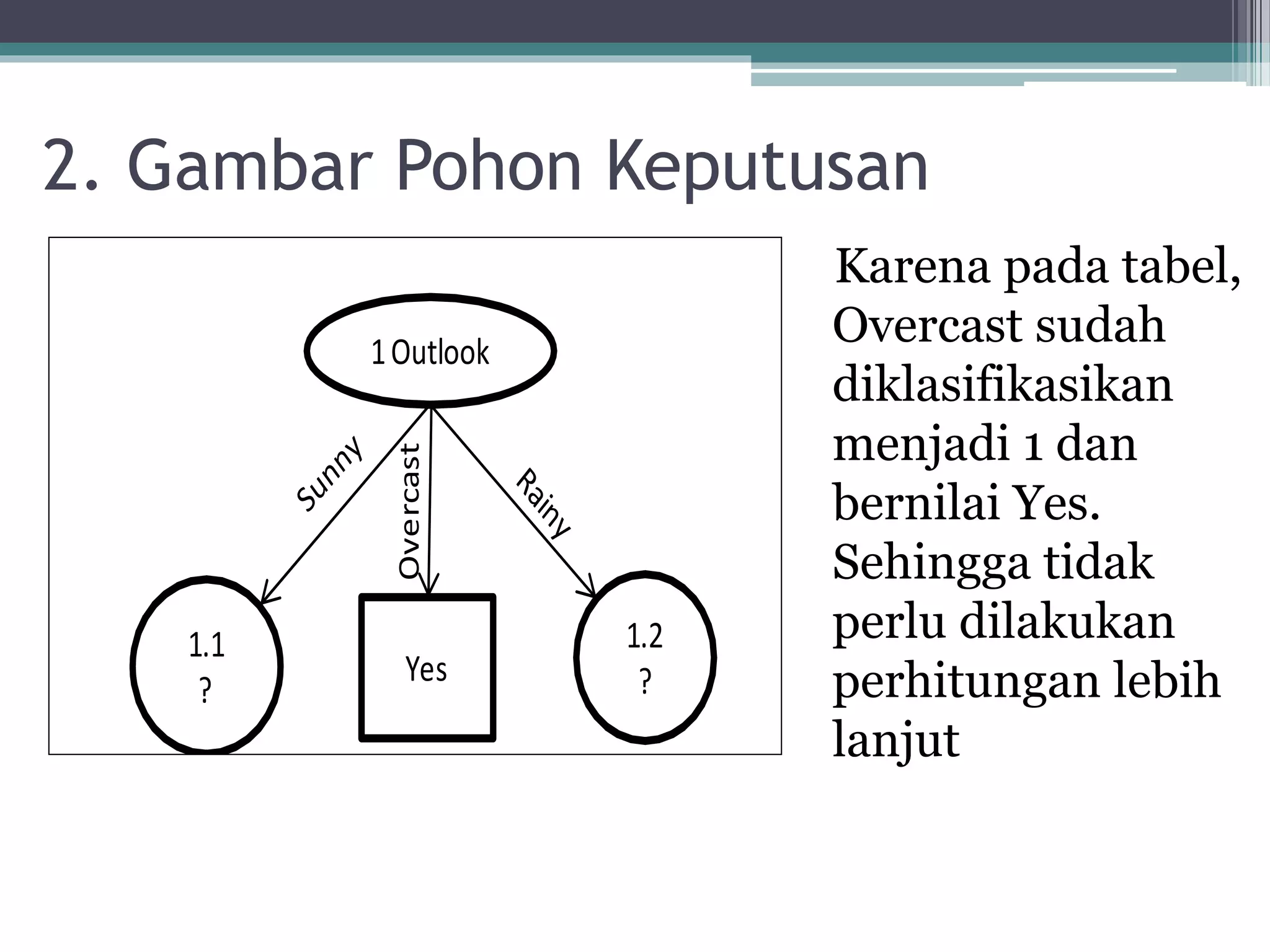

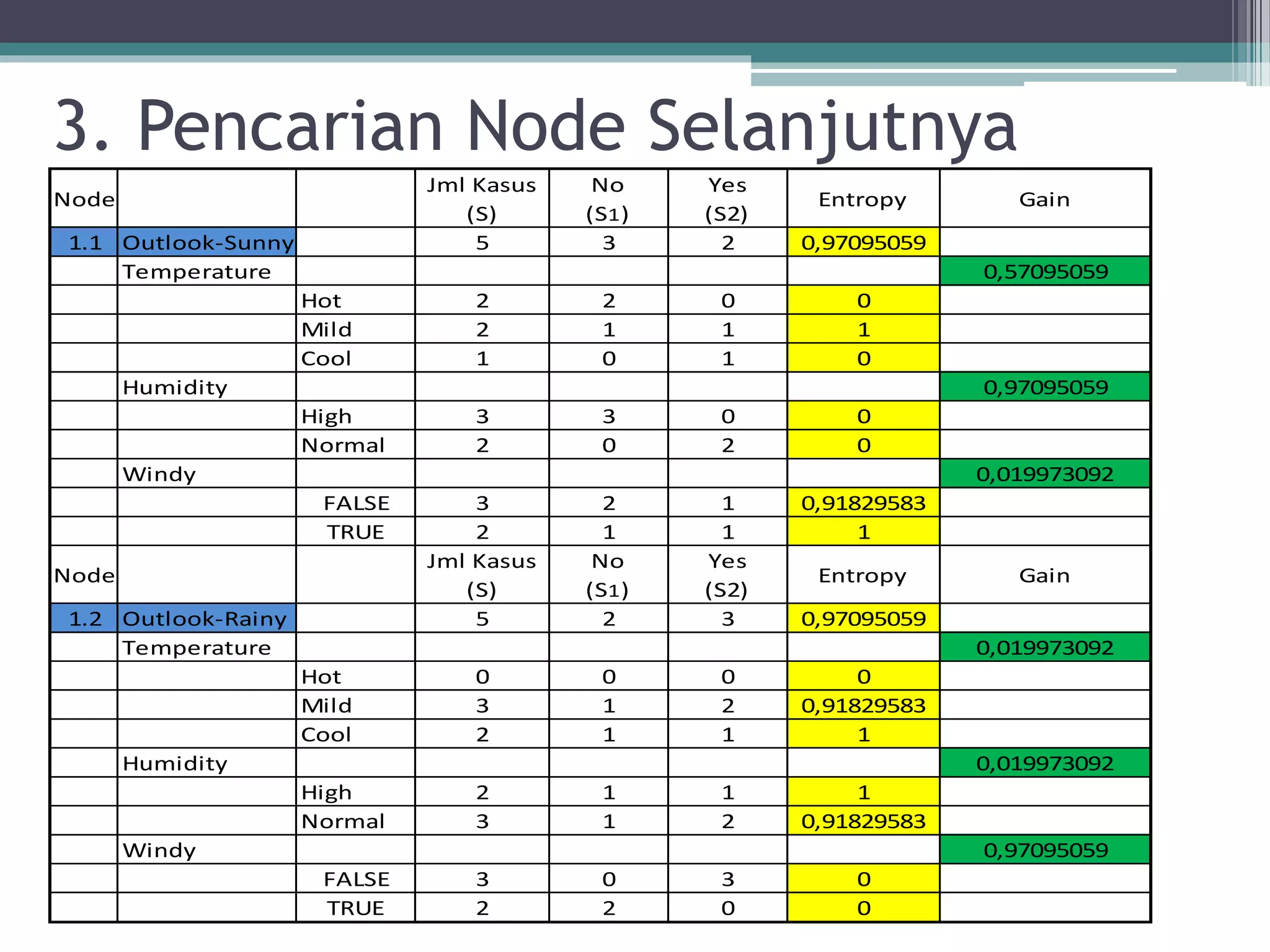

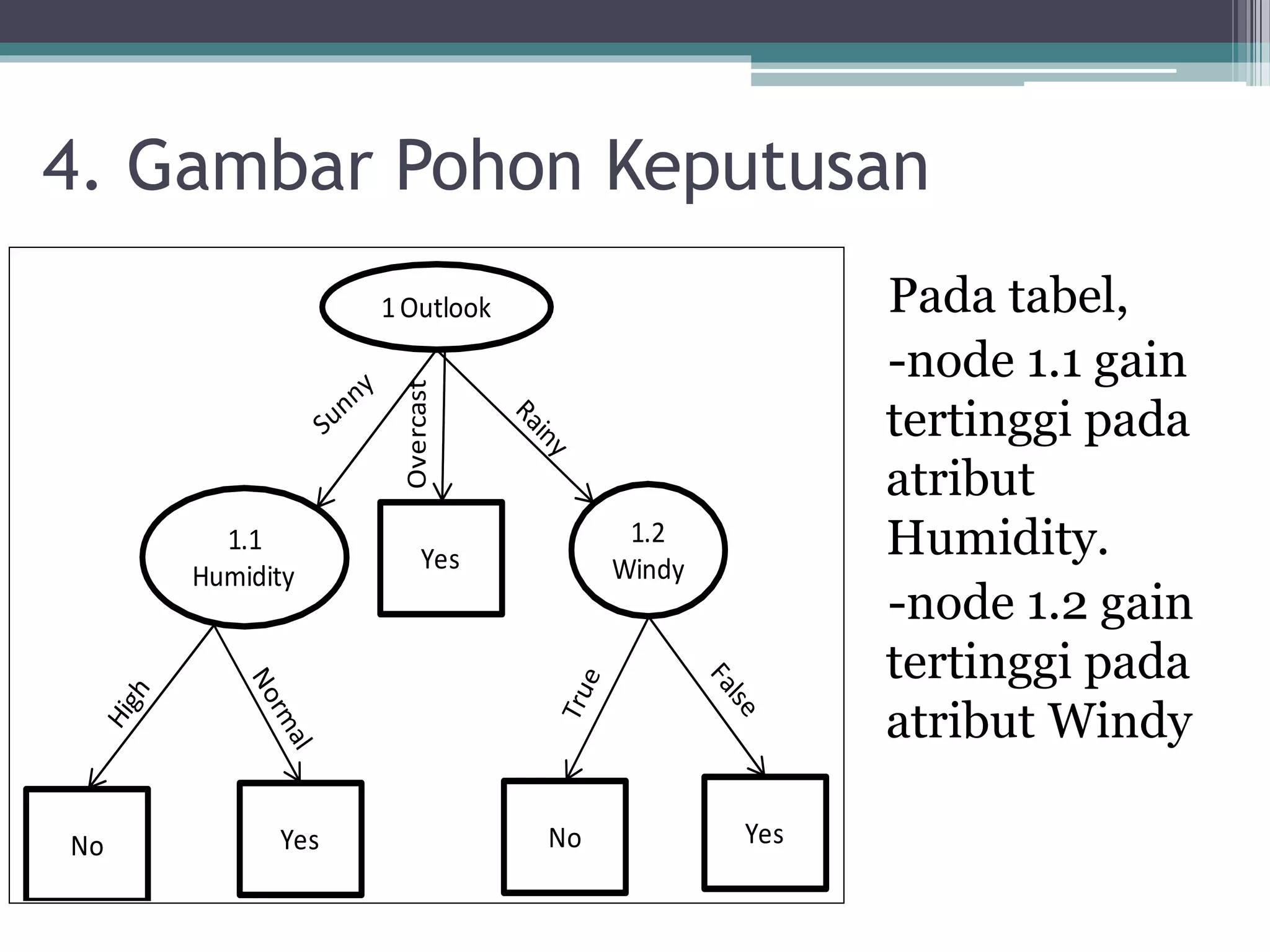

Algoritma C4.5 digunakan untuk membangun pohon keputusan berdasarkan atribut yang memiliki nilai gain ratio tertinggi untuk setiap simpul pohon. Algoritma ini mengubah data latih besar menjadi pohon keputusan yang merepresentasikan aturan klasifikasi, dengan memilih atribut akar, membuat cabang untuk setiap nilai atribut, dan membagi kasus di setiap cabang sampai semua kasus memiliki kelas yang sama.