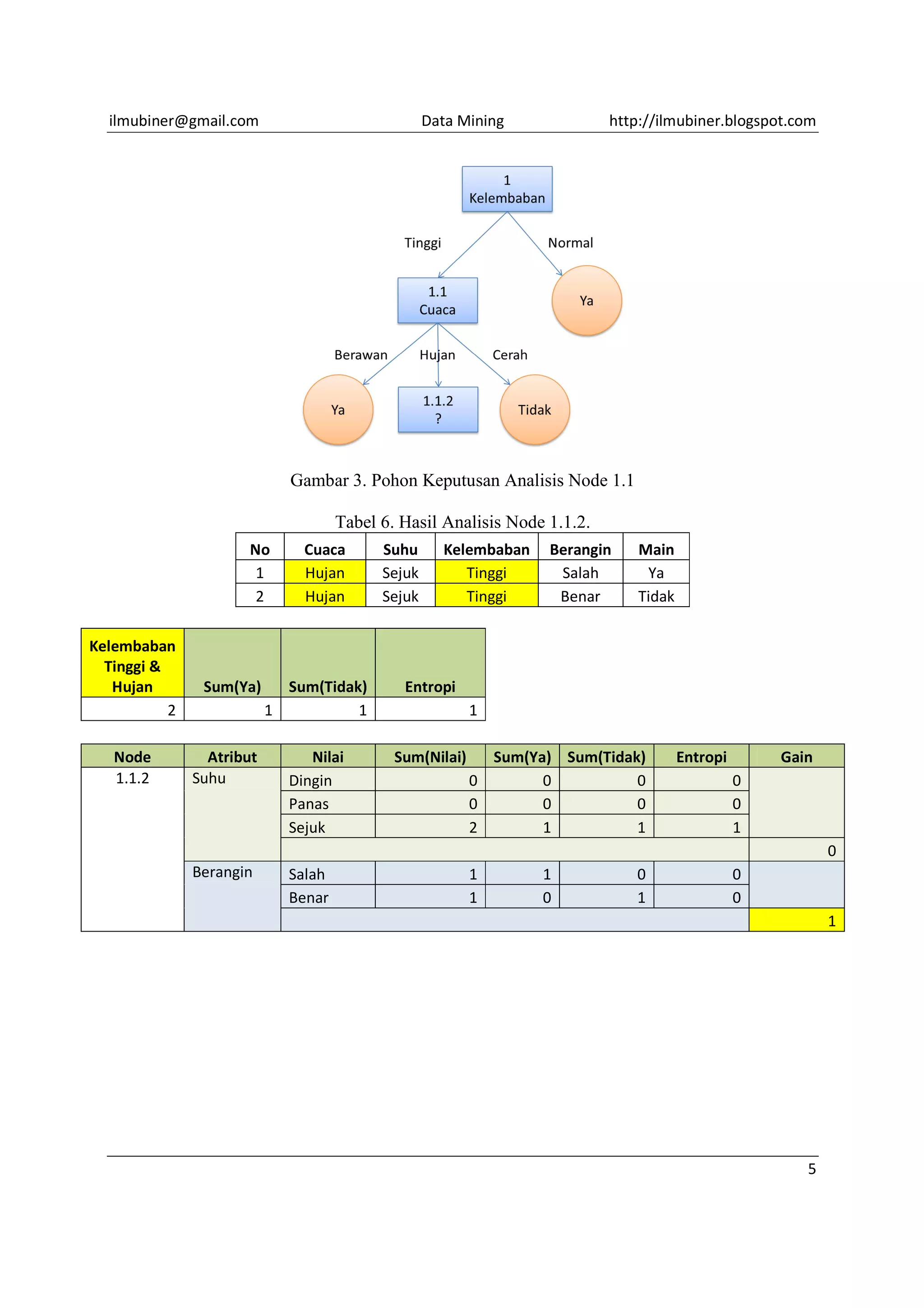

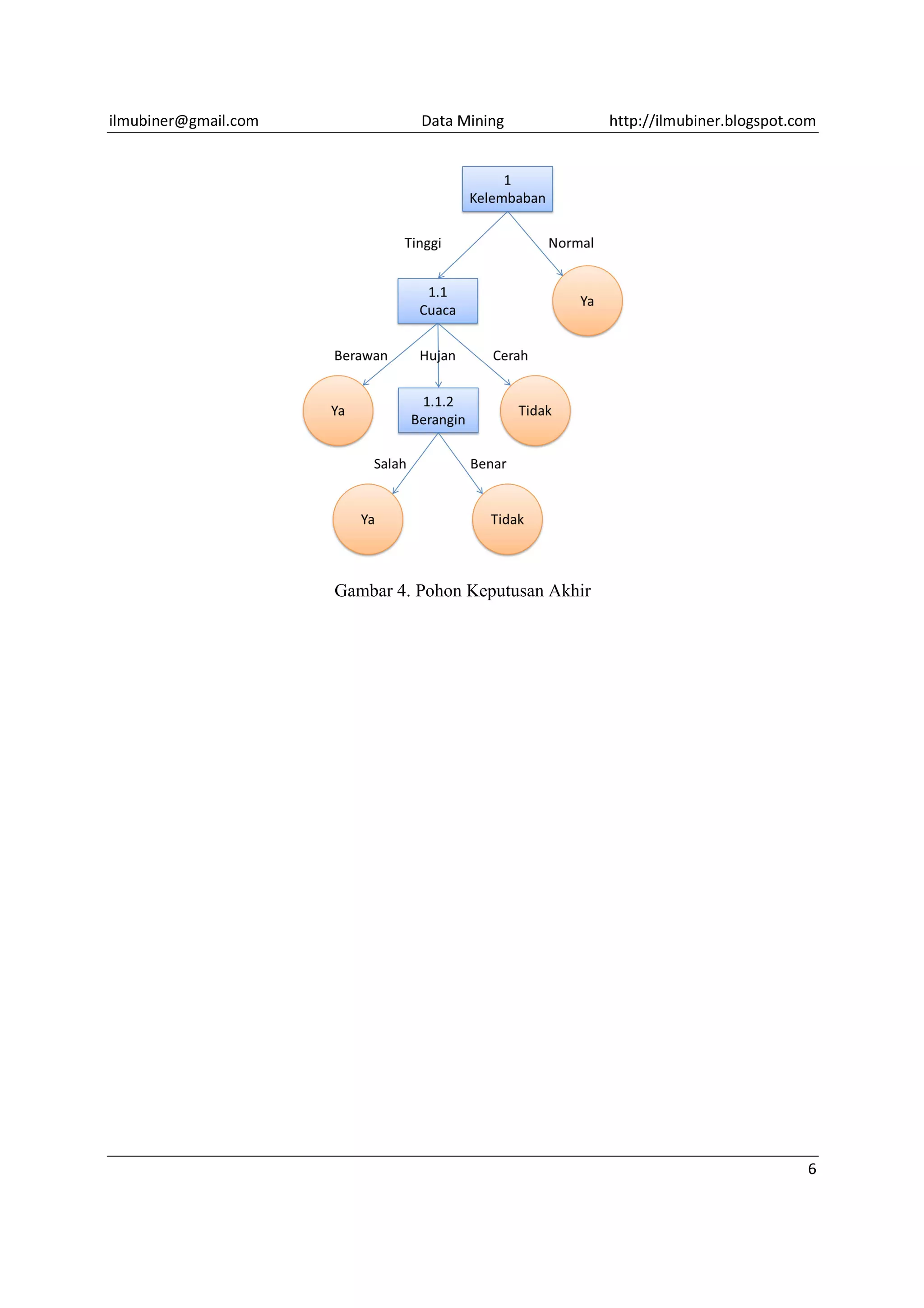

Algoritma C4.5 digunakan untuk membangun model klasifikasi berbasis pohon keputusan dari sekumpulan data latih. Algoritma ini memilih atribut mana yang paling berguna untuk membedakan kelas target dengan mengukur besarnya pengurangan entropi. Atribut dengan pengurangan entropi terbesar akan menjadi node akar, kemudian proses ini diulang rekursif hingga terbentuk pohon keputusan lengkap. Contoh penerapannya adalah