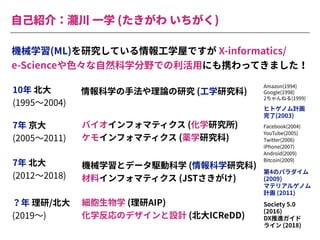

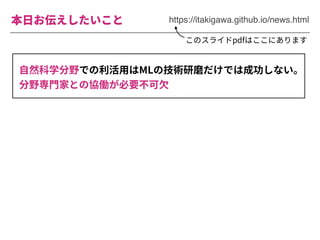

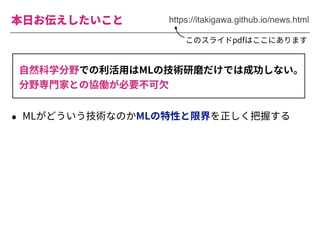

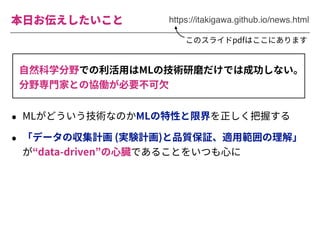

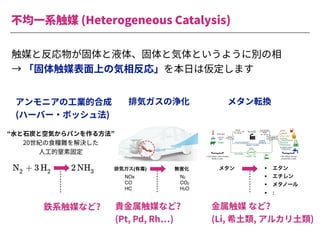

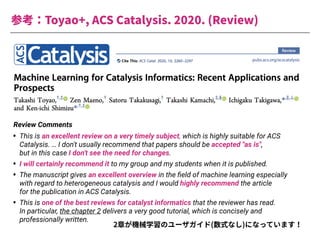

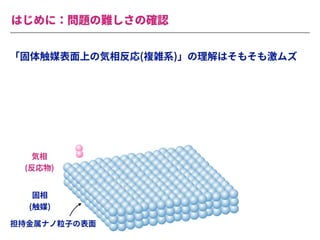

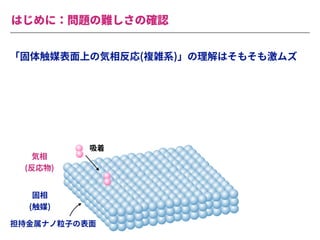

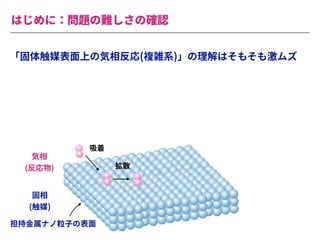

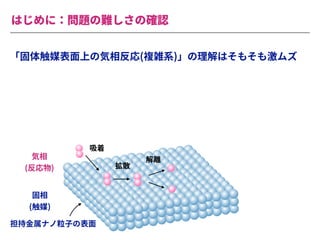

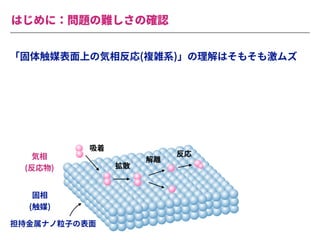

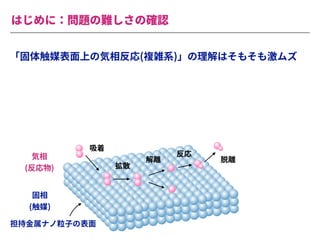

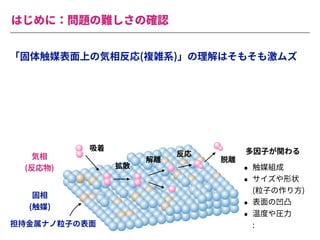

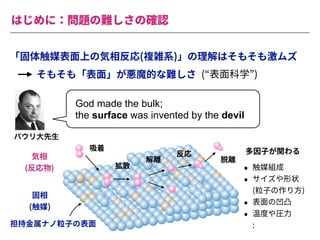

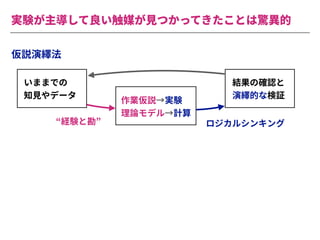

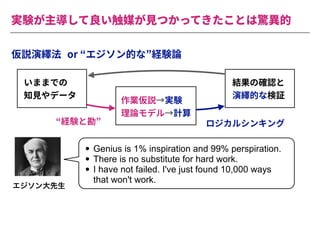

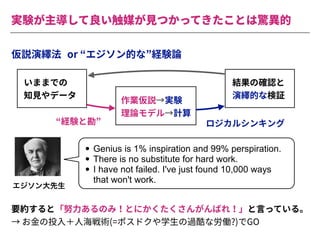

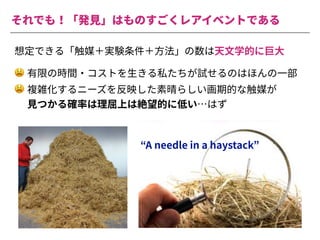

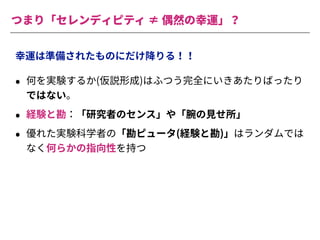

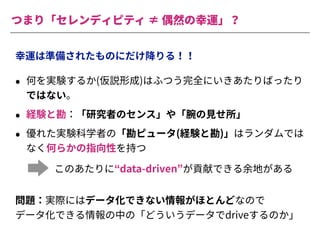

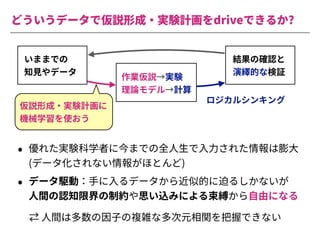

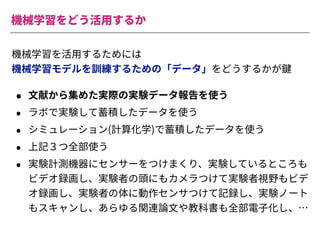

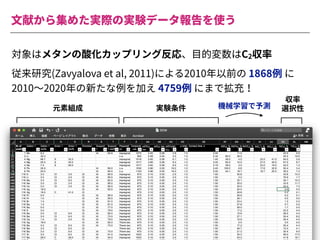

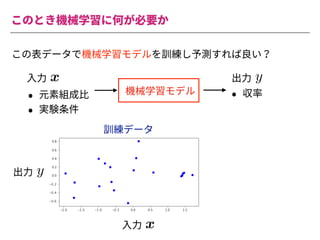

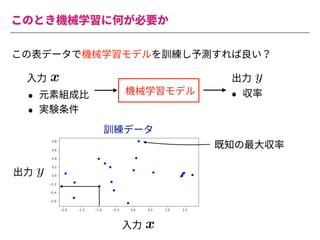

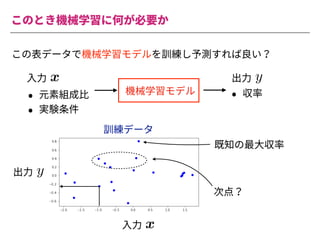

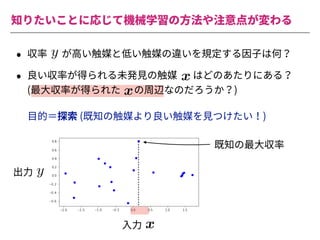

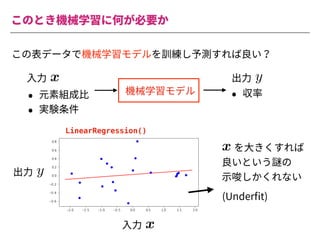

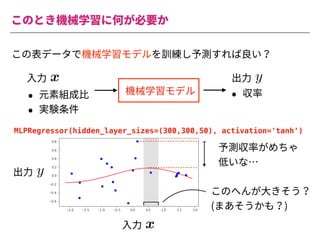

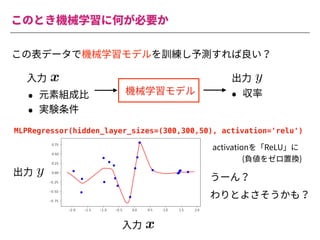

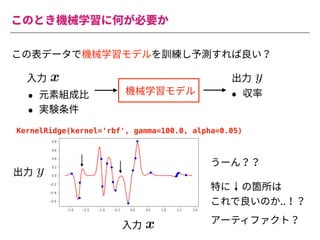

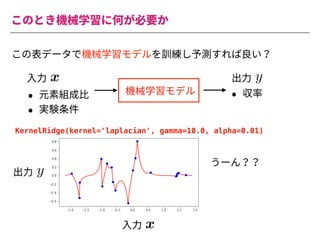

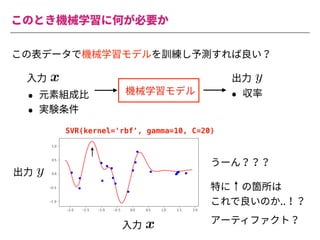

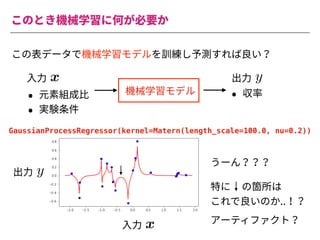

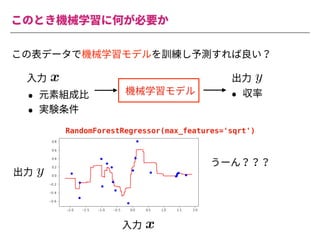

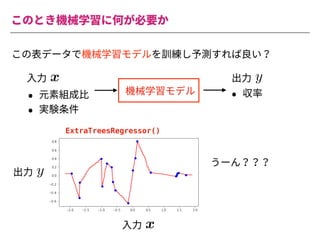

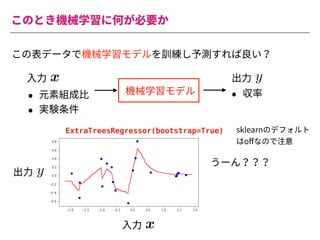

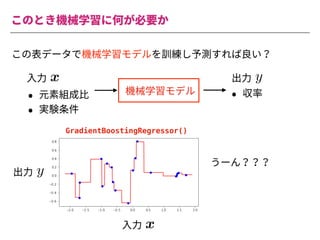

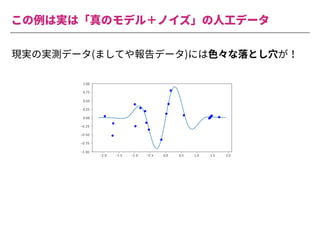

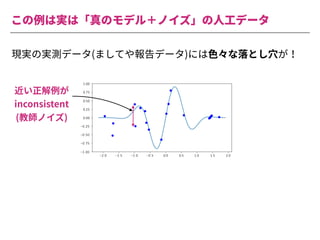

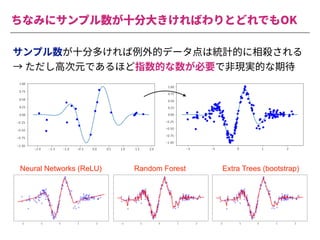

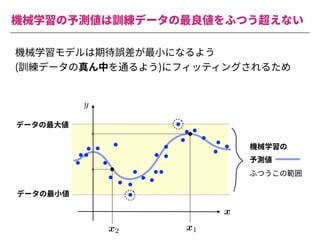

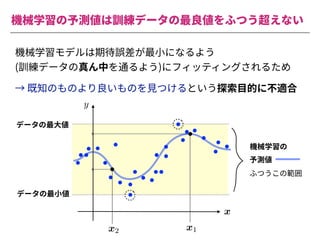

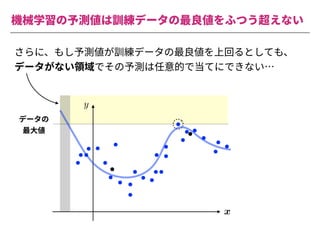

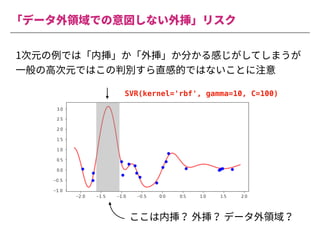

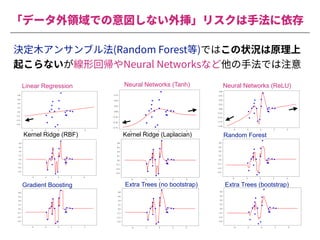

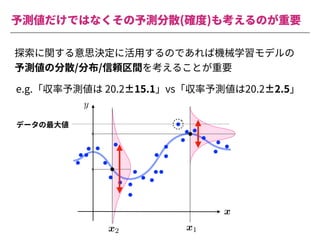

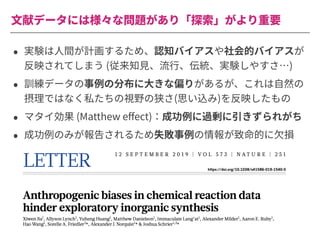

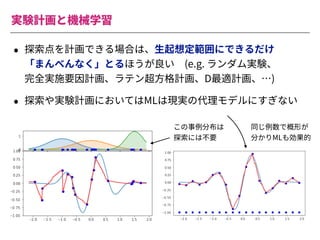

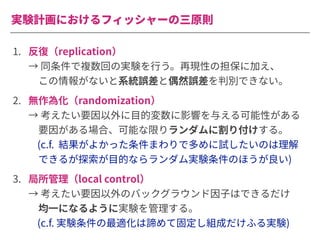

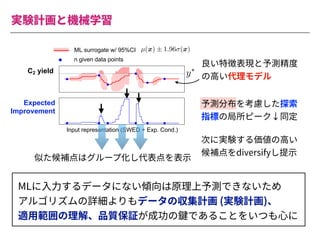

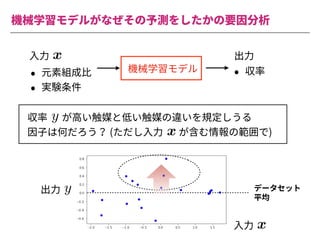

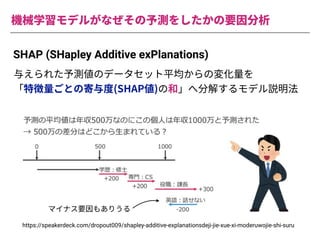

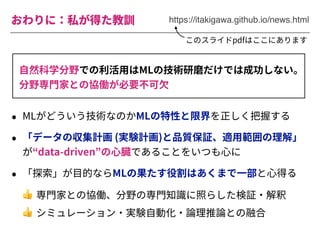

The document summarizes a presentation by Itakawa Ichigaku on using machine learning and optimal experimental design for heterogeneous catalysis research. Itakawa introduces himself and his background working in machine learning and its applications in natural science fields. He emphasizes that applying machine learning to natural sciences requires close collaboration with domain experts and understanding ML's capabilities and limitations. The presentation aims to help audiences understand these points and properly position ML's role in exploratory research through examples from his past work.