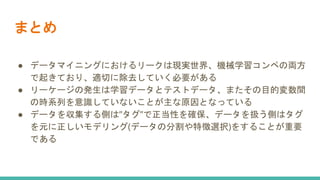

データマイニングや機械学習をやるときによく問題となる「リーケージ」を防ぐ方法について論じた論文「Leakage in Data Mining: Formulation, Detecting, and Avoidance」(Kaufman, Shachar, et al., ACM Transactions on Knowledge Discovery from Data (TKDD) 6.4 (2012): 1-21.)を解説します。

主な内容は以下のとおりです。

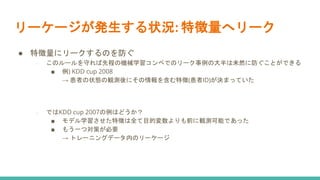

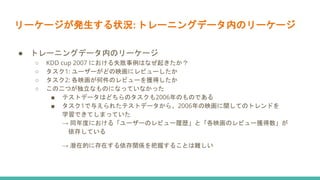

・過去に起きたリーケージの事例の紹介

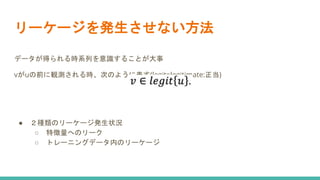

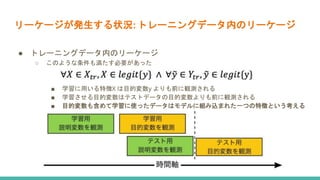

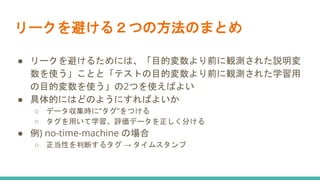

・リーケージを防ぐための2つの考え方

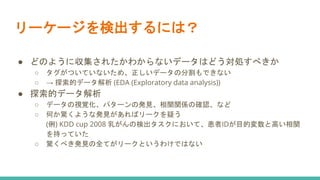

・リーケージの発見

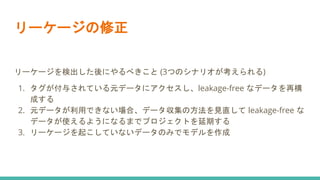

・リーケージの修正