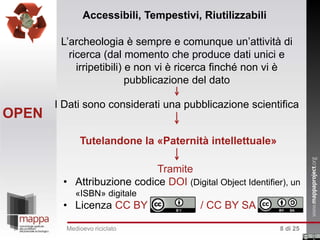

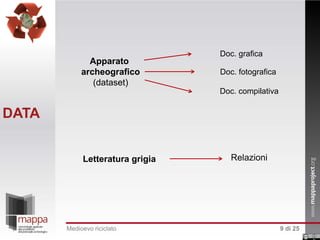

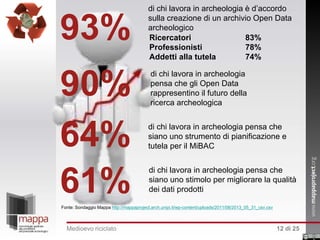

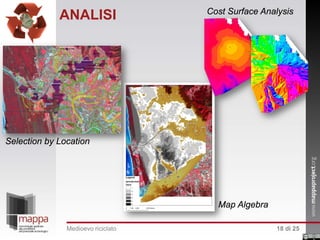

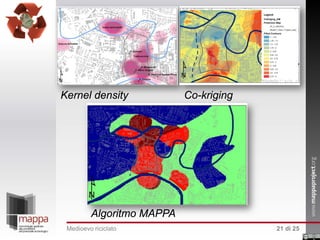

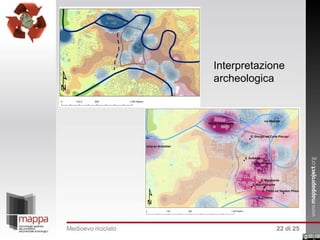

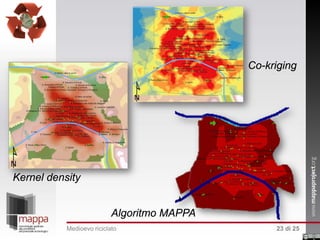

Il documento discute l'importanza di un approccio collaborativo nel settore dell'archeologia per utilizzare e riutilizzare i dati archeologici, enfatizzando la necessità di una pubblicazione open access. Viene evidenziato come l'analisi dei dati possa migliorare la ricerca archeologica medievale attraverso l'uso di metodi matematici e modelli predittivi. Inoltre, il documento sottolinea la necessità di rendere i dati aperti e accessibili per promuovere la qualità e la pianificazione della ricerca.