ビッグデータと叫ばれ始め早数年。蓄積した大規模データを活用するための一つの手段として、「機械学習(Machine Learning)」や「地理空間分析(Geospatial Analytics)」が注目されています。本セッションでは、ビッグデータ用データベースとしてのVerticaが備えているインデータベース機械学習機能や地理空間分析機能を使って、容易かつ高速に予知保全(Predictive Maintenance)をはじめとする予測分析を行えることを具体例を交えながら、時にディープに解説します。

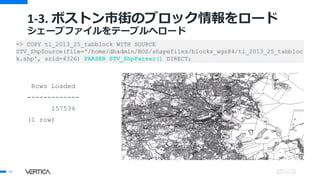

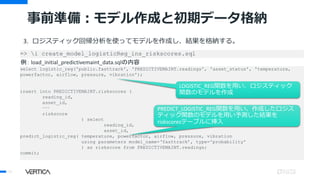

![ボストン市街の道路の「穴」

Block Pothole Density:

各ブロックの穴の密度を計算

46

potholes ph blocks_idx roads rd

Spatial Join

[ph.id, block_id]

Spatial Join

[rd.id, block_id]

Group By

[block_id, count(ph.id)]

Group By

[block_id, count(rd.id)]

Join

[block_id, count(ph.id)/count(rd.id)]

Query Result

x

x

x

x pothole road

Block Pothole Density = 3/2

# potholes

# roads

補修すべきボストン市街の道路を分析する](https://image.slidesharecdn.com/d15-170912022443/85/db-tech-showcase-Tokyo-2017-D15-Vertica-by-46-320.jpg)