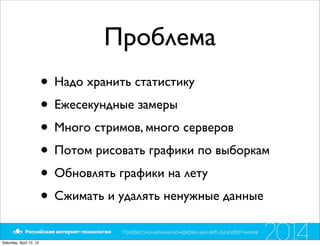

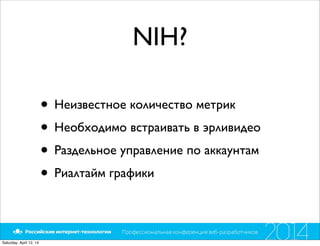

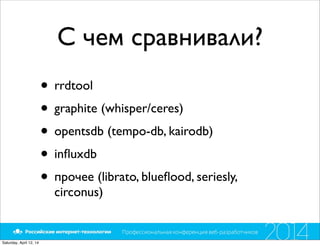

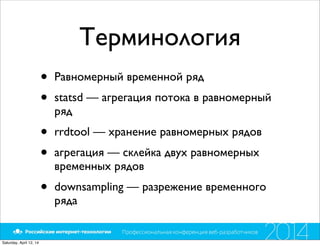

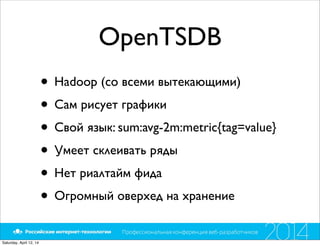

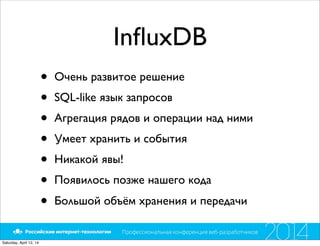

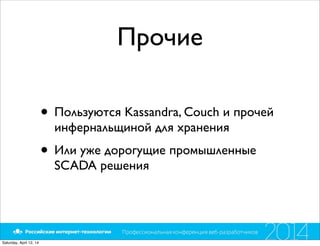

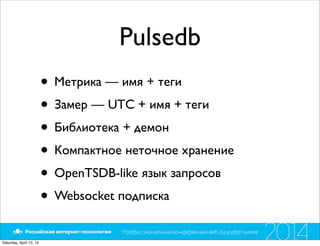

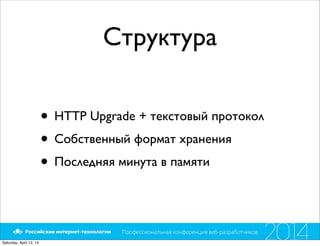

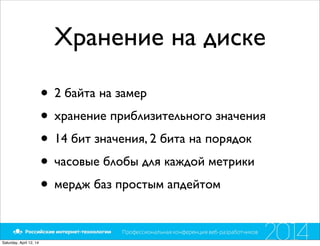

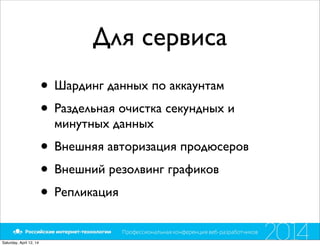

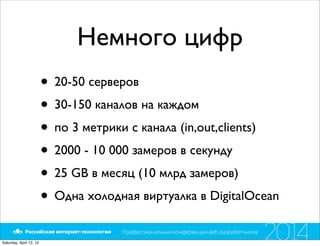

Документ описывает систему хранения и анализа временных рядов под названием pulsedb, предназначенную для обработки ежесекундных замеров статистики с различных стримов и серверов. Основное внимание уделяется функциональности системы, ее различиям с другими инструментами, такими как rrdtool и influxdb, а также особенностям хранения и транспортировки данных. Упоминается необходимость в риалтайм графиках и раздельном управлении метриками по аккаунтам.