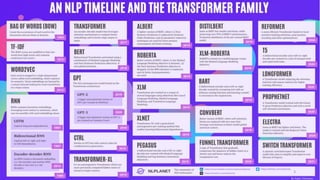

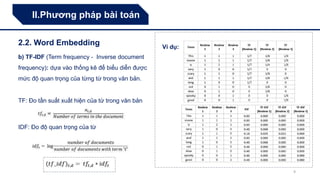

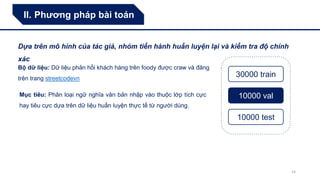

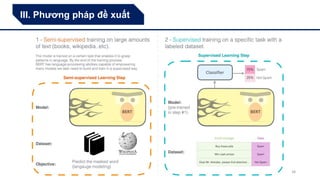

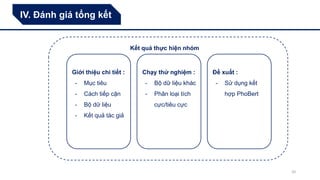

Tài liệu trình bày một nghiên cứu về phân loại văn bản tiếng Việt, nhấn mạnh mục tiêu phân loại chủ đề và cảm xúc của văn bản. Nghiên cứu sử dụng các phương pháp như SVM kết hợp với TF-IDF và bag of words, đồng thời thử nghiệm với bộ dữ liệu đa dạng. Kết quả cho thấy tiềm năng của các mô hình học máy trong việc phân loại văn bản tiếng Việt.