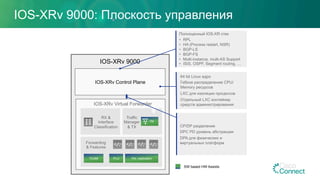

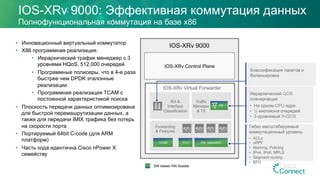

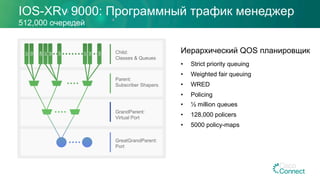

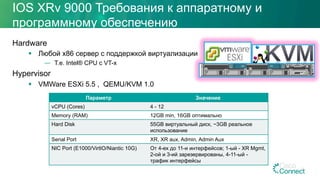

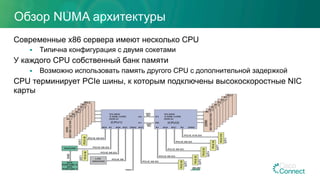

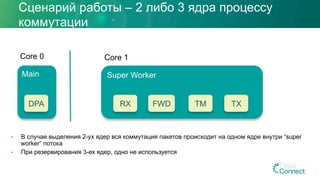

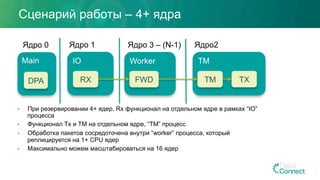

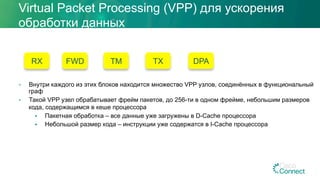

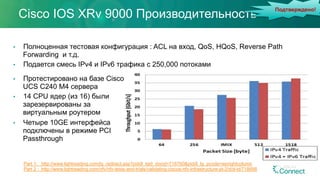

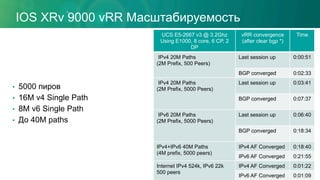

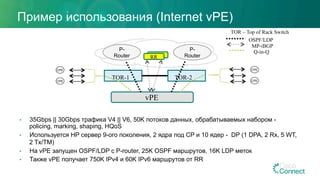

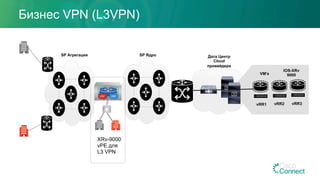

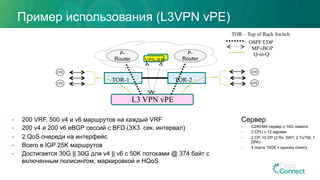

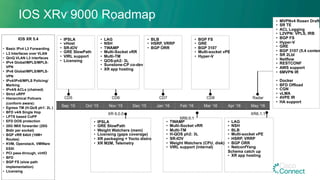

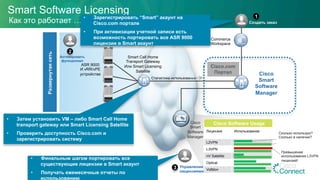

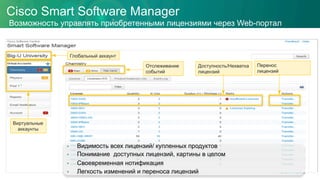

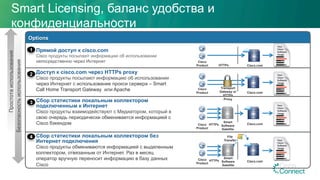

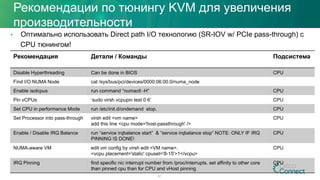

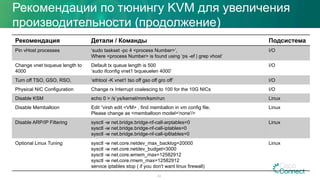

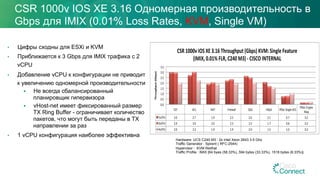

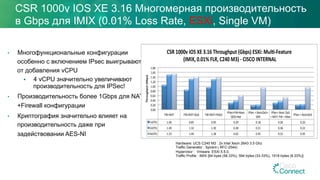

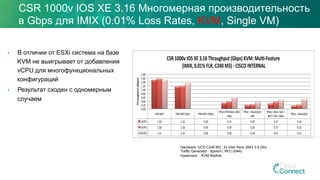

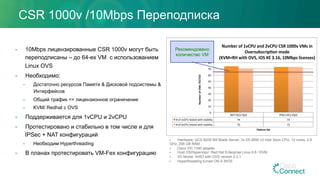

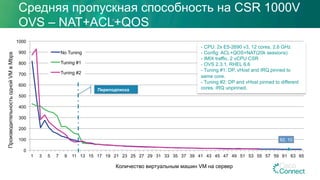

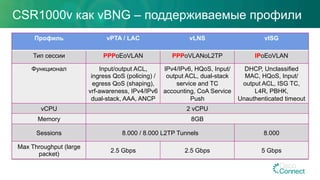

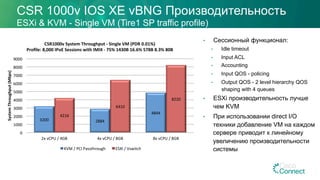

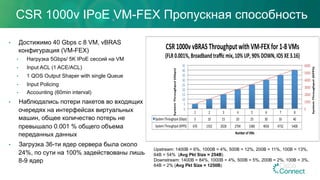

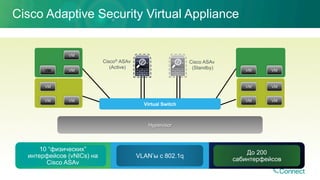

Документ посвящен виртуализации сетевой инфраструктуры с использованием IOS-XRV 9000 и CSR 1000V, описывая их архитектурные особенности и возможности масштабирования. Рассматриваются подходы к управлению ресурсами, лицензированию, а также производительности, включая различные сценарии применения и поддержку многопоточности. Представленные данные подтверждают высокую производительность и гибкость решения Cisco в контексте современных вычислительных требований.