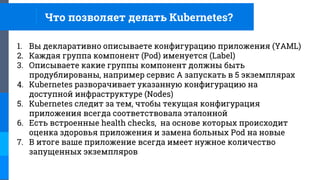

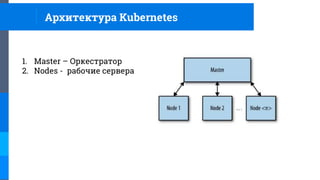

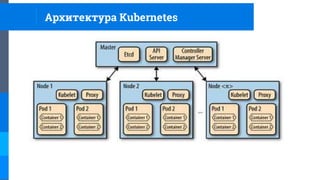

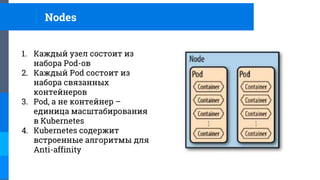

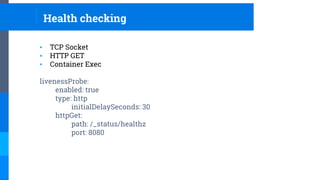

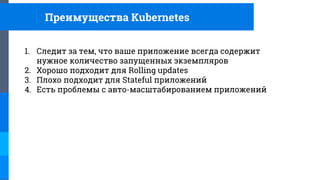

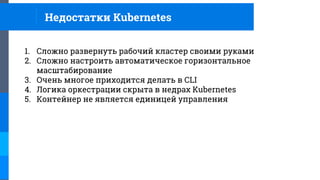

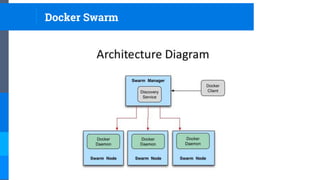

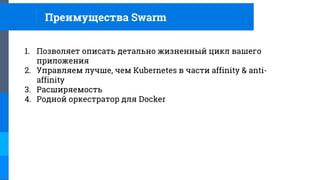

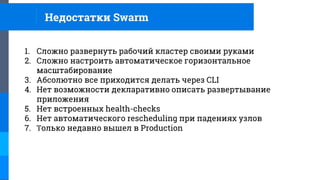

Документ сравнивает оркестраторы контейнеров Docker Swarm и Kubernetes, описывая их архитектуры, функциональности и преимущества. Kubernetes предлагает мощные функции автоматизации и управления, такие как декларативное описание конфигураций и встроенные проверки состояния, но имеет сложности в настройке и использовании CLI. Docker Swarm, в свою очередь, более интуитивен для разработчиков, но ограничен в функционале и требует много ручной работы.