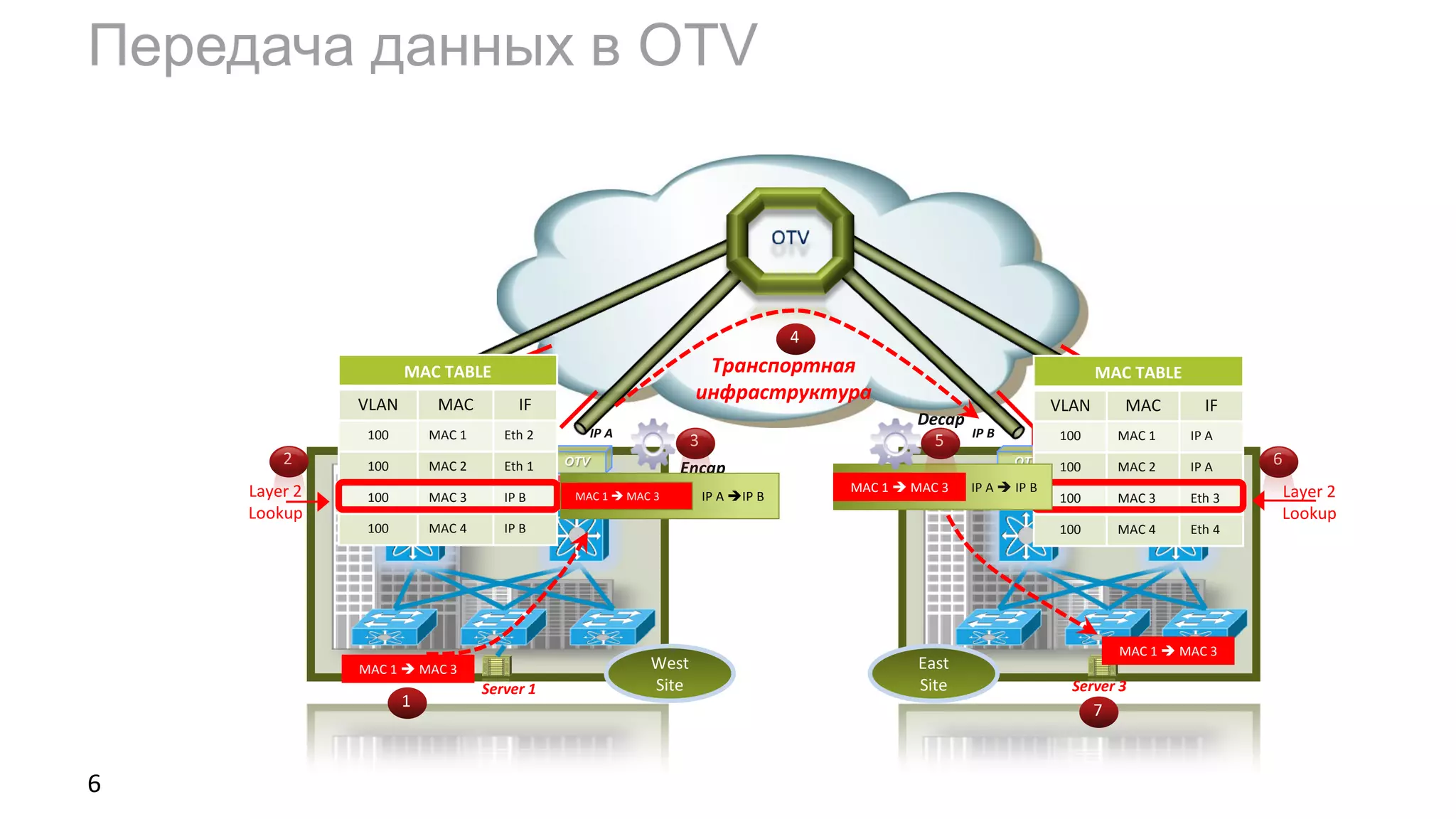

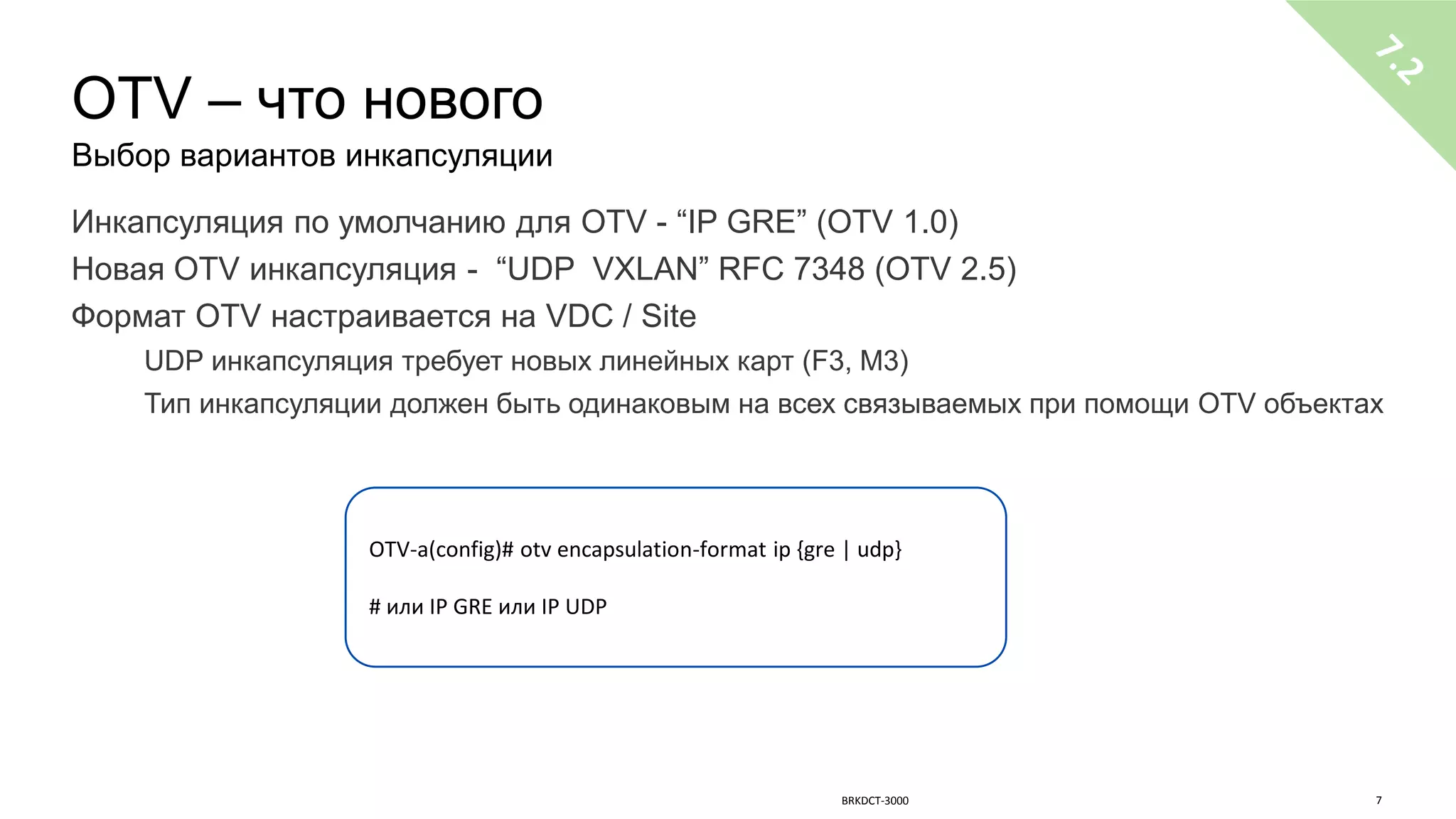

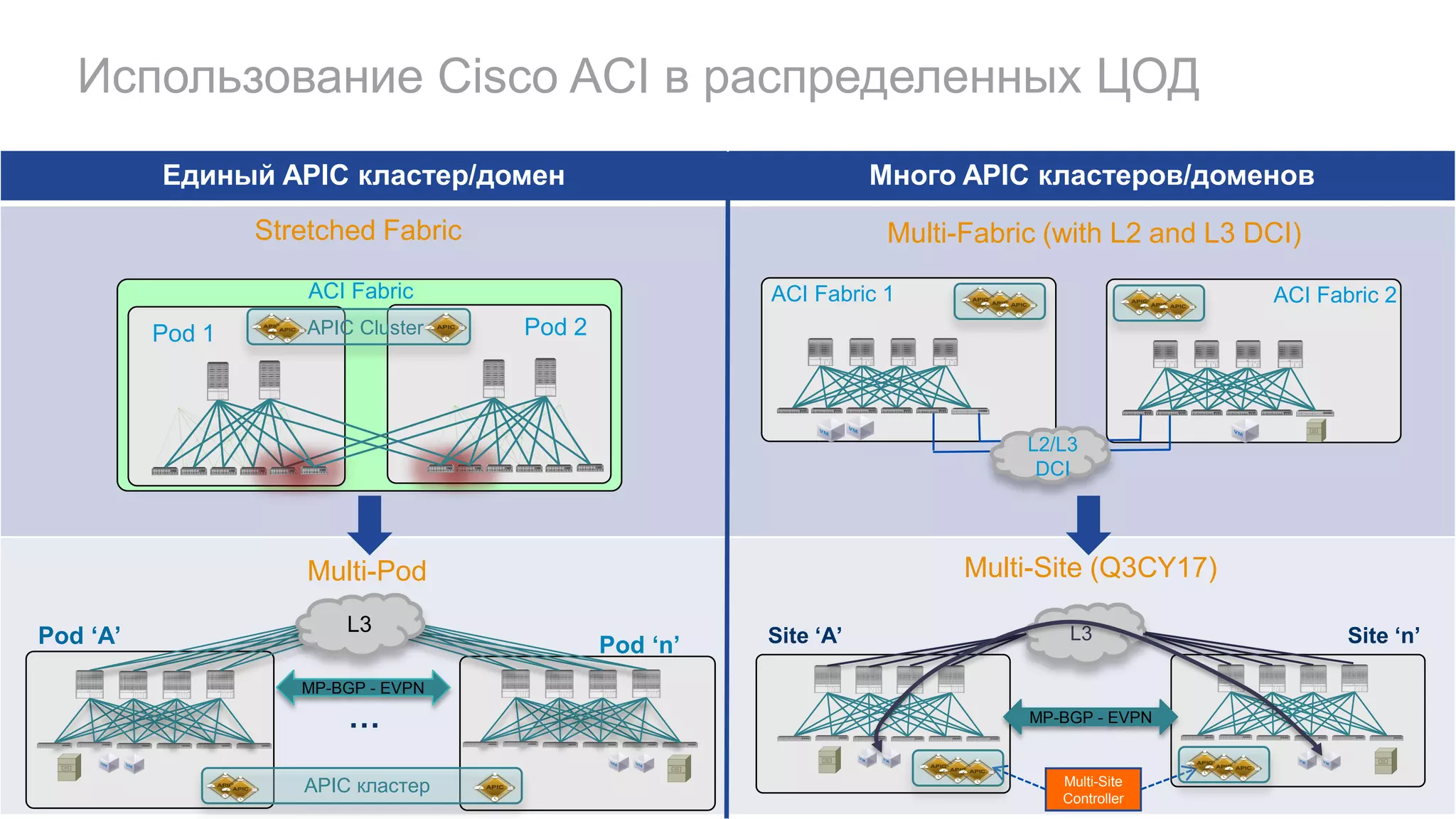

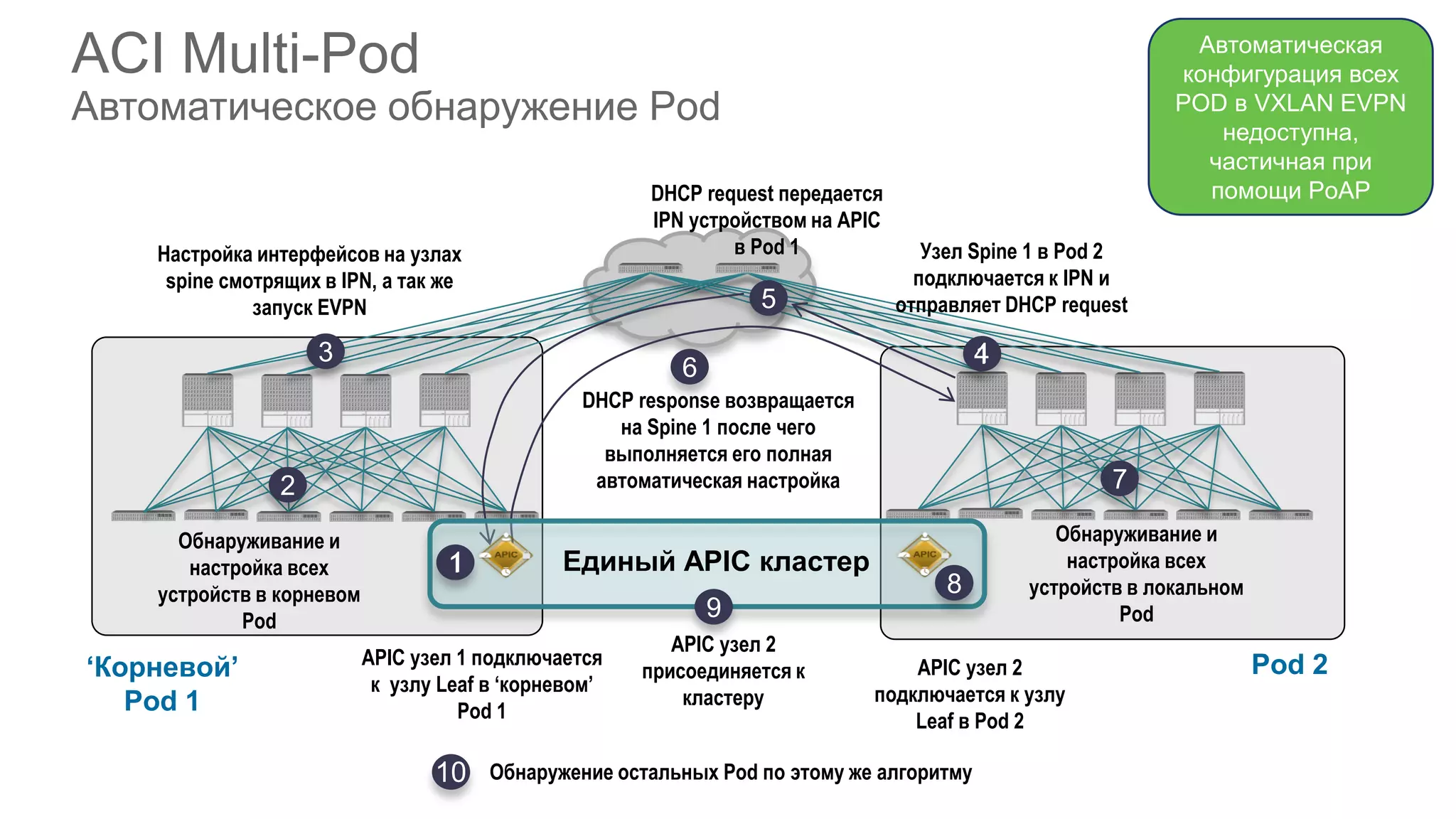

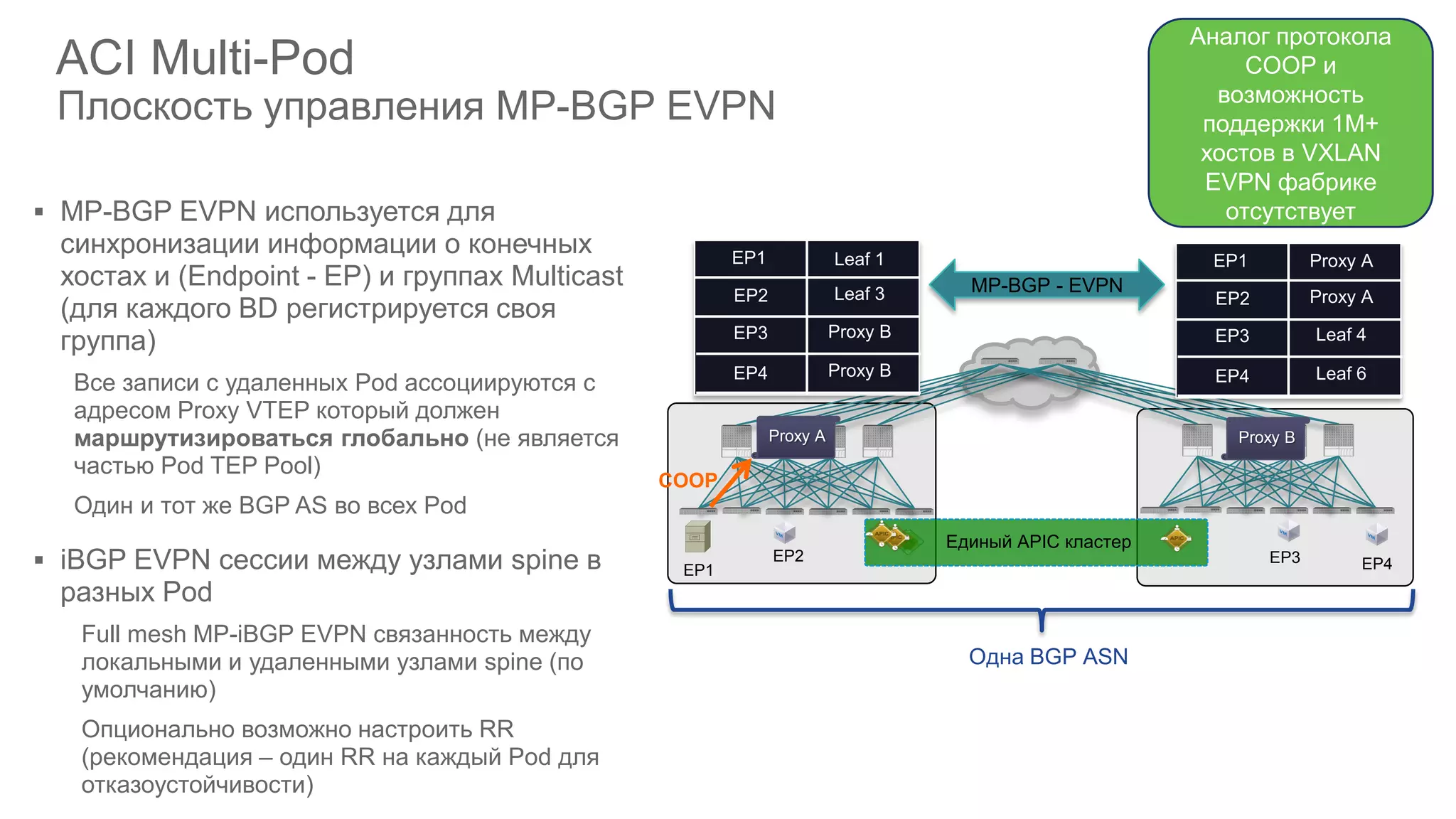

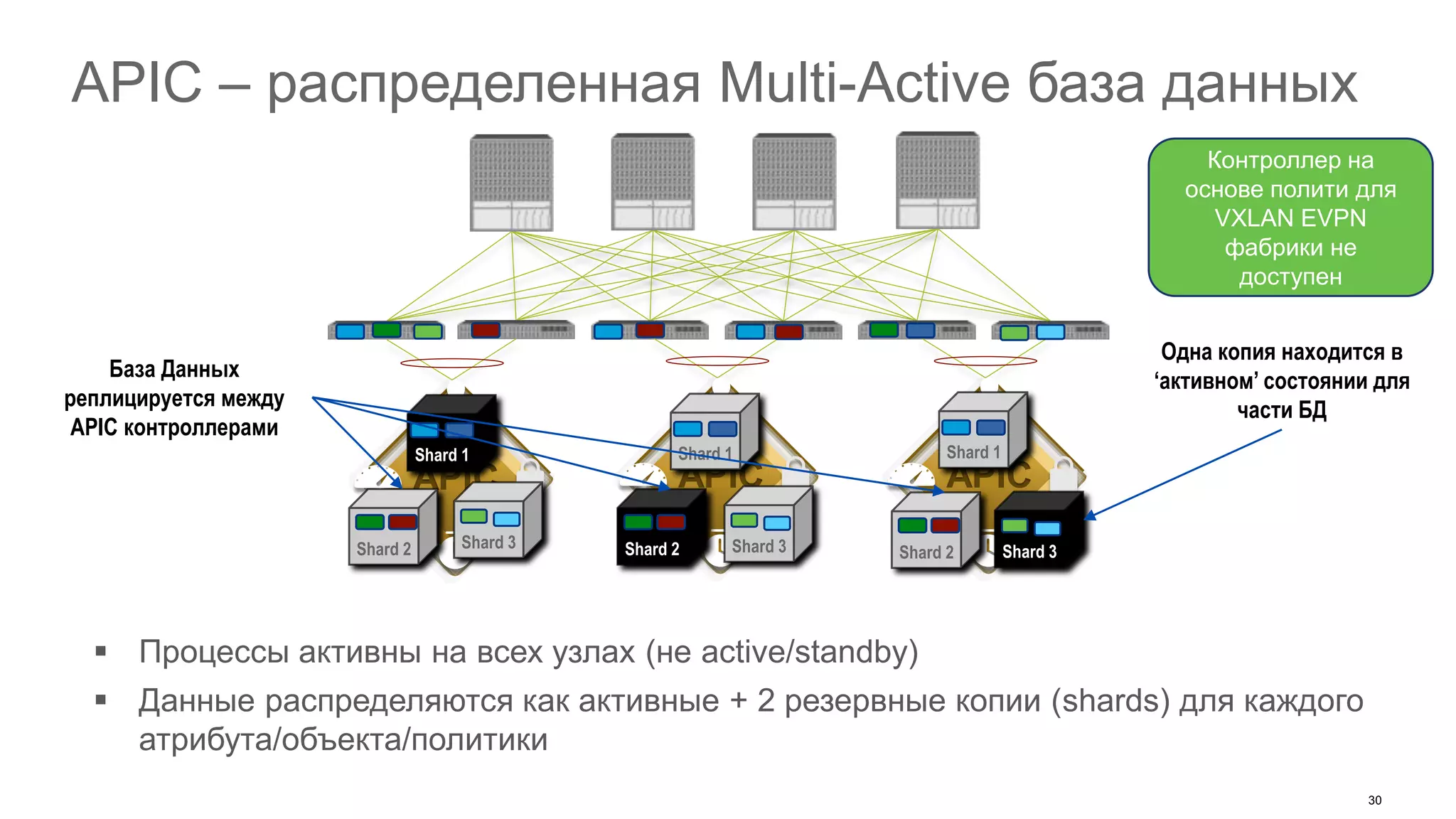

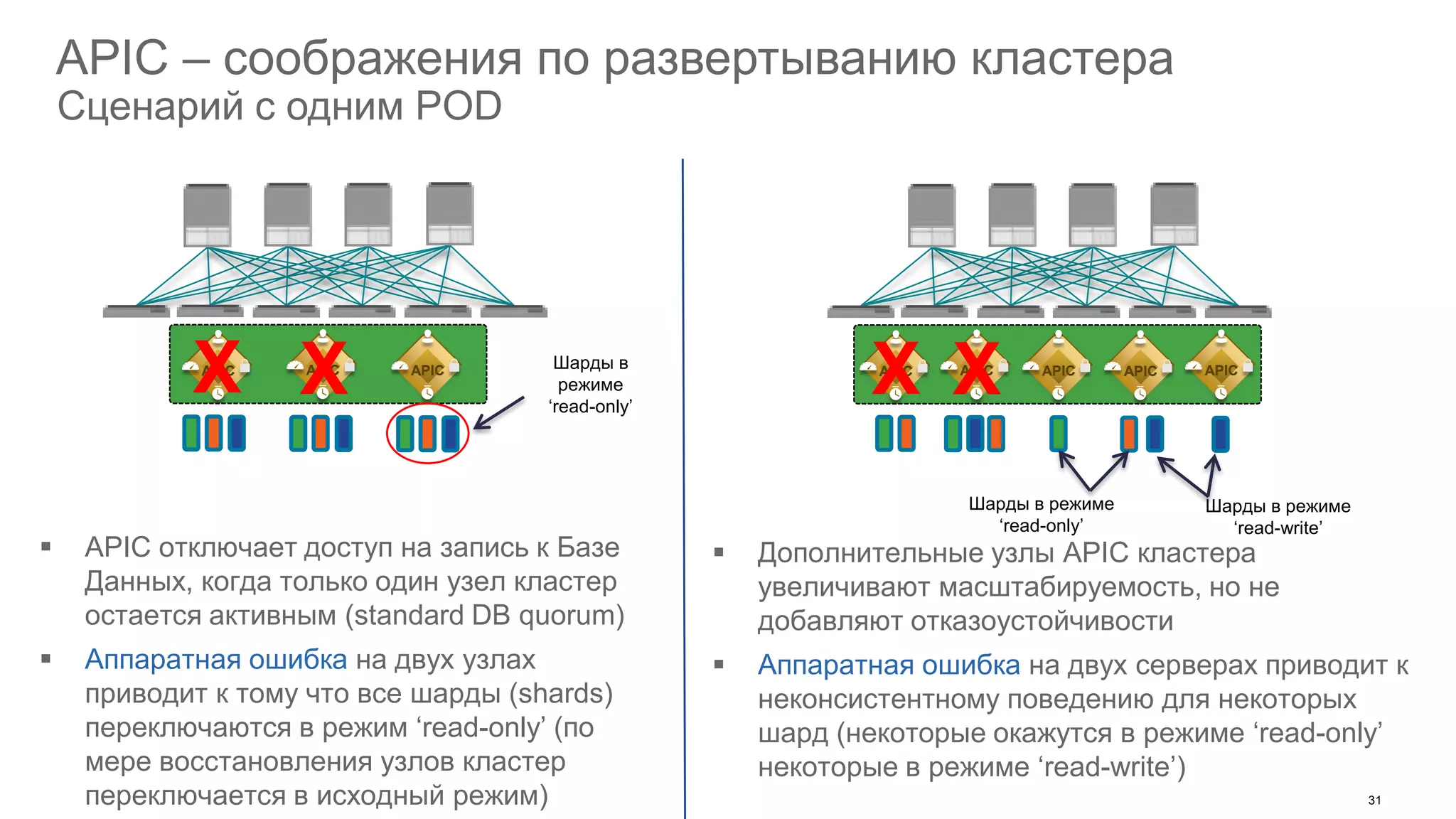

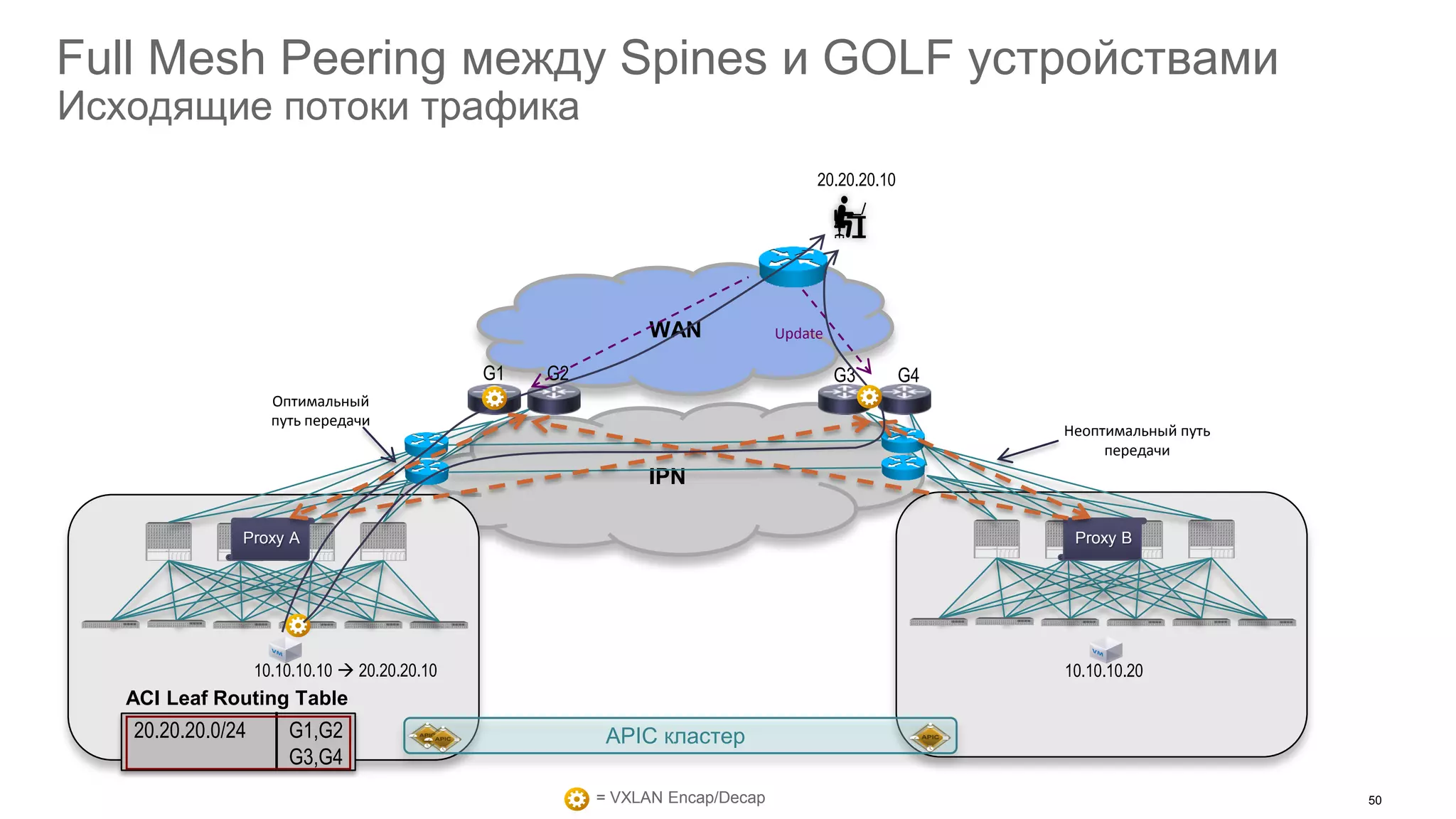

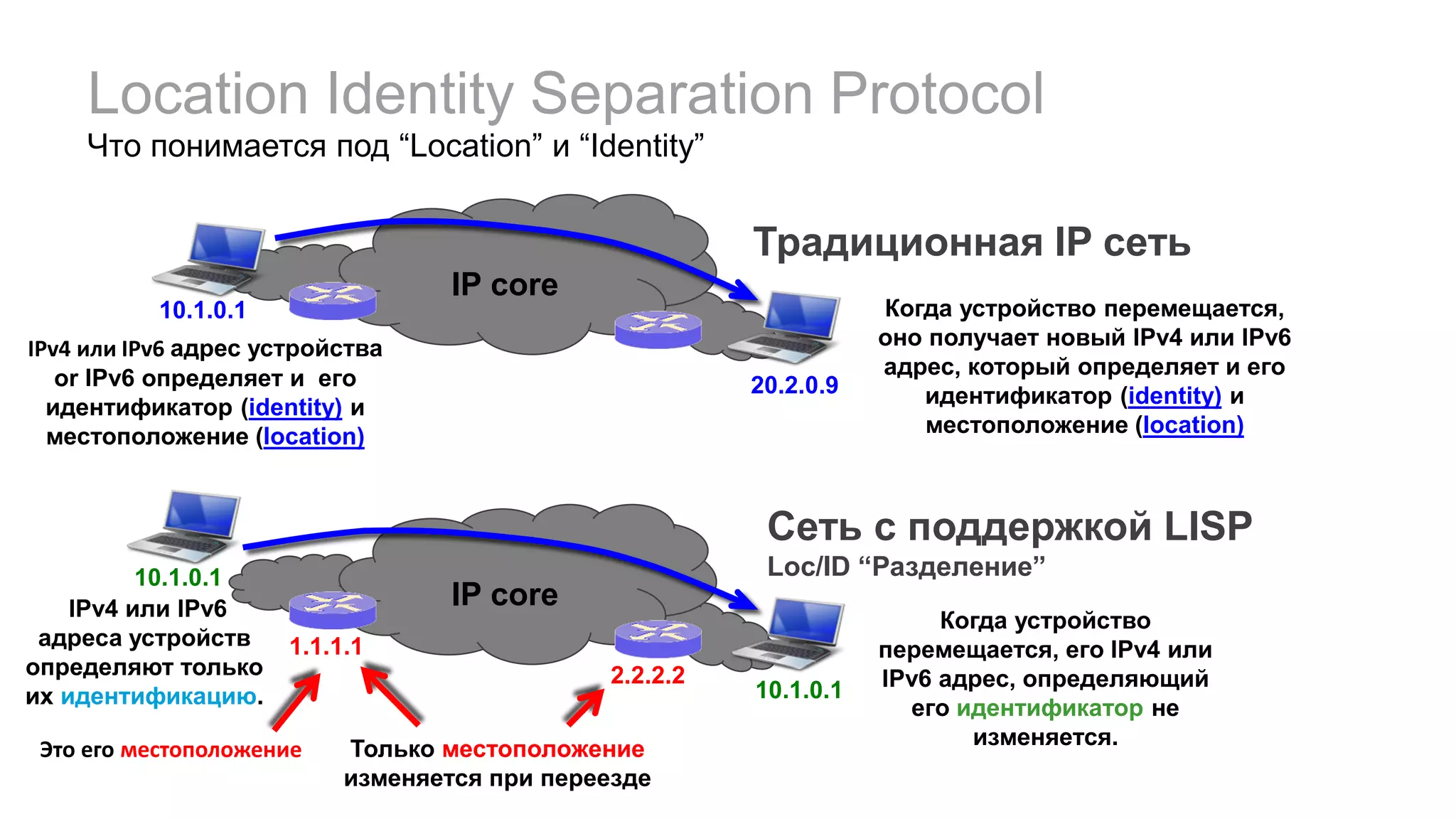

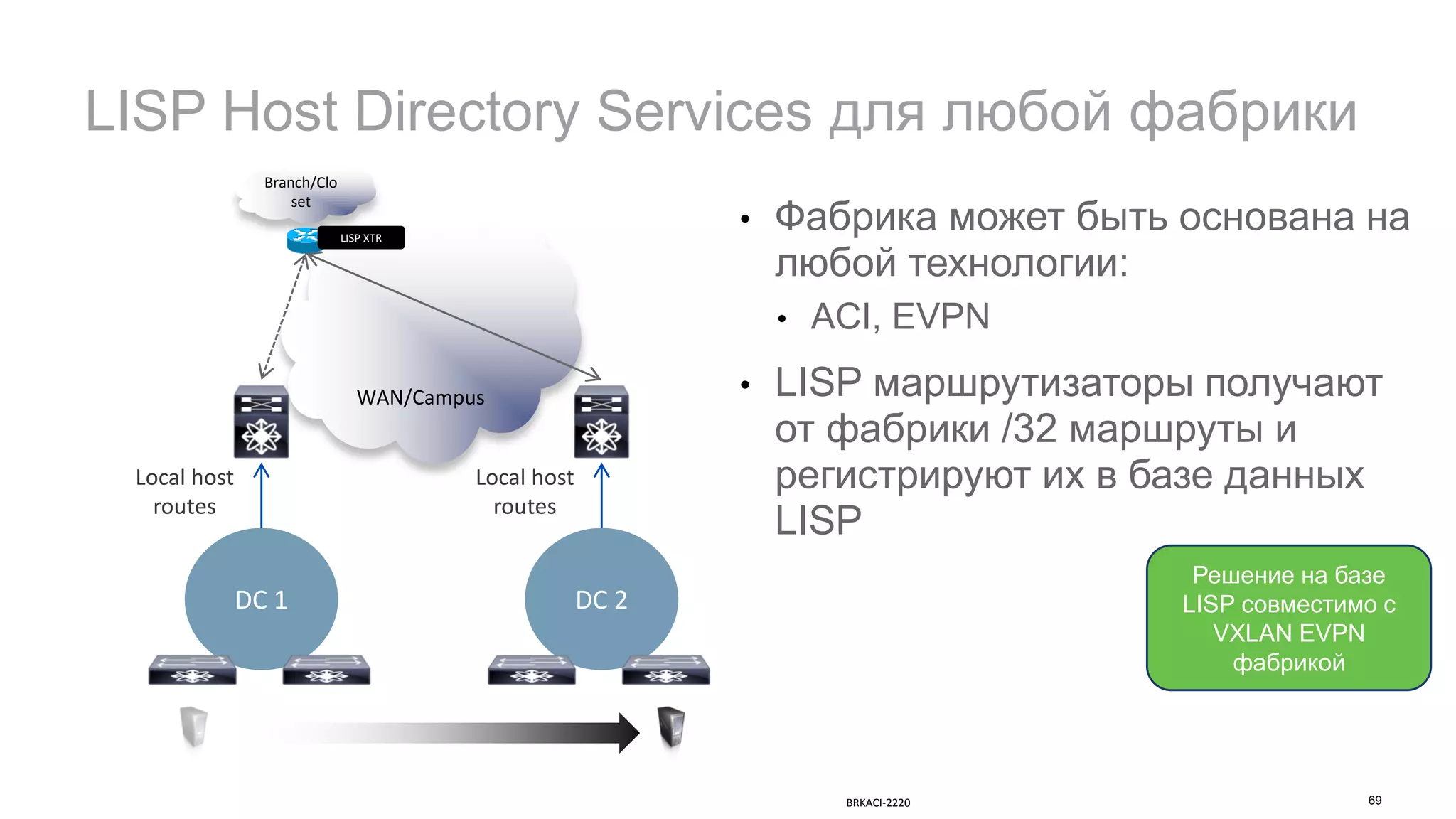

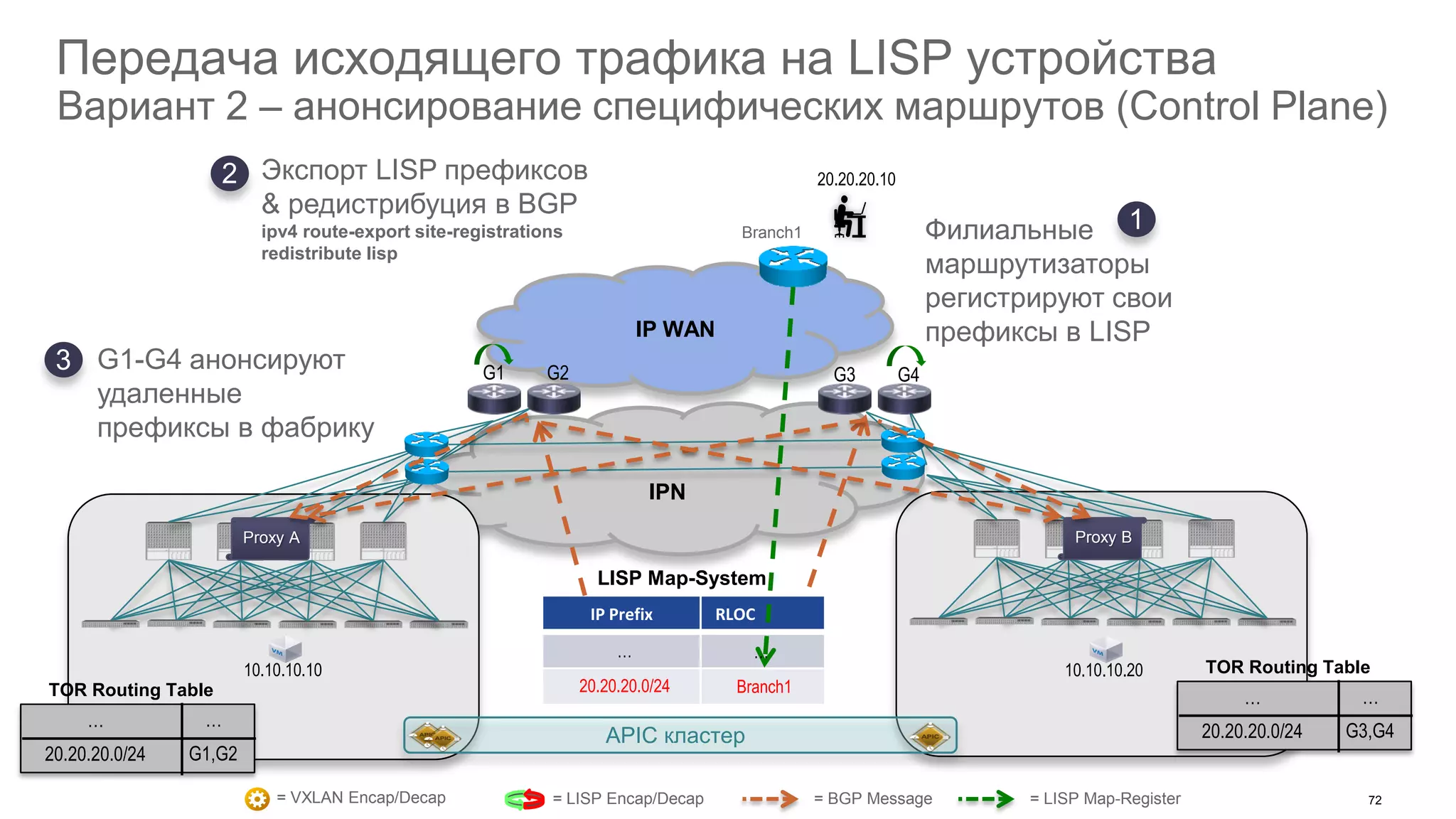

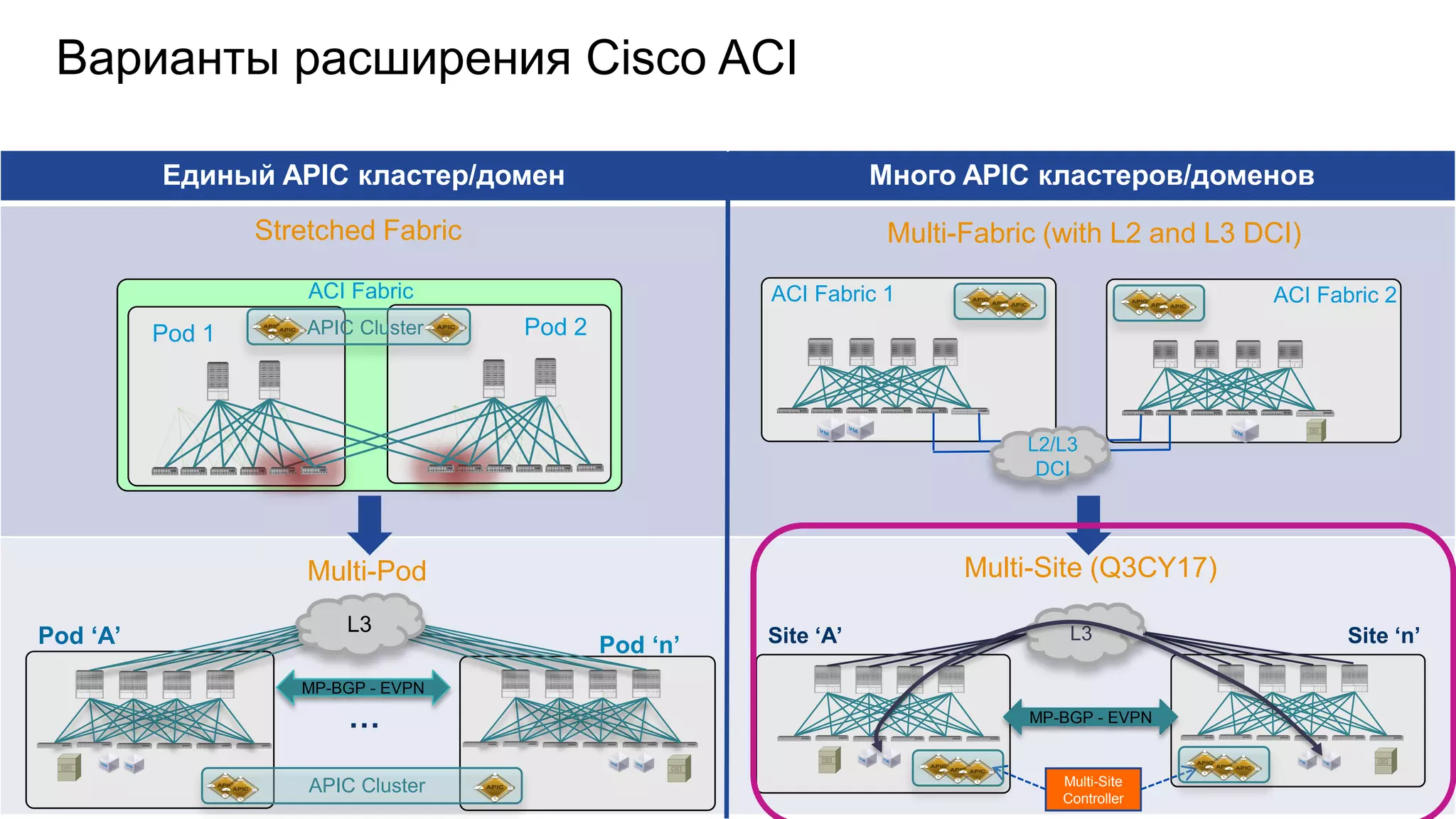

Документ описывает применение технологий Cisco, включая OTV и ACI, для построения эффективных и надежных систем связи между территориально распределенными центрами обработки данных (ЦОД). Основное внимание уделяется архитектуре ACI multipod, а также методам обеспечения отказоустойчивости и управления трафиком в сети. Приводятся технические требования и плюсы использования современных методов инкапсуляции, таких как VXLAN EVPN, в распределенной инфраструктуре ЦОД.