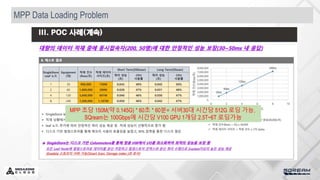

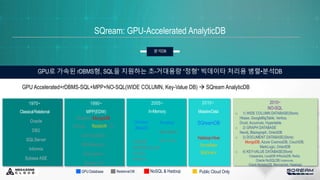

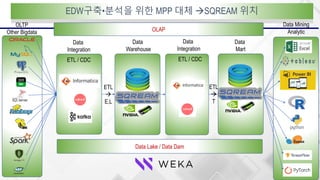

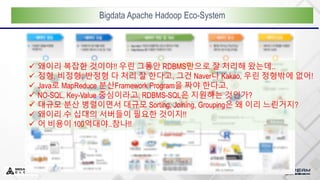

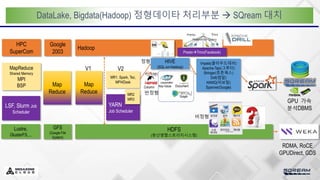

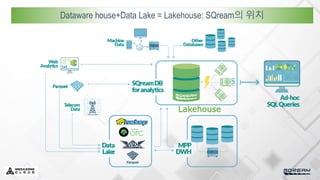

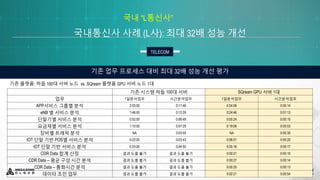

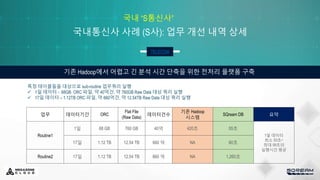

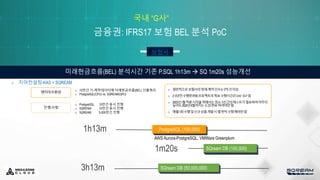

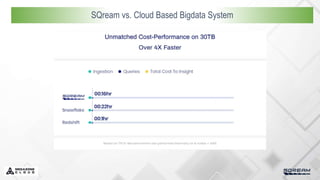

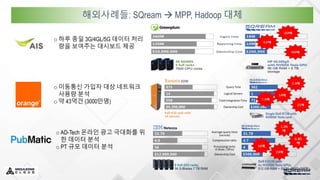

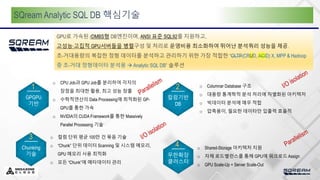

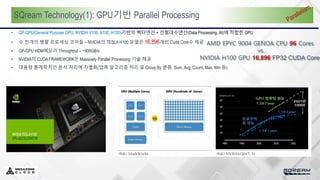

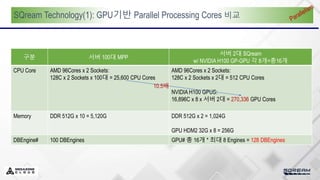

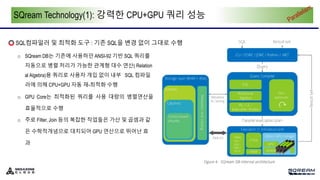

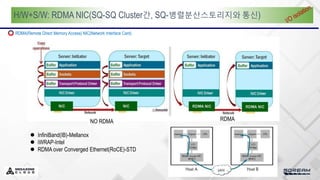

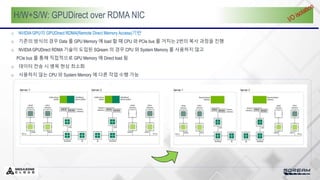

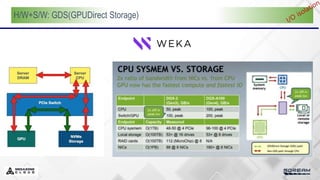

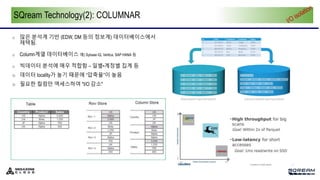

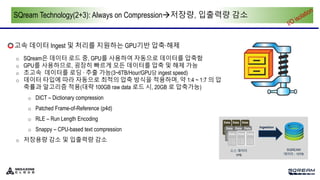

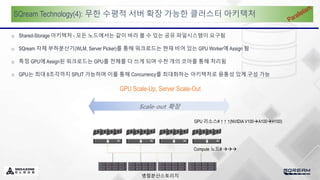

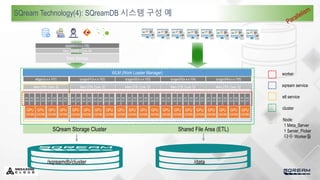

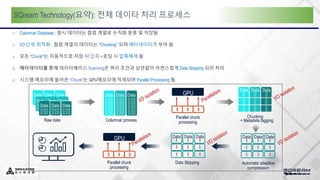

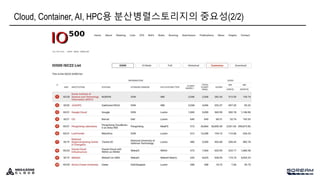

This document provides a comprehensive overview of Sqream, a GPU-accelerated analytical database management system optimized for processing extremely large structured data (over 1 PB). It details the company's history, revisions in documentation, key use cases in telecommunications and finance, and comparisons of performance against traditional systems. The document emphasizes Sqream's capabilities in achieving significant performance improvements and efficiency in data handling for big data analytics.

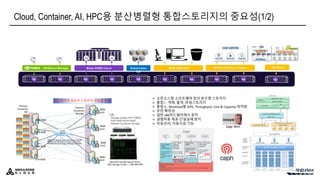

![통합솔루션

분산스토리지(WEKA.IO) Lakehouse(SQream) AI분석플랫폼(w/ GPU, IPU)

15

WekaIO Confidential © 2019 All rights reserved.

Data Lake

WekaFS

Weka Client

The Weka File System

Combines NVMe performance with massive scale of S3 Object Storage

Ethernet or InfiniBand Network

Storage Servers

Unified Namespace

S3

Public

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

APP

SMB

SMB

NFS

NFS

APP APP

GPU GPU

APP APP

GPU GPU

APP APP

GPU GPU

APP APP

GPU GPU

APP APP

GPU GPU

APP APP

GPU GPU

APP APP

GPU GPU

APP APP

GPU GPU

Top3급 분산스토리지 최고속도의 분석DBMS 최고성능 AI훈련 및 추론솔루션

Megazone Offerings

Copyright 2020 © MEGAZONE CLOUD CORP. ALL RIGHT RESERVED.

요약: GRAPHCORE & MZC AI/MI 통합 솔루션 및 AI HPC Cloud 플렛폼 제공

AIàMI(ML,DL)을 위한 Neutral-Net 프로세서, 전용IPU카드, 범용 및 전용시스템, 소프트웨어스텍, 네트워크 아키텍쳐, AI HPC〮Cloud 플렛폼을

제공

COLOSSUS

IPU Chipset

IPU-M2000

x4 IPUs

Poplar®

SDK

OpenStack Mega Edition

Ceph Storage Mega Edition

x2 Cards, x4 IPUs

IPU Server4

x8 Cards, x16 IPUs

IPU Server16

Neural-Net

프로세서

범용시스템 전용시스템

소프트웨어 스텍

및 관리프로그램

전용 네트워크

아키텍쳐

AI HPC | AI HPC Cloud

IPU-POD64

x16 IPU-M2000, x64 IPUs

IPU-PROCESSOR

PCIE CARD

[전용IPU카드]

IPU-Server IPU-MACHINE

IPU-POD128 per Rack, 1,024Racks

64K IPUs, 16ExaFlops

Matilda AI Platform

w/ GPU & IPU](https://image.slidesharecdn.com/sqream-gpusqldb-20230131-230208003051-832c326a/85/SQream-GPU-SQL-DB-46-320.jpg)