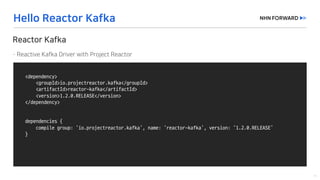

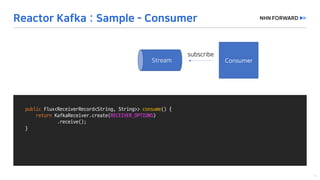

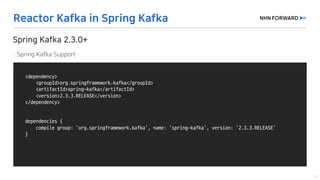

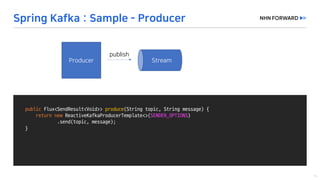

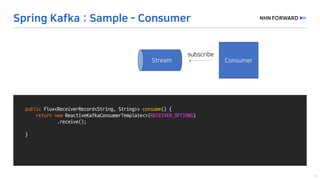

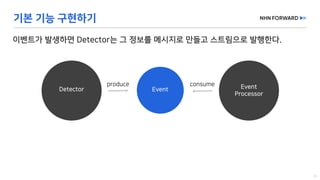

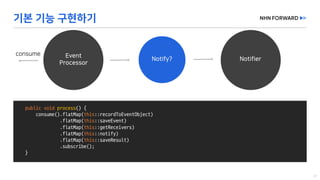

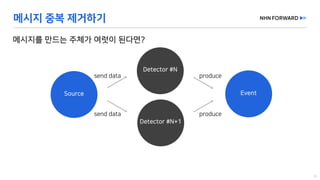

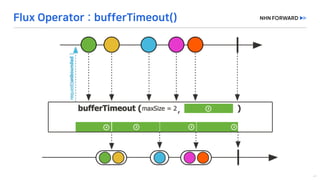

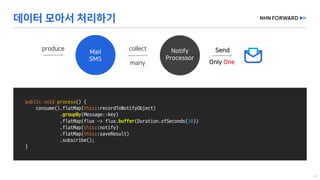

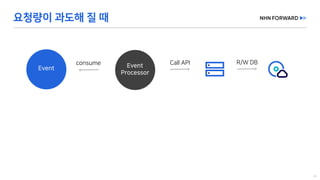

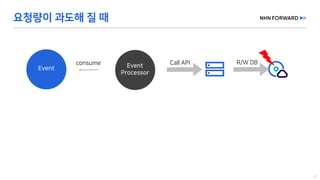

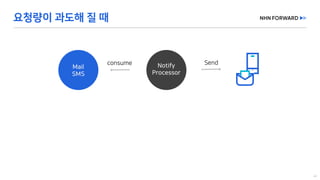

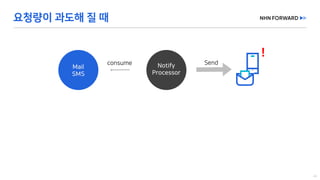

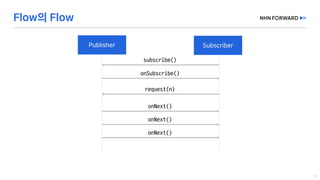

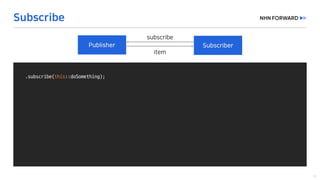

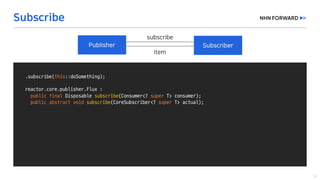

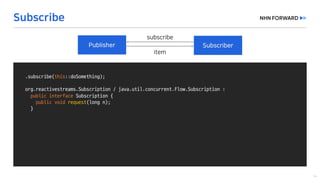

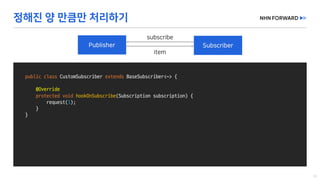

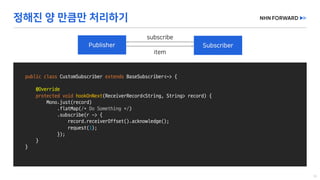

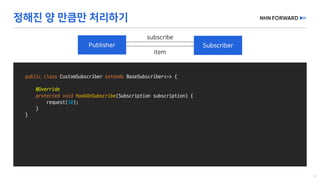

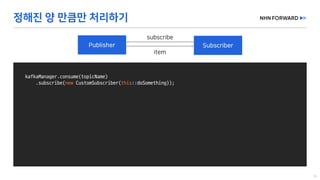

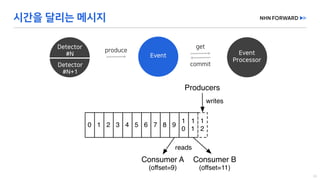

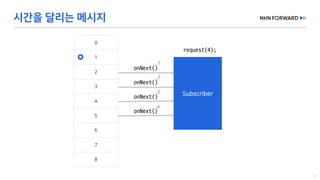

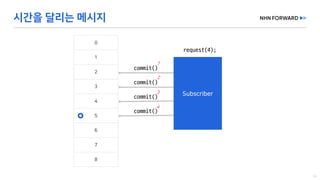

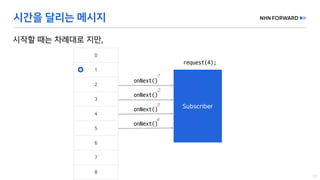

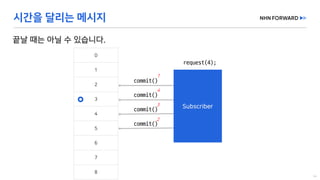

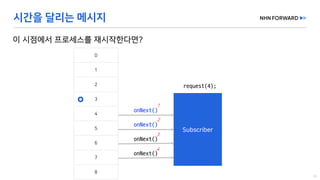

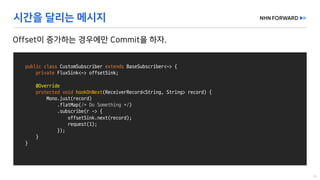

This document provides a code overview of a reactive Kafka consumer and producer using Reactor Kafka and Spring Kafka dependencies. It includes methods for producing and consuming messages, processing records into events, and handling offsets in a reactive manner. The code snippets demonstrate subscribing to topics, processing messages with backpressure, and using custom subscribers for specific processing requirements.

![[2019] 바르게, 빠르게! Reactive를 품은 Spring Kafka](https://image.slidesharecdn.com/nhnforward20198-200121085520/85/2019-Reactive-Spring-Kafka-72-320.jpg)

![[2019] 바르게, 빠르게! Reactive를 품은 Spring Kafka](https://image.slidesharecdn.com/nhnforward20198-200121085520/85/2019-Reactive-Spring-Kafka-73-320.jpg)