Документ представляет собой лекцию о машинном переводе, охватывающую его историю, современные подходы и методы оценки систем. Рассматриваются как статистические, так и традиционные методы машинного перевода, включая ключевые исследования и разработки. В заключение упоминаются различные инструменты и пакеты для реализации статистического машинного перевода.

![Для чего нужен машинный

перевод #1

Перевод: объявлений при поиске квартиры;

рецептов блюд; сайтов

Изучение языков

Поиск в Интернете на разных языках

(внутри поисковых алгоритмов и

дополнительная функция для пользователя

[9])

Перевод научных публикаций

Публикация статей (!) [5]

СПбГУ, ПМ-ПУ, ТП, 2009](https://image.slidesharecdn.com/introductiontomachinetranslation-100114034059-phpapp01/75/Introduction-To-Machine-Translation-4-2048.jpg)

![История МП #1

Одновременное независимое

патентование МП (1933): Пётр

Смирнов-Троянский (более серьёзное

исследование) [3] и Джордж Артсруни

(Georges Artsrouni) (отец МП) [4]

СПбГУ, ПМ-ПУ, ТП, 2009](https://image.slidesharecdn.com/introductiontomachinetranslation-100114034059-phpapp01/75/Introduction-To-Machine-Translation-6-2048.jpg)

![История МП: диаграмма

Figure 1: Informal graph showing the history of MT; also shown

are the five ‘Eras of MT History’ identified by Hutchins

(1993:27ff.) [1]

СПбГУ, ПМ-ПУ, ТП, 2009](https://image.slidesharecdn.com/introductiontomachinetranslation-100114034059-phpapp01/75/Introduction-To-Machine-Translation-9-2048.jpg)

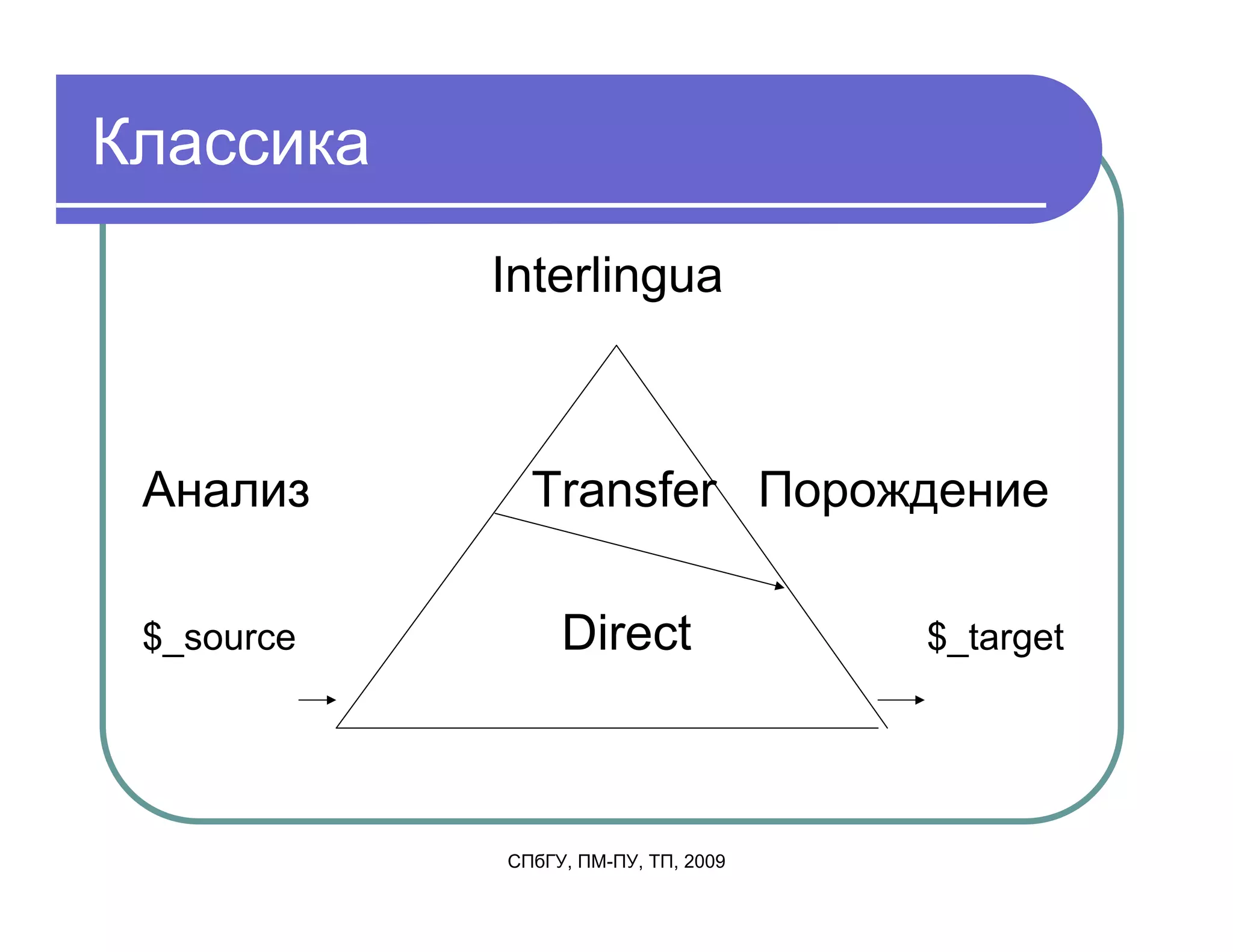

![История МП #4: indirect МП

Концепция interlingua (transfer

architecture=анализ,трансфер,синтез)

‘real-world knowledge’ (Bar-Hillel 1960) ->

высококачественный МП

1966-1976: системы МП второго поколения,

вовлекающие лингвистику и численные методы

(в основном U.S.)

Появились: MÉTÉOTM (1976, Montreal [11]),

SYSTRAN (конец 1950х, California), EUROTRA

(1982-1993, замена SYSTRAN)

СПбГУ, ПМ-ПУ, ТП, 2009](https://image.slidesharecdn.com/introductiontomachinetranslation-100114034059-phpapp01/75/Introduction-To-Machine-Translation-10-2048.jpg)

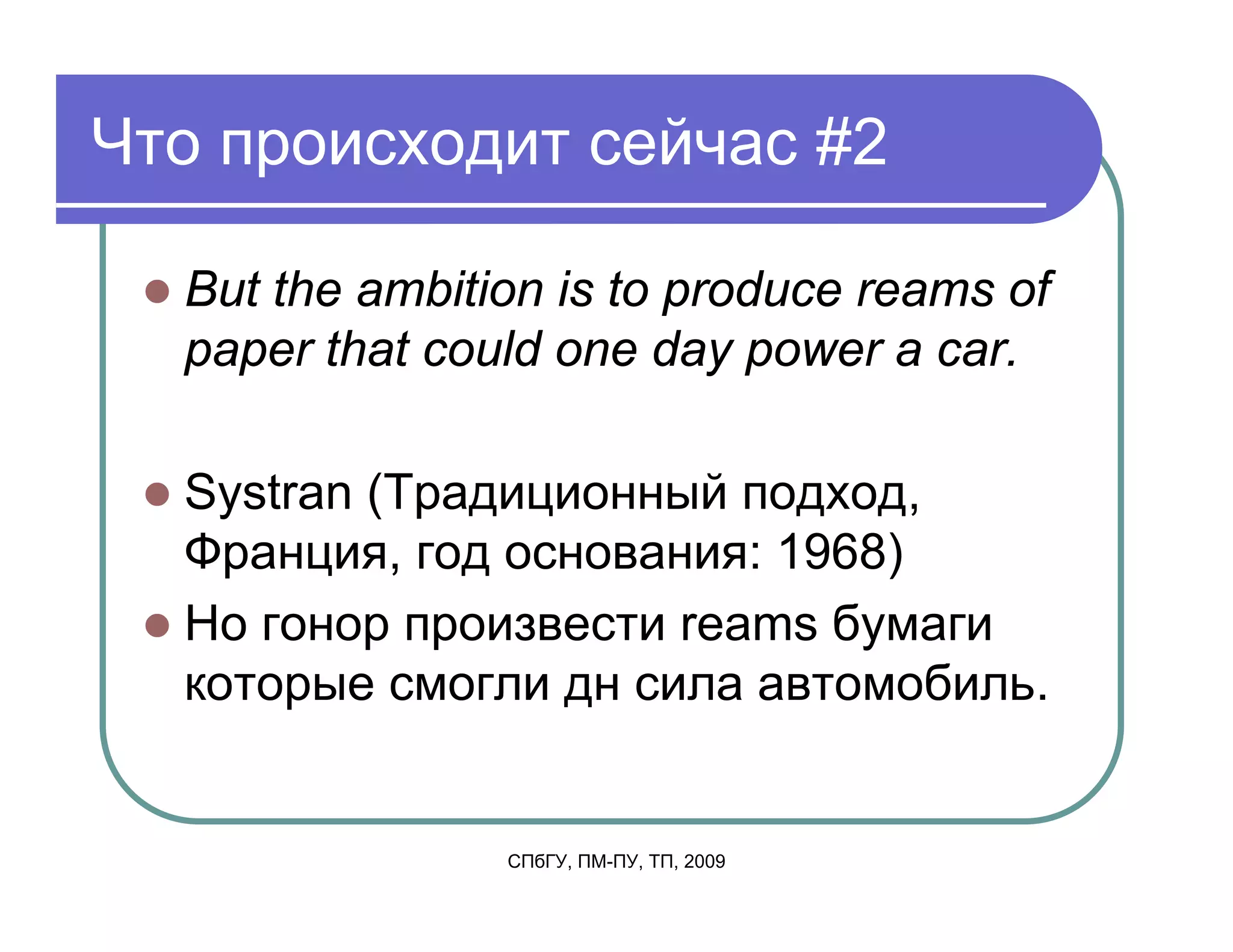

![Что происходит сейчас #1

But the ambition is to produce reams of paper

that could one day power a car.

Google Translate Beta (Статистический

подход, США, 1е место на NIST [10], 2005):

Но амбиция заключается в том, чтобы

производить пачек бумаги

, которые могли бы один день мощность

автомобиля.

СПбГУ, ПМ-ПУ, ТП, 2009](https://image.slidesharecdn.com/introductiontomachinetranslation-100114034059-phpapp01/75/Introduction-To-Machine-Translation-12-2048.jpg)

![MP и NLP пакеты

Moses: статистический МП, C++, Open

source

SRILM [12]: моделирование

естественного языка, C++, Open

source

СПбГУ, ПМ-ПУ, ТП, 2009](https://image.slidesharecdn.com/introductiontomachinetranslation-100114034059-phpapp01/75/Introduction-To-Machine-Translation-15-2048.jpg)

![Библиография

[1] Mona Baker, Routlege Encyclopedia of Translation Studies, 2001, ISBN 0-203-

35979-8

[2] Р. Г. Пиотровский: Автоматизация обработки текста, ВИНИТИ, ИНФОРМ.

ПРОЦЕССЫ И СИСТЕМЫ, 1998, №5

[3] http://www.hutchinsweb.me.uk/MTJ-2000.pdf

[4] http://www.hutchinsweb.me.uk/IJT-2004.pdf

[5] http://www.scientific.ru/trv/2008/013/ostap_bender.html

[6] Natural Language Processing, Instructor: Manning, Christopher D., Stanford

School of Engineering

[7] http://translate.google.com

[8] http://www.translate.ru/text_Translation.aspx

[9] http://www.google.ru/language_tools

[10] http://www.nist.gov/speech/tests/mt/(cont’d)

2005/doc/mt05eval_official_results_release_(cont’d)

20050801_v3.html

[11] http://www.hutchinsweb.me.uk/IntroMT-12.pdf

[12] http://www.speech.sri.com/

СПбГУ, ПМ-ПУ, ТП, 2009](https://image.slidesharecdn.com/introductiontomachinetranslation-100114034059-phpapp01/75/Introduction-To-Machine-Translation-59-2048.jpg)

![Библиография

[13] ALPAC report http://www.nap.edu/openbook.php?record_id=9547&page=R1

[14] Andy Way: Web-based Machine Translation, School of Computing

[15] http://en.wikipedia.org/wiki/

[16] Chris Callison-Burch, Philipp Koehn: Introduction to Statistical Machine

Translation, ESSLLI 2005

[17] Heshaam Faili: Chapter 21: Machine Translation, University of Tehran

[18] http://www.chrisharrison.net/projects/trigramviz/index.html

СПбГУ, ПМ-ПУ, ТП, 2009](https://image.slidesharecdn.com/introductiontomachinetranslation-100114034059-phpapp01/75/Introduction-To-Machine-Translation-60-2048.jpg)