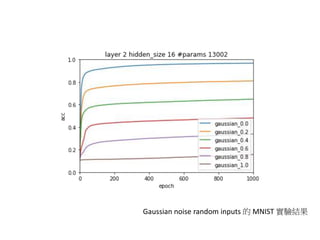

Gaussian noise random inputs 的 MNIST 實驗結果

•Download as PPTX, PDF•

0 likes•1,060 views

在 random labels 實驗中 (https://www.slideshare.net/BrianHuang34/random-labels-mnist),透過實驗結果我們發現 DNNs 可能是學習 patterns 再將 noise 以增加 capacity 的方式暴力記憶。 我們配置了九種神經網路,並對 training data 加上不同程度的 Gaussian noise,來觀察神經網路對 noise 的擬合程度,來進一步驗證我們的假設。 讓我們仔細觀察實驗結果,當神經網路參數很少時,對噪聲是幾乎沒有抵抗力的,而參數量越多的神經網路,面對 noise 的表現越好。 我們也可以清楚看到,同樣的神經網路在面對越高的 noise 程度時收斂越慢。 到此,我們幾乎可以很篤定的說,DNNs 會先去學習資料中的 pattern,再用額外的 capacity 去記憶 noise。這樣才能解釋為何收斂時間隨著 noise 升高成正比,因為需要靠暴力去記的東西變多了嘛! 此外,比較圖三、五的神經網路,可以再次應證高瘦的網路比矮胖的網路要好。

Report

Share

Report

Share

Recommended

More than Just Lines on a Map: Best Practices for U.S Bike Routes

More than Just Lines on a Map: Best Practices for U.S Bike RoutesProject for Public Spaces & National Center for Biking and Walking

More Related Content

Featured

More than Just Lines on a Map: Best Practices for U.S Bike Routes

More than Just Lines on a Map: Best Practices for U.S Bike RoutesProject for Public Spaces & National Center for Biking and Walking

Featured (20)

AI Trends in Creative Operations 2024 by Artwork Flow.pdf

AI Trends in Creative Operations 2024 by Artwork Flow.pdf

Content Methodology: A Best Practices Report (Webinar)

Content Methodology: A Best Practices Report (Webinar)

How to Prepare For a Successful Job Search for 2024

How to Prepare For a Successful Job Search for 2024

Social Media Marketing Trends 2024 // The Global Indie Insights

Social Media Marketing Trends 2024 // The Global Indie Insights

Trends In Paid Search: Navigating The Digital Landscape In 2024

Trends In Paid Search: Navigating The Digital Landscape In 2024

5 Public speaking tips from TED - Visualized summary

5 Public speaking tips from TED - Visualized summary

Google's Just Not That Into You: Understanding Core Updates & Search Intent

Google's Just Not That Into You: Understanding Core Updates & Search Intent

The six step guide to practical project management

The six step guide to practical project management

Beginners Guide to TikTok for Search - Rachel Pearson - We are Tilt __ Bright...

Beginners Guide to TikTok for Search - Rachel Pearson - We are Tilt __ Bright...

Unlocking the Power of ChatGPT and AI in Testing - A Real-World Look, present...

Unlocking the Power of ChatGPT and AI in Testing - A Real-World Look, present...

More than Just Lines on a Map: Best Practices for U.S Bike Routes

More than Just Lines on a Map: Best Practices for U.S Bike Routes

Gaussian noise random inputs 的 MNIST 實驗結果

- 1. Gaussian noise random inputs 的 MNIST 實驗結果

- 2. Gaussian noise random inputs 的 MNIST 實驗結果

- 3. Gaussian noise random inputs 的 MNIST 實驗結果

- 4. Gaussian noise random inputs 的 MNIST 實驗結果

- 5. Gaussian noise random inputs 的 MNIST 實驗結果

- 6. Gaussian noise random inputs 的 MNIST 實驗結果

- 7. Gaussian noise random inputs 的 MNIST 實驗結果

- 8. Gaussian noise random inputs 的 MNIST 實驗結果

- 9. Gaussian noise random inputs 的 MNIST 實驗結果

- 10. Gaussian noise random inputs 的 MNIST 實驗結果

- 11. Gaussian noise random inputs 的 MNIST 實驗結果

- 12. Gaussian noise random inputs 的 MNIST 實驗結果

- 13. Gaussian noise random inputs 的 MNIST 實驗結果

- 14. Gaussian noise random inputs 的 MNIST 實驗結果

- 15. Gaussian noise random inputs 的 MNIST 實驗結果

- 16. Gaussian noise random inputs 的 MNIST 實驗結果

- 17. Gaussian noise random inputs 的 MNIST 實驗結果

- 18. Gaussian noise random inputs 的 MNIST 實驗結果