2. 号 158 对应的网络和管理接口构成。在集装箱的左侧,打开主入口门 164,门口左边是标号为 107

的综合配线架,右边是标号为 131 的电力配电柜,从上图可以看到弱电网线走在服务器机柜底下,

强电配电线缆走在服务器机柜顶部,两侧有两路空调冷冻水管路布置在集装箱的最底部,通过空

调盘管 116 和离心风机 119 来散热。考虑运输和吊装等需求,在集装性的底部 143 位置或者顶部

146 等位置还预留了叉车和吊装的接口。

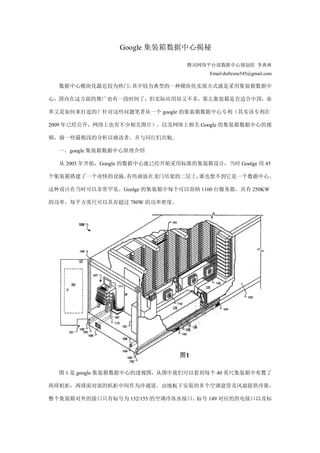

图 1 图示了集装箱数据中心 100,其可以被用来向诸如数据中心的整体并行计算系统添加计

算能力。在一些实施方式中,不同的集装箱数据中心可以提供替代量的处理能力或存储能力(例

如,2000 个微处理器和 50 兆兆字节的存储),即不同的模块可以是基本上可互换的。在一些实

施方式中,不同的模块可以提供处理能力对存储能力的不同的比率,并且目标应用可以确定适当

的比率。例如存储密集型的应用可以要求具有大量的存储设备的模块,而该应用可能不需要大量

的处理器;被设计为离线模拟大型网络的“实验室网络” 应用可以要求具有大量处理器的模块,

而该应用可能不需要大量的存储设备。

从图 1,我们还可以看到一个集装箱内有多个空调盘管单元,每个单元大概覆盖三个 IT 机

柜左右,当然实际每个空调覆盖的机柜数量会随着 IT 设备的类型灵活调整,比如存储类的设备

功耗较低,则可以少建设几个盘管或者多摆几个机柜等,这些可以在工厂阶段根据需要灵活配置。

二、数据中心制冷篇

下图是整个集装箱的截面图,这个图更有助于大家看到其气流组织,由机柜底部送出的冷

3. 量在中间的 312 冷池内被两侧的服务器吸入,经由服务器的风扇 315 吹到服务器尾侧的 309

热通道内,再经地板下的空调盘管 116 制冷后由离心风机 119 吹回冷通道内,形成如下

ABCD 的整个气流循环,气流组织非常短,风机能耗及冷量传递损失都很少,效率很高。

标准集装箱的宽度只有 2.35 米,考虑两排机柜并列,还需要冷通道维护空间及两侧热通道

回风需要,这里可以推断出 google 的服务器深度实际是很短的,初步估计含机柜不超过 700mm。

这种短宽深度的设计也非常适合于服务器散热,较为容易实现高温服务器的目标,据 google 的

介绍其冷通道送风温度高达 27 度甚至更高,因此提升冷通道送风温度的节能效果非常明显。

下图的空调特写部分更为清晰展示了其原理,其中 116 为 A 字型空调盘管,122 供水管和

125 回水管通过快接软管连到该空调盘管上,降温后的冷空气由导风槽 202 及离心风机 119 甩到

架空地板上的冷通道内,集装箱内的热量由空调冷冻水带到集装箱外。每个空调盘管对应三个风

扇,冷却风扇速度可变,并可以精确管理,保证风扇在能够冷却机架的前提下运行在最低速度。

4. Google 集装箱数据中心的设计着重于“电源在上,水在下”,机架从集装箱的天花板悬挂

下来,冷却设备在机架下面,让冷空气通过机架。左下图是服务器尾部的电源线连接,右下图是

服务器前部的网络连接,但实际根据 google 公布的集装箱数据中心视频,服务器的供电和网络

接口都建设在冷通道一侧实现完全的前维护或者冷通道维护,因为服务器后面热通道的宽度实在

有限,难以进人维护,以及热通道的温度高达 40 多度,也不适合运维人员高温操作。

据 google 自己公布,其 IDC 的 PUE 值从 2008 年第三季度的 1.21 下降到 2008 年第四季度

的 1.16。PUE 为 1 表示数据中心没有能源损耗,而根据 2006 年的统计,一般公司数据中心的

能效比为 2.0 或更高。Google 的 1.16 已经低于美国能源部 2011 年的 1.2 的目标。Google 集

装箱数据中心实现低 PUE 的几个最佳实践方法大家可以从参考资料的视频地址中找到。

三、数据中心供配电篇

相比大多数企业都从戴尔、惠普、IBM 或 Sun 购买服务器系统,而 google 的服务器系统却

是自己设计的。它在每台服务器都配有 12V 的备用电池(3.2Ah,备电时间很短只有几分钟),

而不采用大型的不间断电源(UPS)作为备用电源。通常市电直供比 UPS 更有效率,大型 UPS 的

有效率为 92%至 95%,而市电直供的效率为 99.9%。Google 服务器厚 3.5 英寸(2 个机架单位),

有两个处理器,两块硬盘,八个内存条,主板由技嘉制造,采用来自英特尔和 AMD 的 x86 处理

器。Googl e 甚至还在自己的网络设备中采用了这种电池设计。通过这些设计,可以避免采用传

统低效率的 UPS 方案,达到了 99.9%的供电效率的。下图是 google 服务器 UPS 的供电拓扑图,

5. 以及掉电保护控制逻辑。市电正常的时候由市电直接给服务器供电,实现 99.9%的供电效率,同

时让电池充满电;当市电闪断或者停电的时候,则由主板上的 12V 电池过渡放电一两分钟,保

持设备不掉电,直至柴油发电器启动继续提供市电输入。原理较为简单,但实现起来却难度较大。

下图是 google 整个数据中心层级的供电架构,可以包括在模块化数据中心中的示例设施层

级的配电系统 1100 的框图。如图所示,由供给 1101 以电压 VI 提供电力。在一些实施案例中,

该电力由公用设施公司以大约 13 千伏的电压 VI 供应。供给 1101 由电力转换设备 1104 转换为

电压 V2。在一些实施方式中,电力转换设备 1104 是变压器,并且电压 V2 是大约 480 VAC,并

提供有 3 相。在一些实施方式中,在电压 V2 的电力可以被配送给各种模块化计算环境 1106A 和

1106B。可以由电路保护设备 1109 (例如,电路断 路器、保险丝、电涌抑制器等)提供对在电压

V2 的电力的电流保护。在一些实施方式中,每一个集装箱数据中心 1106A 或 1106B 包括分相器

1112,其将三个相中的每一个分离为具有电压 V3 的单相引线。 在一些实施方式中,电压 V3 是

单相 208 VAC。在电压 V3 的三个单相 引线可以作为各种电路被配送到在集装箱数据中心 1106A

或 1106B 内 的负荷。例如,网络交换设备 1115 可以具有专用电路。一个风扇或多 个风扇 1118A

和 1118B 可以具有专用电路(在一些实施方式中,为可靠起见相邻的风扇可以由不同的电路供

给)。灯 1121 可以具有专用电 路。处理板 1124A-1124C 的组可以具有专用电路(例如,机架

中的一列处理器板,或者机架的另一部分 1125A、1125B 或 1125C 可以具有专用电路)。其它

设备 1127 也可以具有专用电路(例如,灯光、火焰 /烟雾检测设备和灭火系统)。如所示出,

在电压 V3 的每一个电路可 以具有过电流设备 1130 (例如,电路断路器、保险丝、电涌抑制器

等)。 在一些实施方式中,每一个处理器板 1124A-C 包括服务器板载电源 1133,其将具有电压

V3 的电力转换为适合在对应的处理器板上的组件的一个或多个电压。

8. 右上图是另外一种以多个集装箱数据中心 1001-1008 构建,并具有叠置配置的另一个示例模

块化数据中心 1000 的透视图。除了配置,模块化数据中心 1000 非常类似于模块化数据中心 900:

它包括设施层级的冷却设施 1025,设施层级的电源 1016;设施层级的通信设施 1028;以及模块

化计算环境 1001-1008。垂直泊位 1013 可以将公用设施导引至模块化计算环境 1001-1008,并且

设施层级的冷却设施1025可以被设置在泊位 1013上面。可以提供设施层级的电力转换设备1019

和配电设备(未示出)。

下图是 google 某个集装箱数据中心内集装箱模块的实际摆放示意,结合了前面提到的两种

建设模式,既有同层的多模块铺开摆放方式,又有上下两层的堆叠模式,通过龙门吊等方式吊装,

有效充分利用了建筑空间并保持了搬迁输运的便捷性。

作为一个额外的示例,数据中心可以被设置在船上;可以由船上的船用发电机提供电力,并

且冷却设施可以由舱外海水或者油轮上储存的热油来散热,后者就是 google 油轮数据中心的概

念,当然这个方案实际最终被证实那只是个愚人节的玩笑。

从前面的分析和实际 google 的建设布局来看,采用集装箱数据中心对建筑结构和运输通道

提出较高的要求,比如需要占地面积较大的大开间低层建筑结构,需要承重很高的龙门吊或者专

用吊车等设备来吊装或者输送,如考虑搬迁还需要预留较宽的进出通道和空间等,对于国内城市

主流的多层建筑显然不太合适。此外,就集装箱本身而言,如果采用 40 英尺的大集装箱,建设

和部署的颗粒度有些偏大不够灵活,如果采用 20 英尺的短箱,箱内物理空间又有一定受限,特

别是 2.35 米的宽度对于普通的标准服务器机柜而言空间利用率更是严重不足,只能摆放一排机

柜或者采用多个小室结构,只有类似 google 这种两排定制的短服务器可以实现较高的空间利用

9. 率,但也还存在维护空间不足等问题。 当然集装箱数据中心仍有非常多的优点,并且在一定的

行业或者特殊领域内有非常好的应用和案例,未来集装箱数据中心仍有较好的发展。

五、结语

前面只是对 google 集装箱数据中心的一些简要介绍,而且集装箱技术大约是 google 在 2005

年左右的技术,考虑到集装箱的一些限制和不足,后来 google 就不再采用此技术了,转而进化

到采用室内型微模块数据中心的阶段,这些可以从前些日子 google 发布的一些室内微模块图片,

以及下图 google 数据中新 7 年的发展历史中我们可以发现一些端倪。后续笔者会继续就 google

的这些室内型微模块技术做些粗浅分析,和同行们共同探讨研究,并希望通过对 google 这个业

界的标杆学习,促进国内数据中心行业的发展。

参考资料:

1、 视频: 探访 Google 的集装箱数据中心

http://v.youku.com/v_show/id_XMTAyMTk4NTE2.html

2、 Google 集装箱专利

http://211.157.104.87:8080/sipo/zljs/hyjs-yx-new.jsp?recid=200680055433.0