코어닷 기술 세미나 2018

Session #4 : 박언용 (유니스트 석사과정)

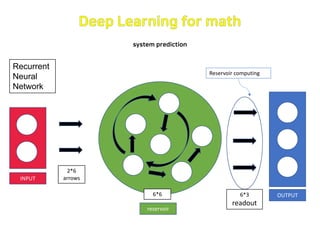

얕은(shallow) 지식으로 보는 Tensorflow를 이용한 깊은(deep) 학습 코딩

17:00 ~ 17:50

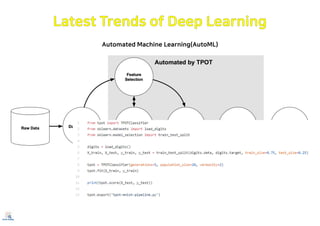

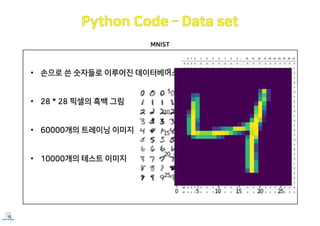

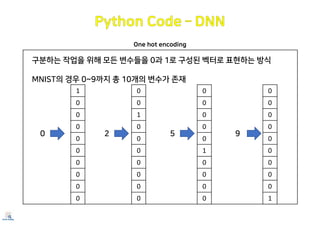

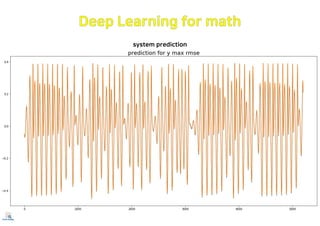

딥러닝의 기본배경 및 트렌드를 알아보고, 간단한 예시(MNIST)를 통해서 파이썬을 이용한 코딩을 어떻게 하는지 보여드립니다.

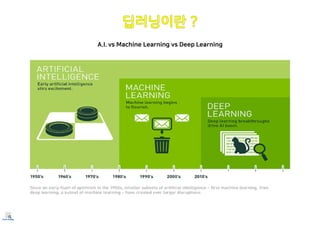

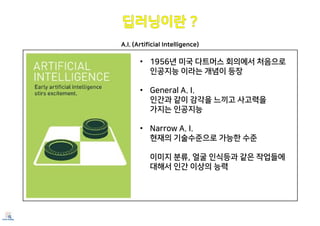

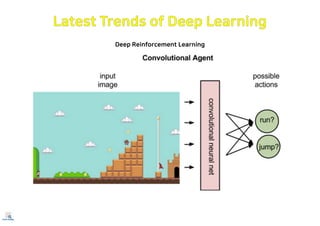

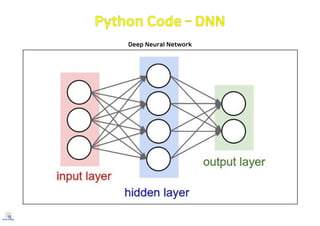

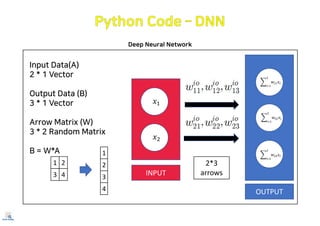

- 딥러닝이란?

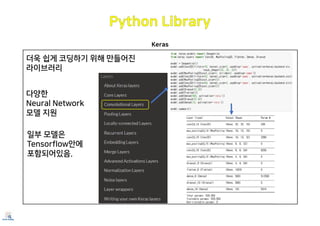

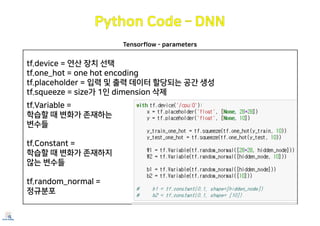

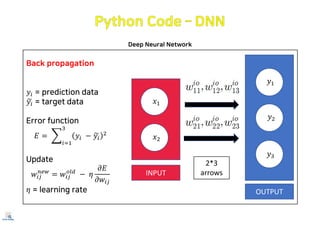

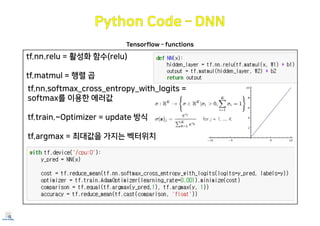

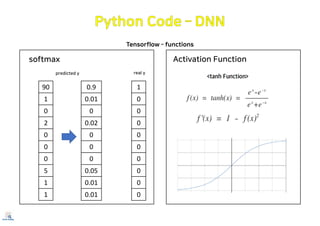

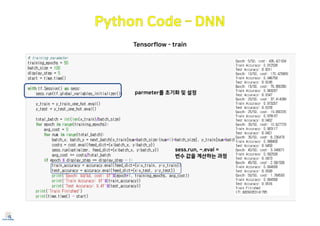

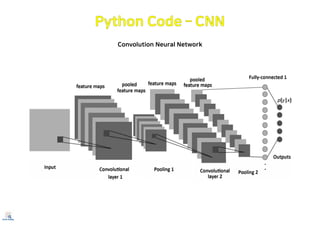

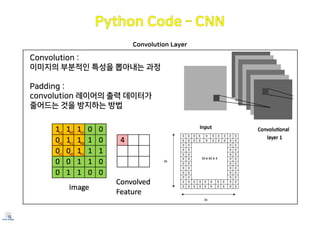

- Python (Tensorflow)

- 파이썬 예제 및 실제 애플리케이션 작성

https://coredottoday.github.io/2018/10/15/Coredot-기술-세미나/