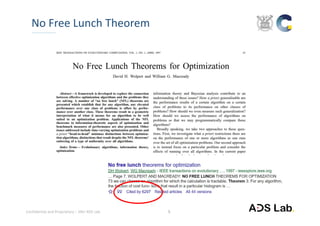

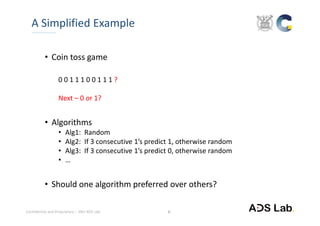

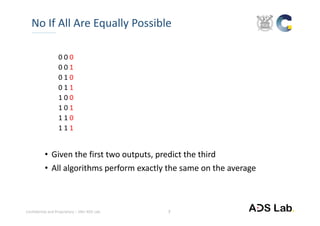

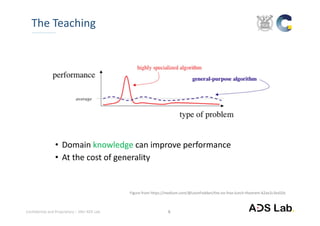

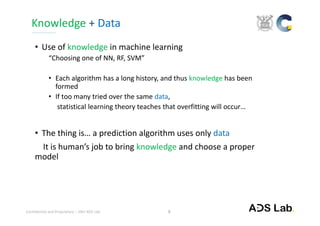

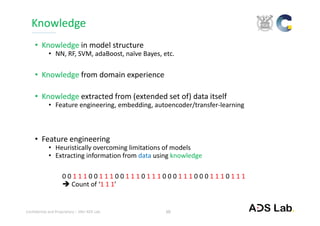

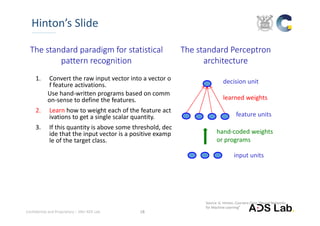

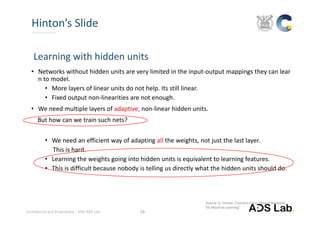

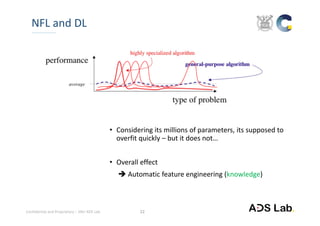

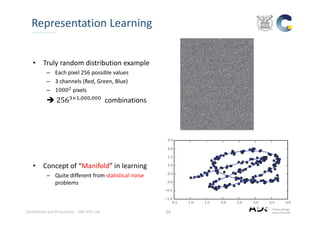

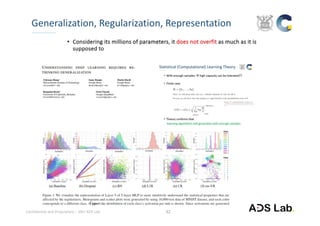

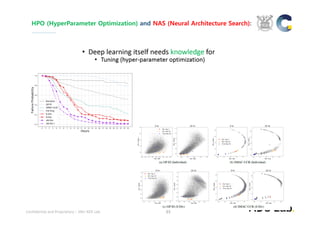

The document discusses the application of deep learning (DL) and the no free lunch (NFL) theorem in the financial sector, emphasizing the importance of feature engineering and domain knowledge to enhance algorithm performance. It highlights the potential of deep learning models in automating feature extraction while also addressing limitations in generality and the requirement for human expertise. The current state of research reflects a shift towards deep learning, although challenges in implementation and reliance on specific domain knowledge remain prevalent.