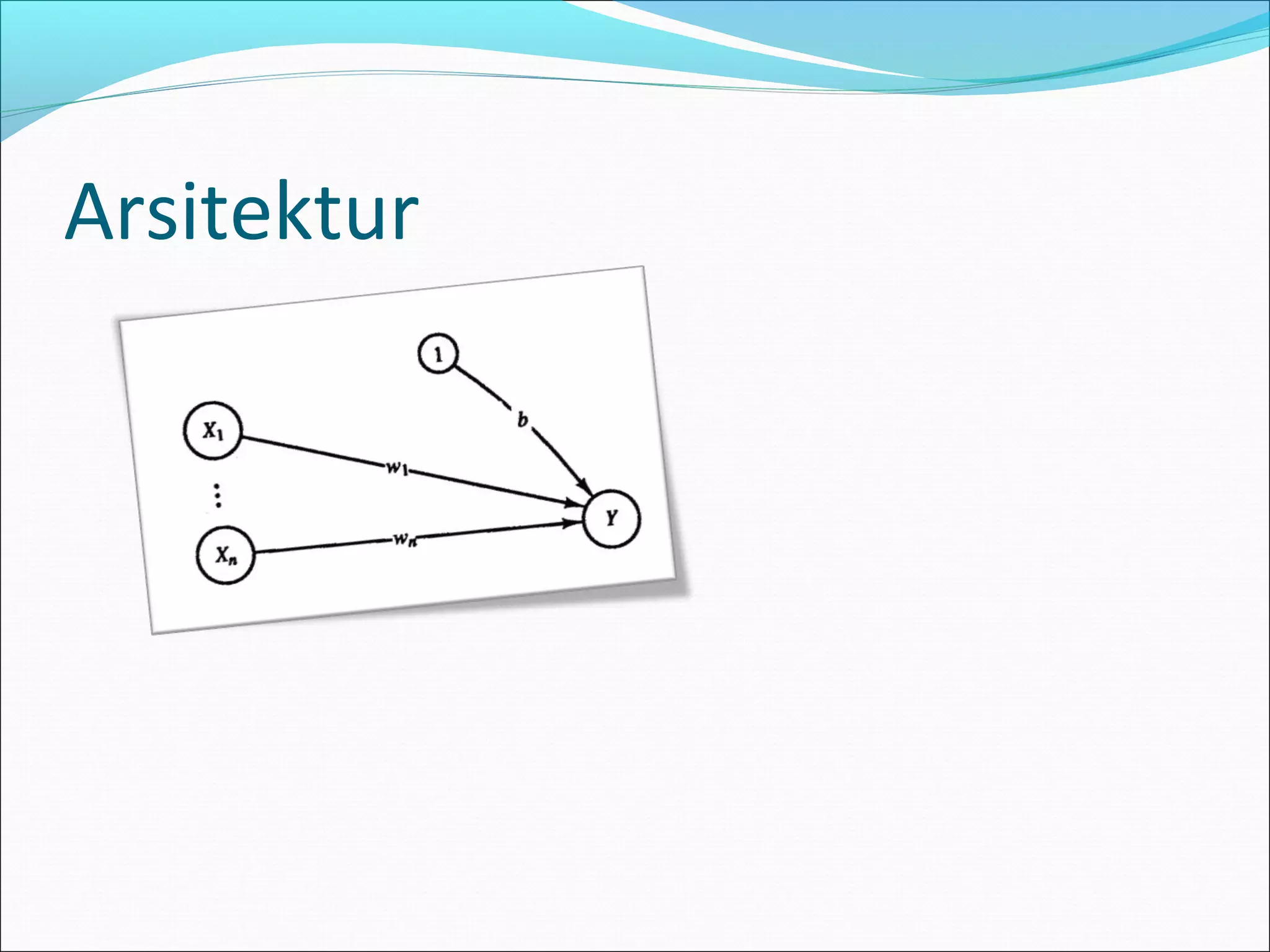

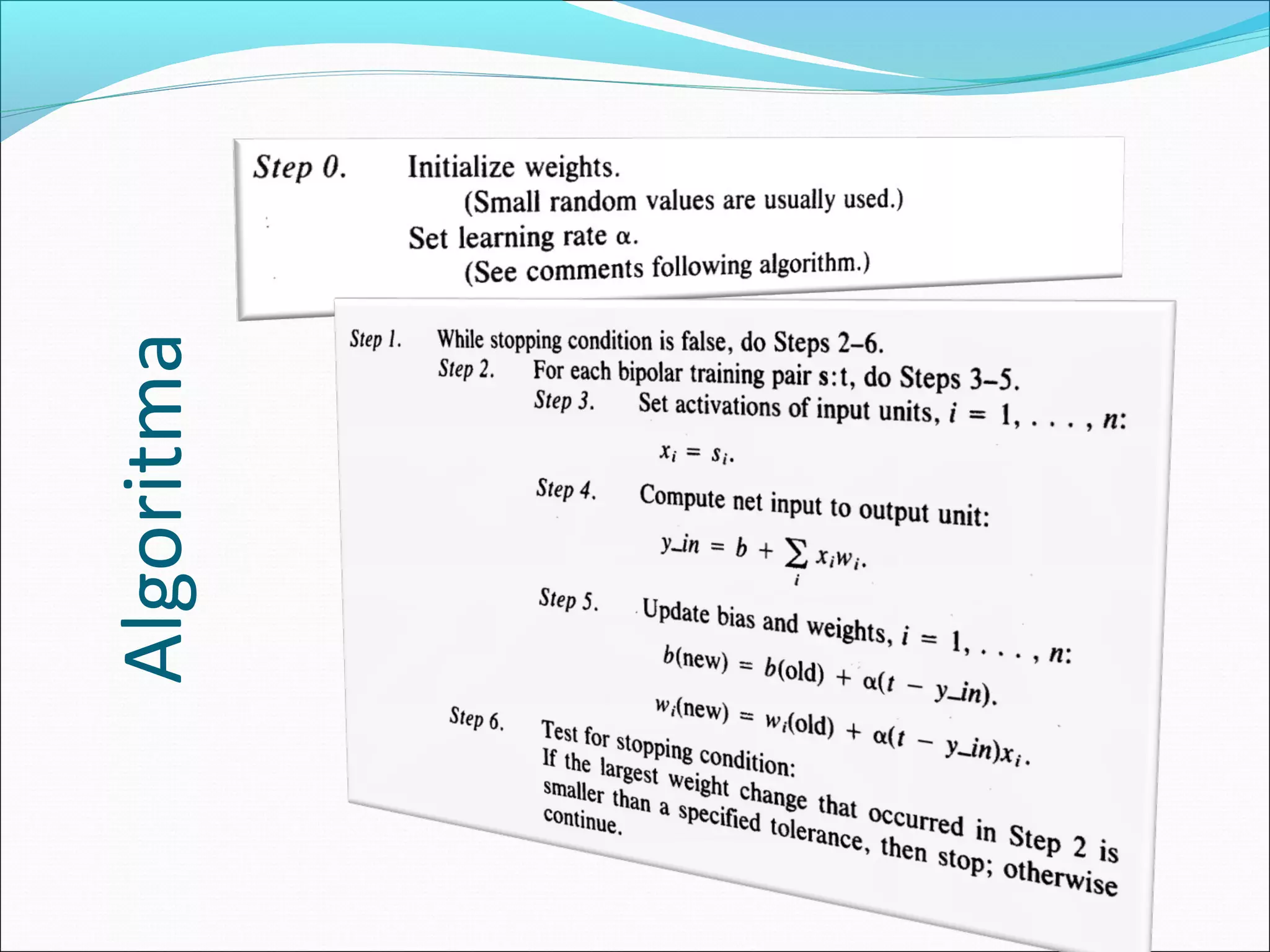

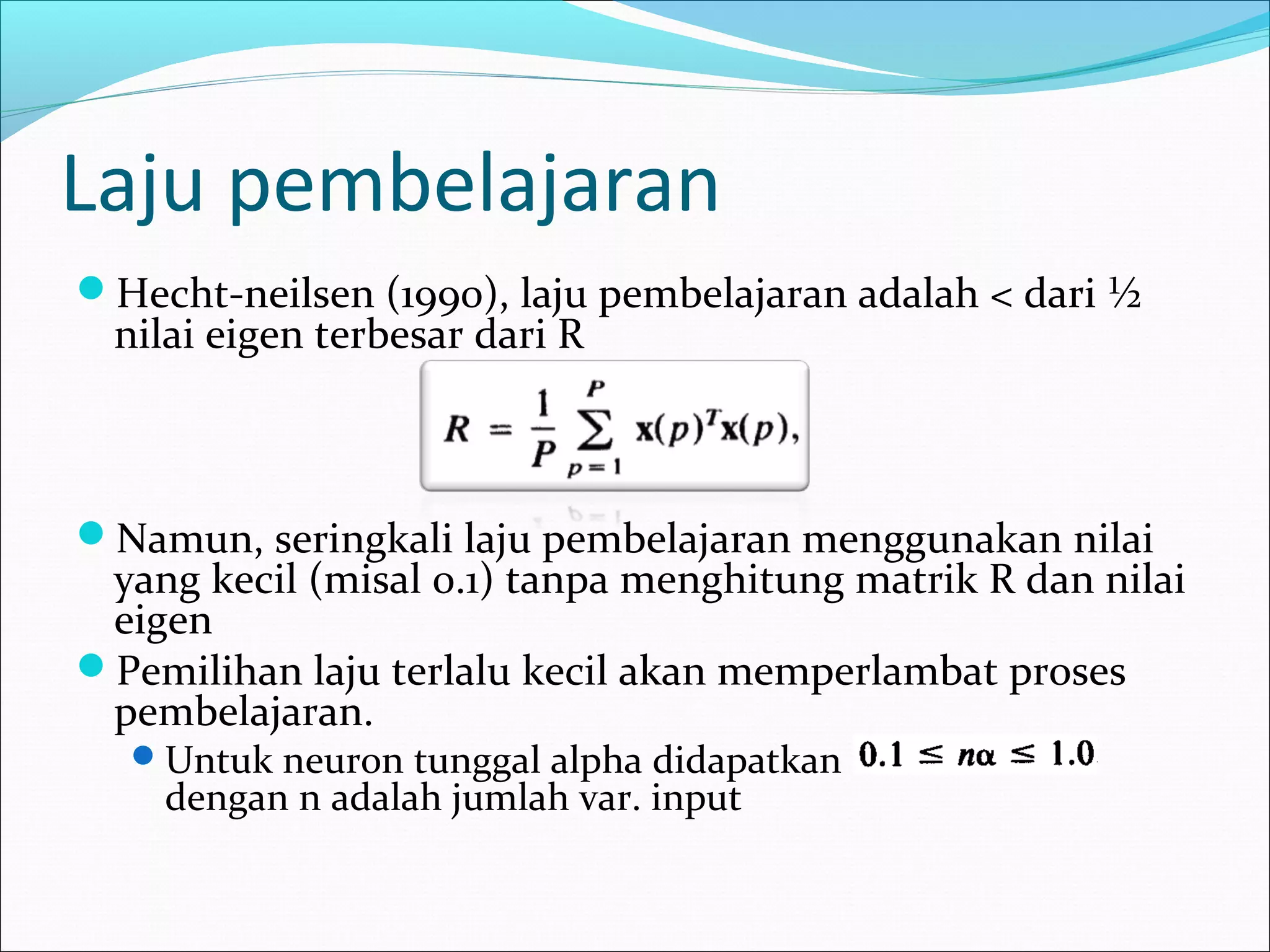

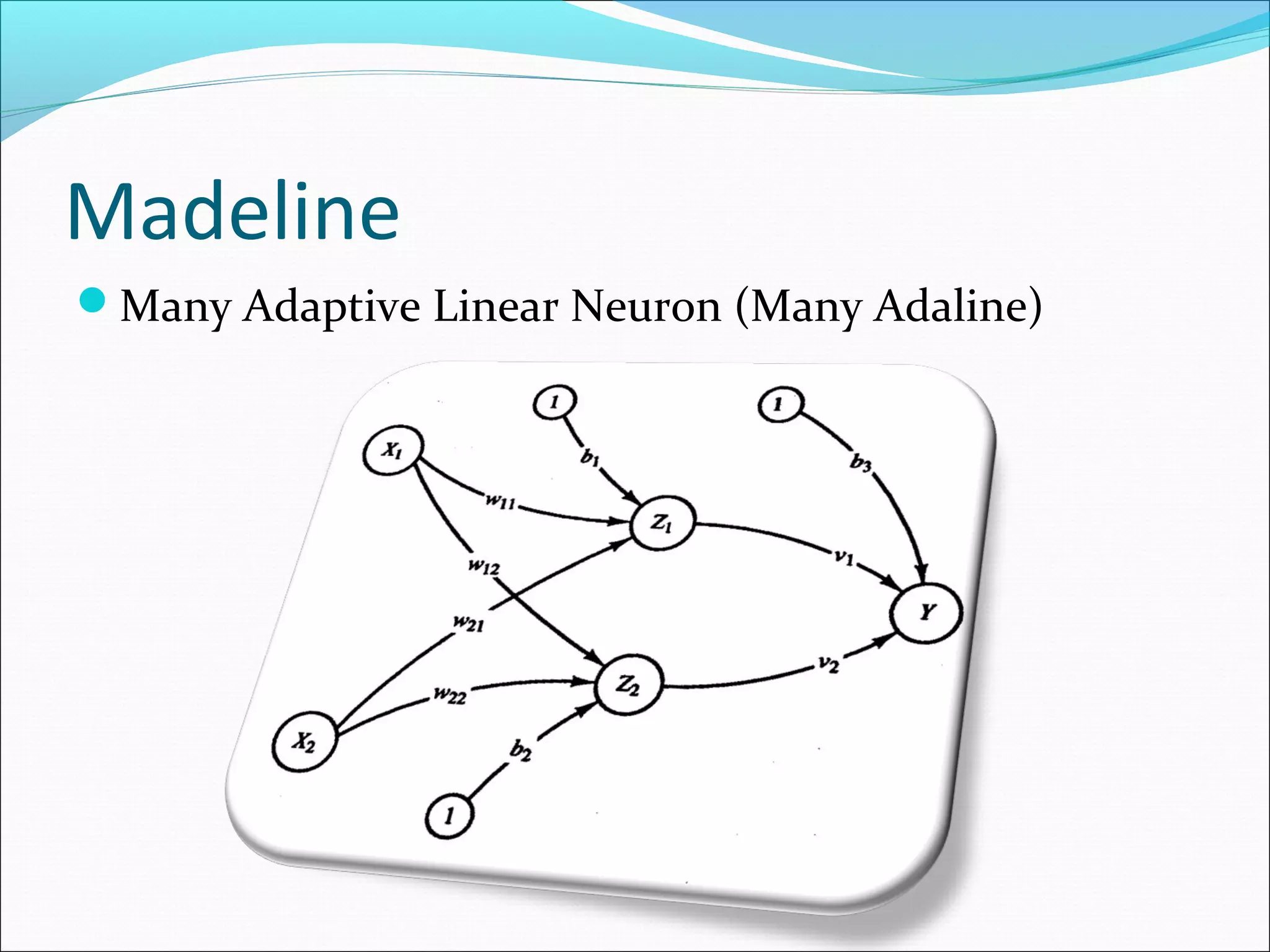

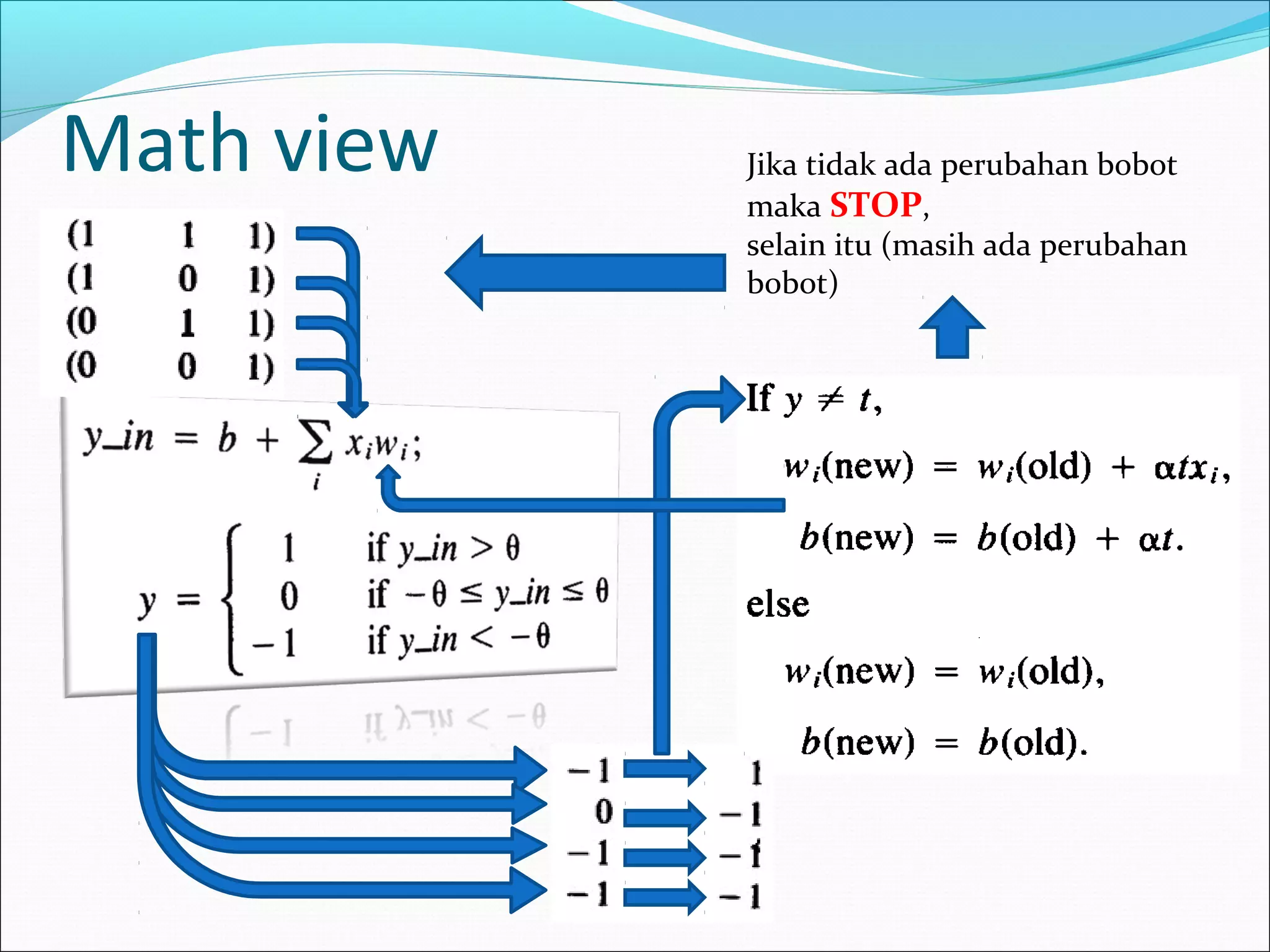

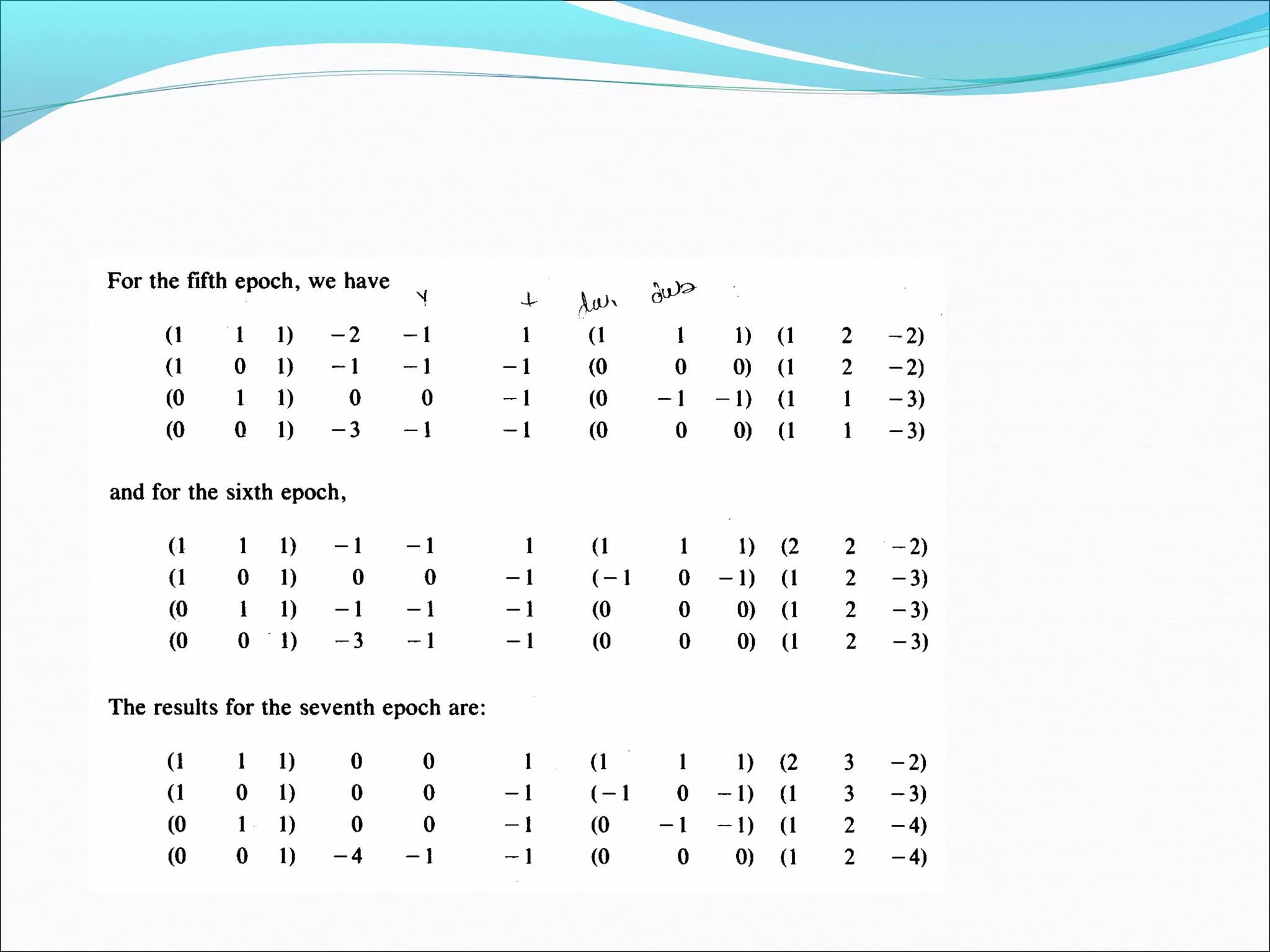

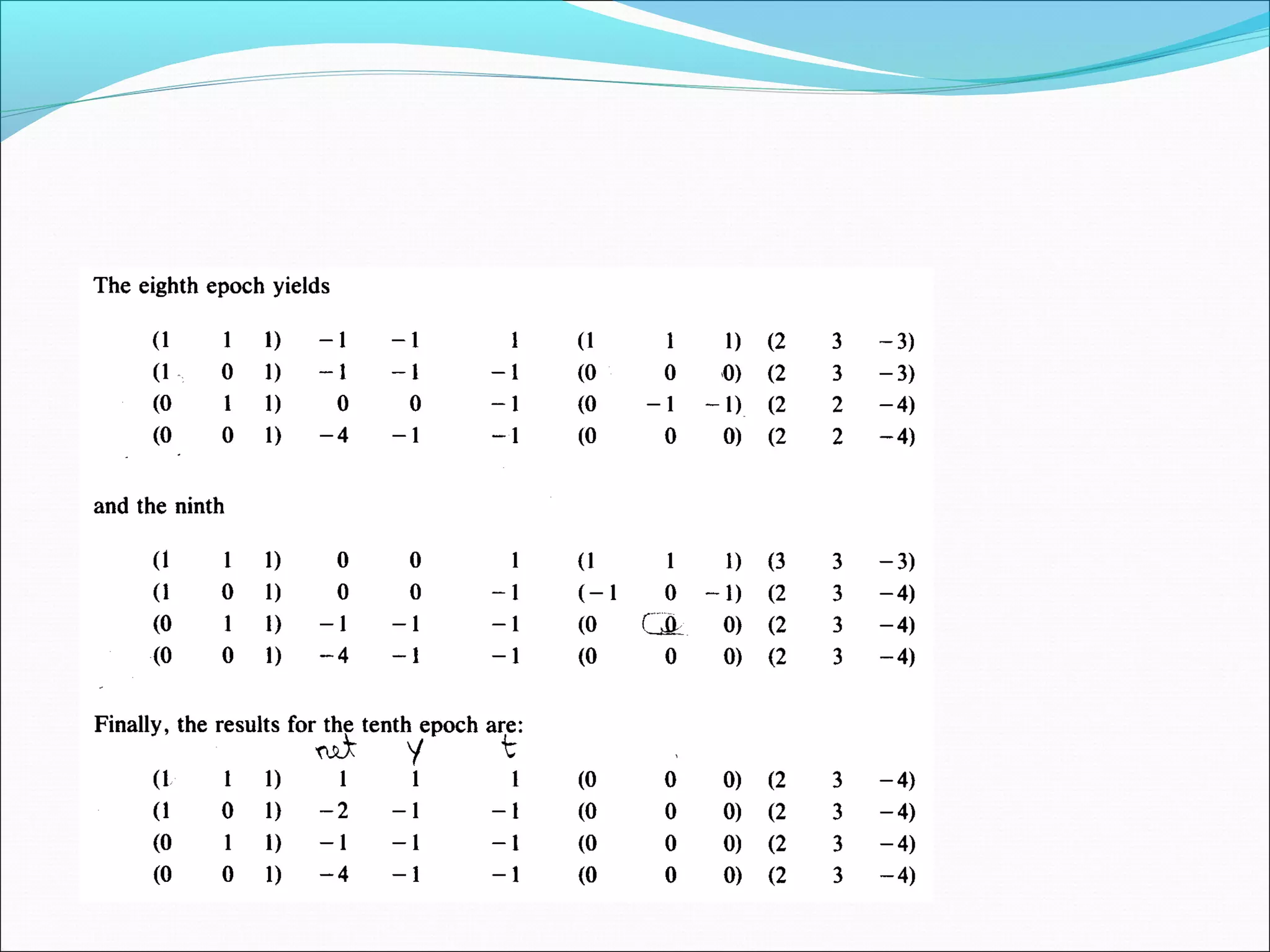

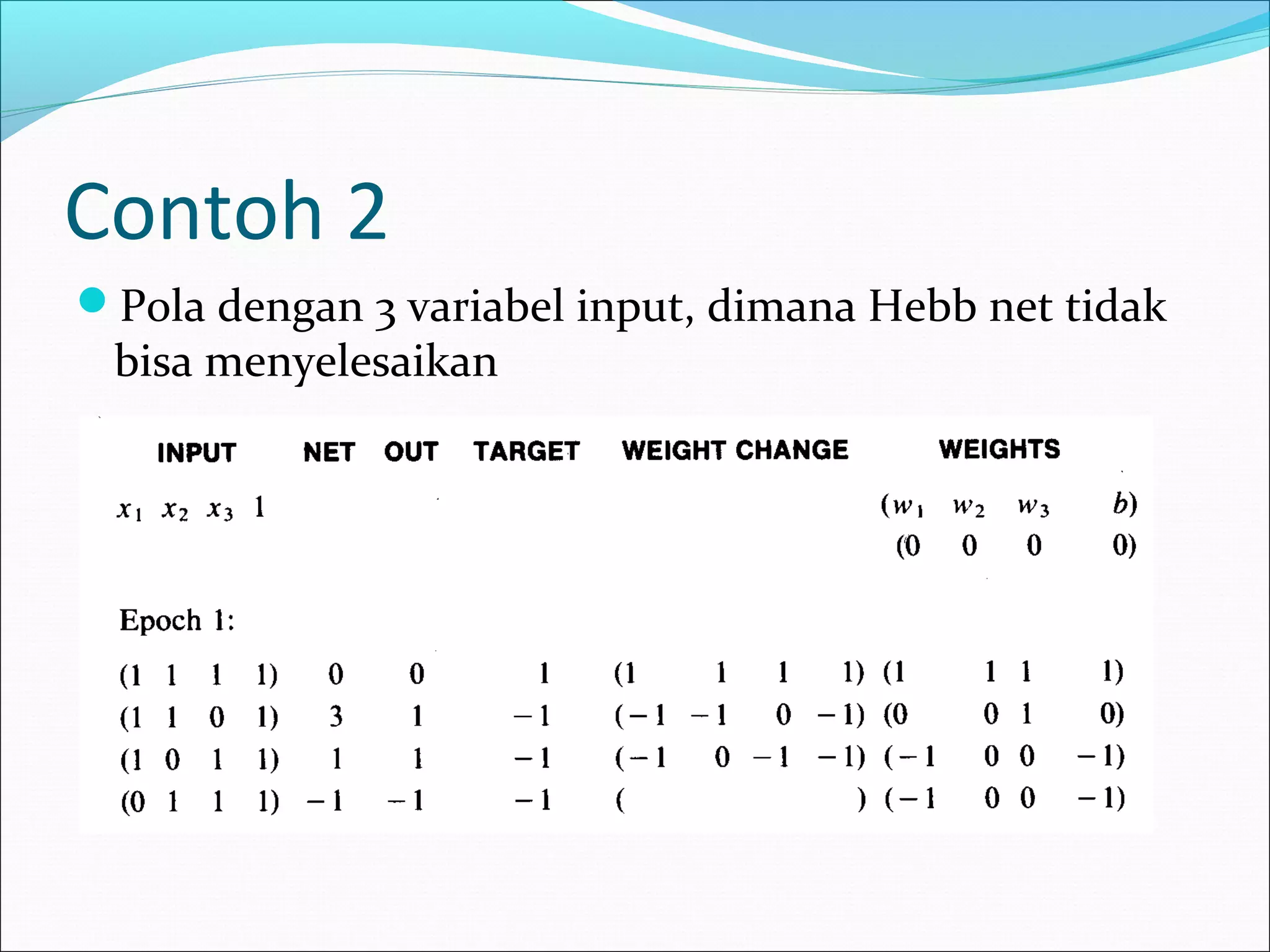

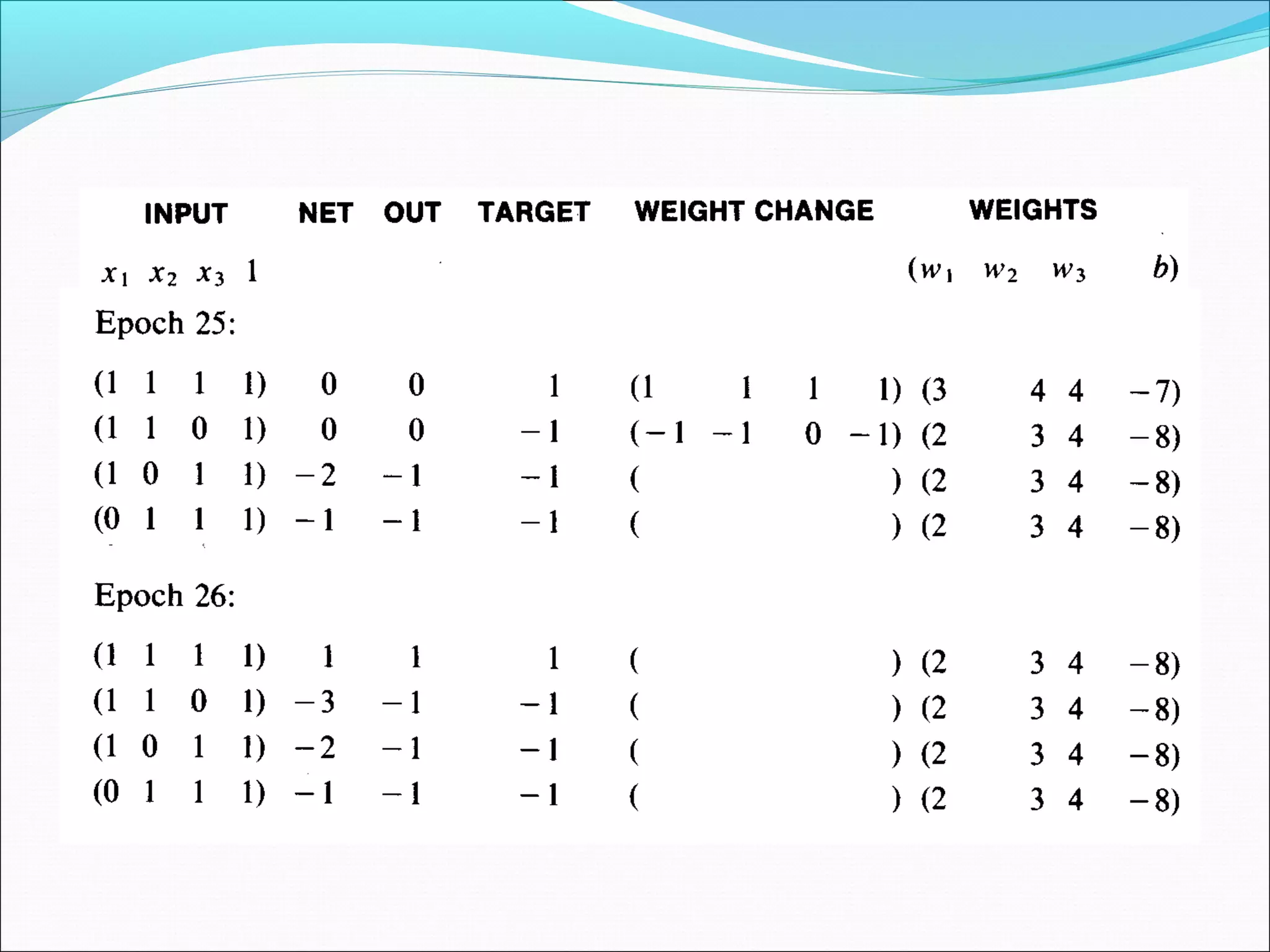

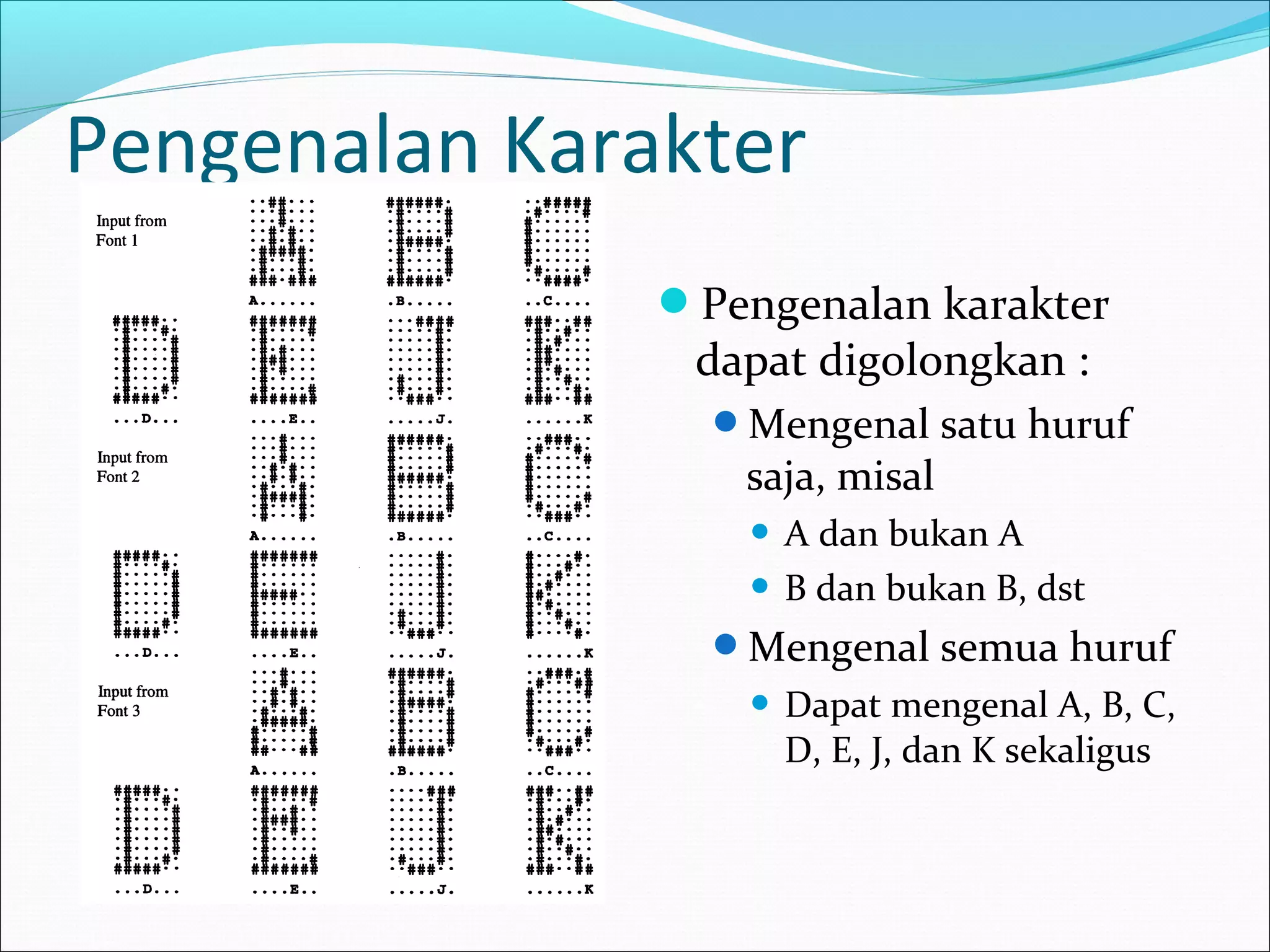

Dokumen tersebut membahas beberapa algoritma jaringan saraf tiruan seperti perceptron, Adaline, dan Madeline. Perceptron bekerja dengan mengubah bobot melalui iterasi sampai output sesuai target, sedangkan Adaline mengupdate bobot menggunakan aturan delta dan Madeline adalah versi multilayer dari Adaline.

![Pengantar[2]

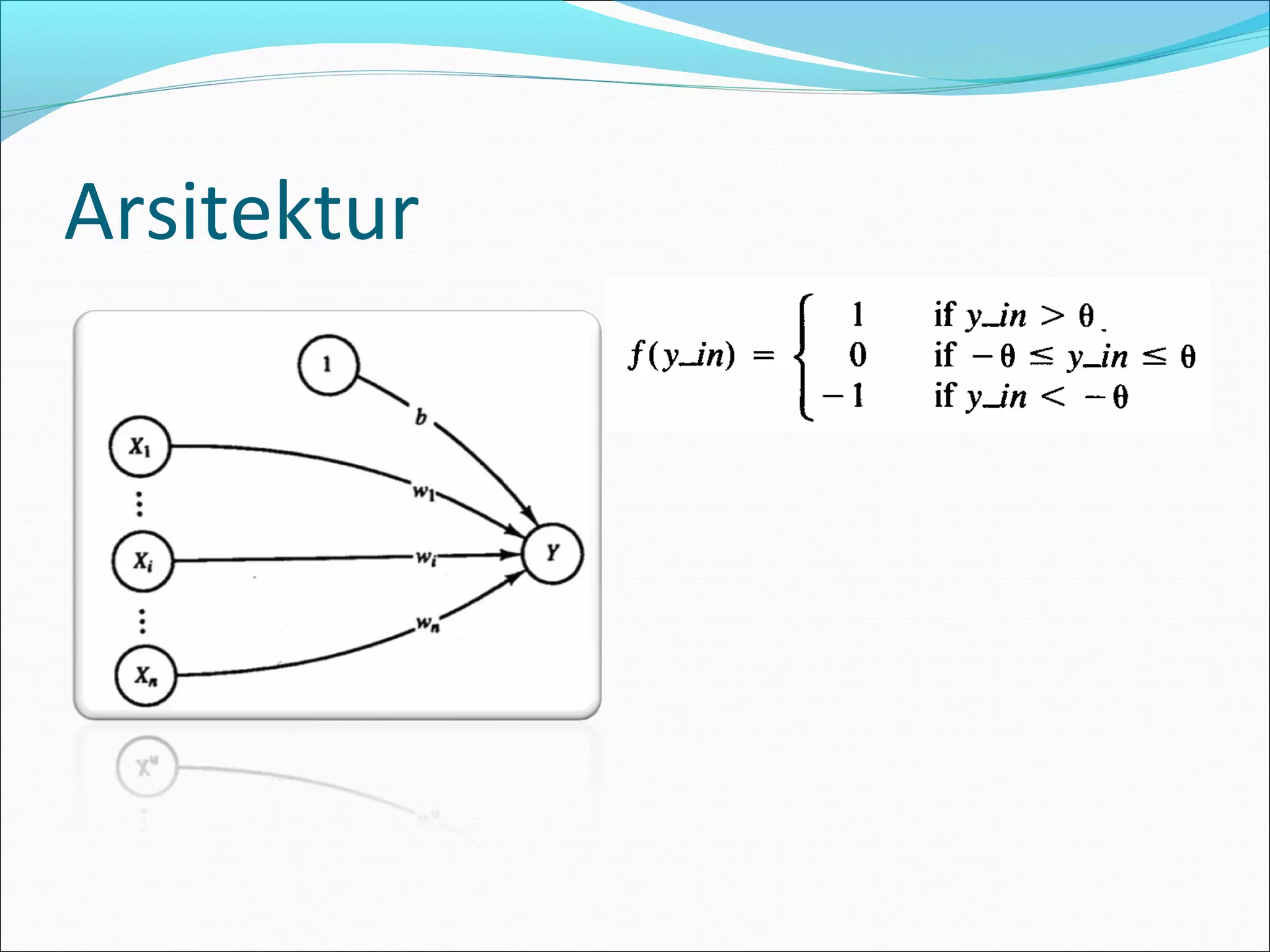

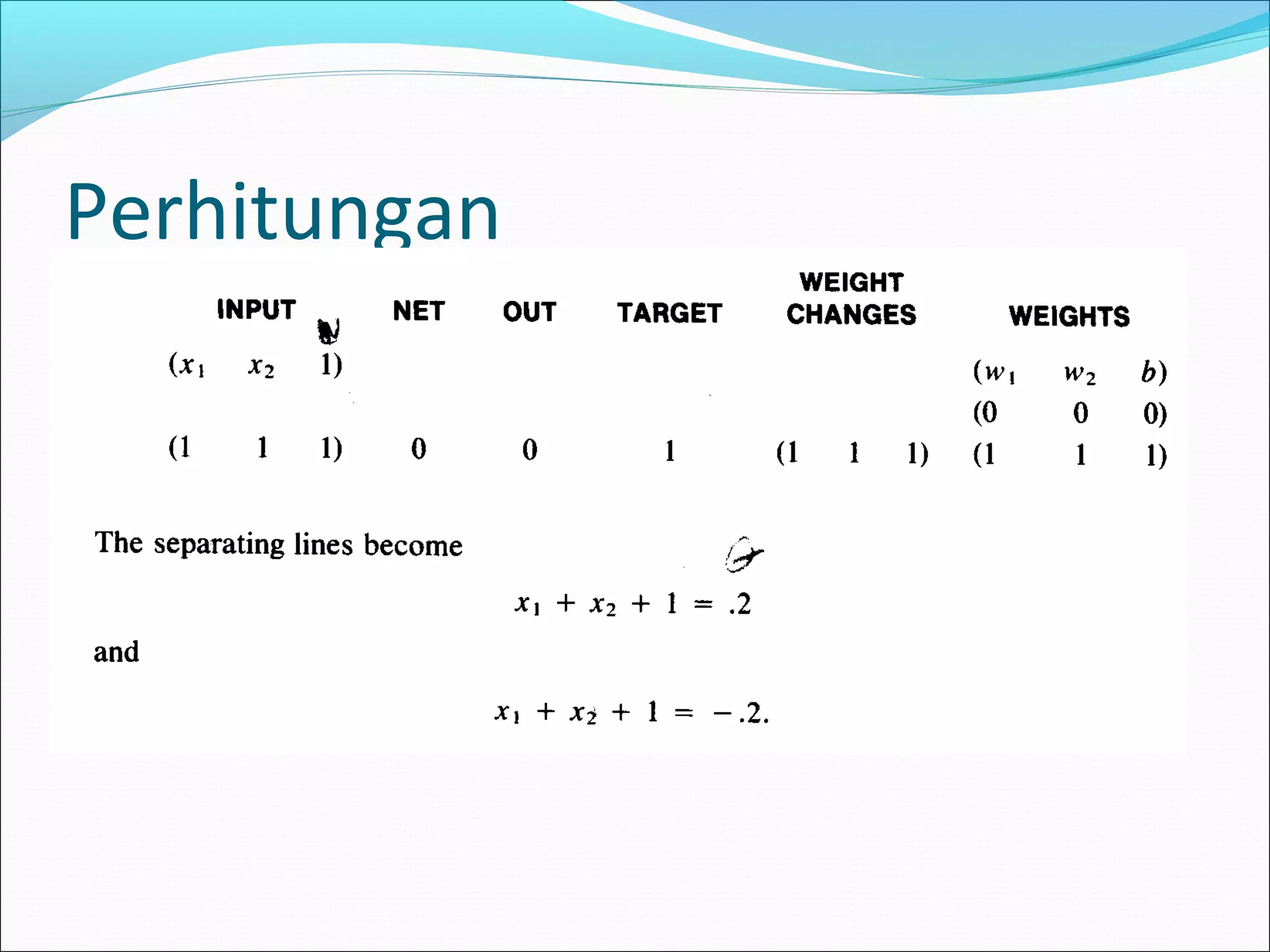

Perubahan bobot dilakukan pada tiap unit input dari

beberapa unit dalam satu set input.

Jika output yang dihasilkan tidak sesuai dengan

output yang seharusnya maka bobot diubah, dan

dilakukan pembelajaran lagi.](https://image.slidesharecdn.com/pengenalan-pola-sederhana-dg-perceptron-160214070542/75/Pengenalan-pola-sederhana-dg-perceptron-4-2048.jpg)

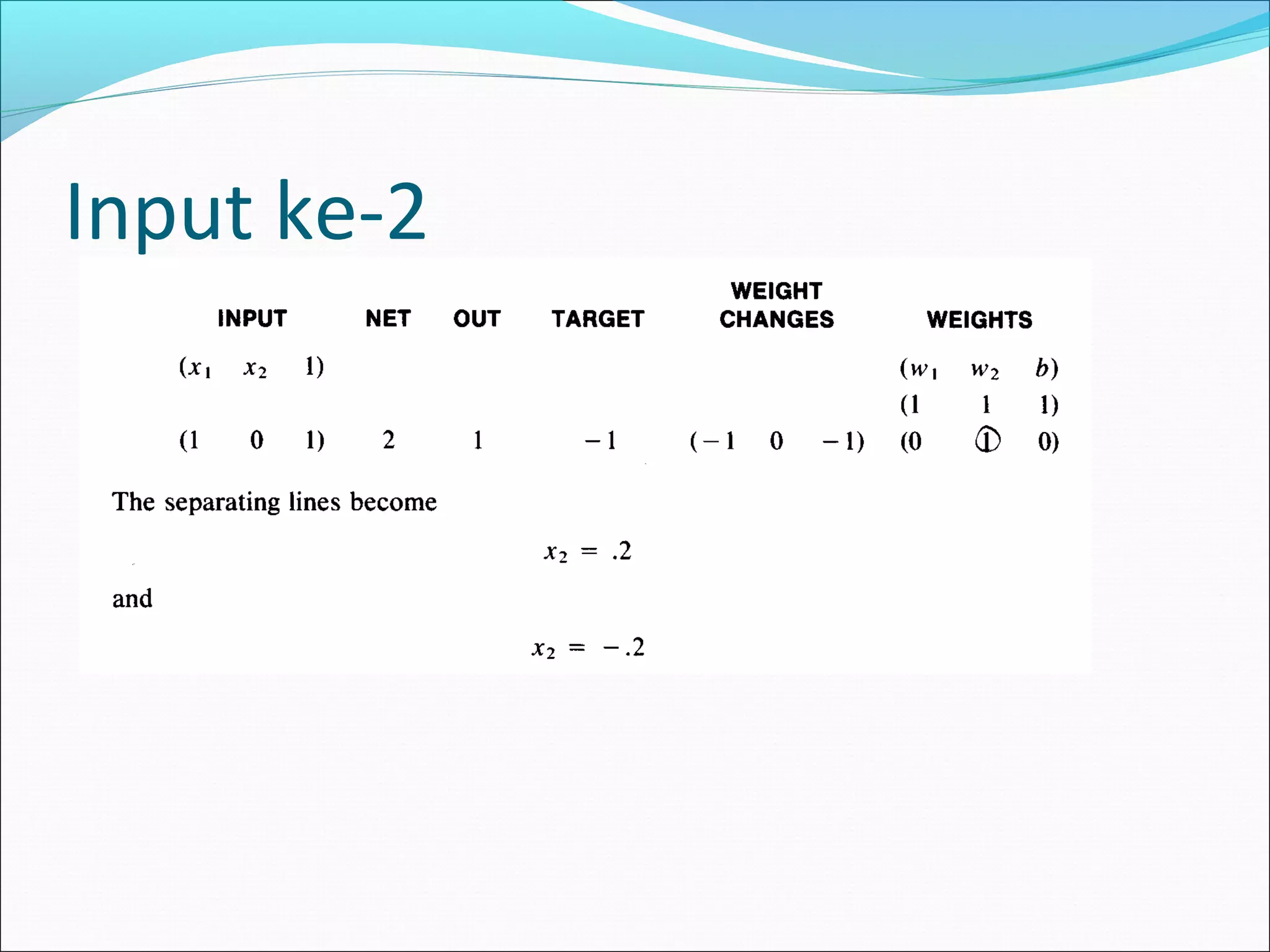

![Adeline

Adaptive Linear Neutron [Widrow & Hoff, 1960]

Menggunakan bipolar untuk data input dan output

Bobot diubah (diperbaiki) berdasarkan perbedaan

output dengan target disebut delta rule atau LMS

(least mean square) atau Widrow-Hoff rule

Fungsi aktifasi adalah fungsi identitas

Tujuan pembelajaran adalah meminimalisasi lms

error antara output dengan target.](https://image.slidesharecdn.com/pengenalan-pola-sederhana-dg-perceptron-160214070542/75/Pengenalan-pola-sederhana-dg-perceptron-23-2048.jpg)