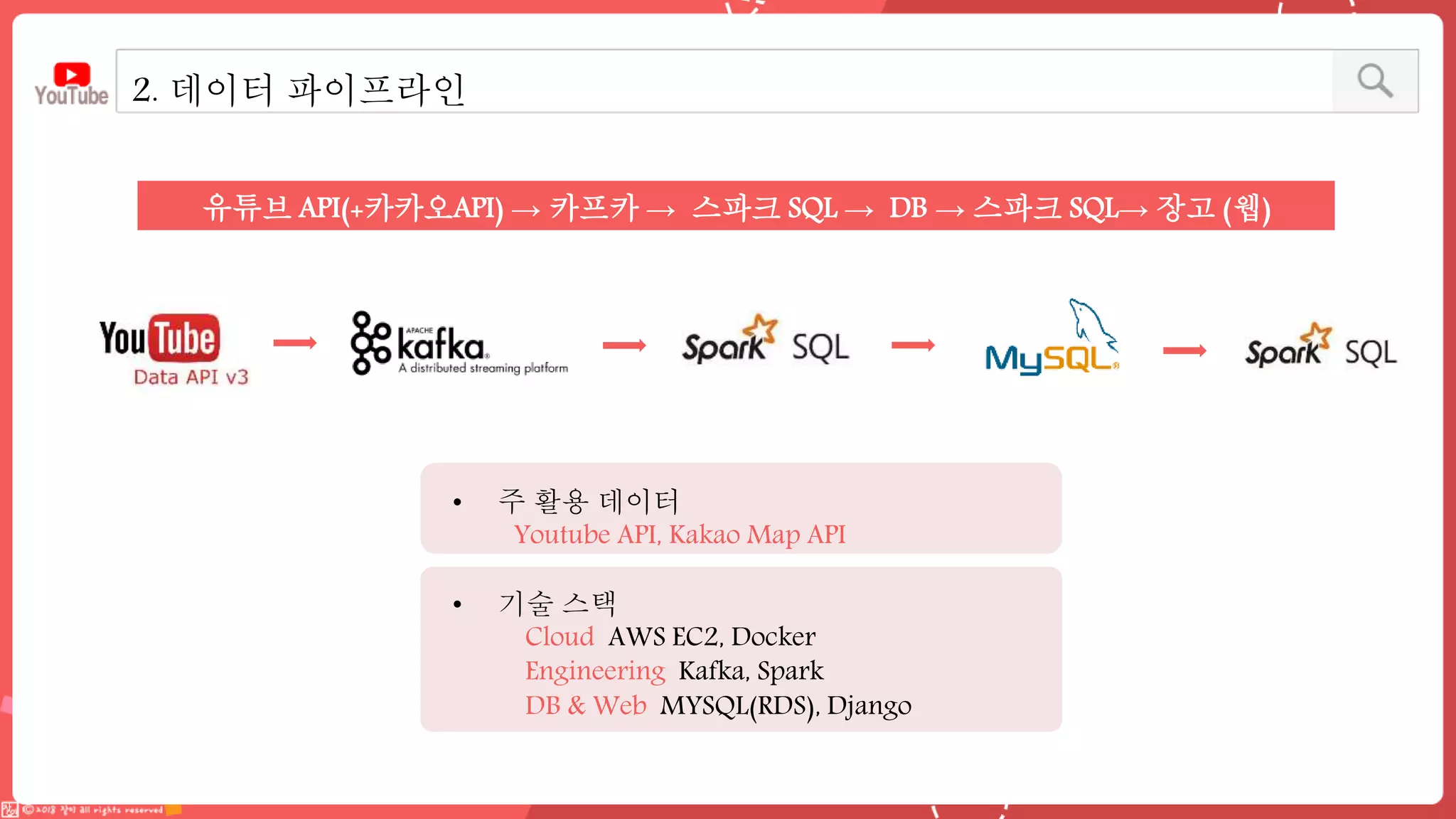

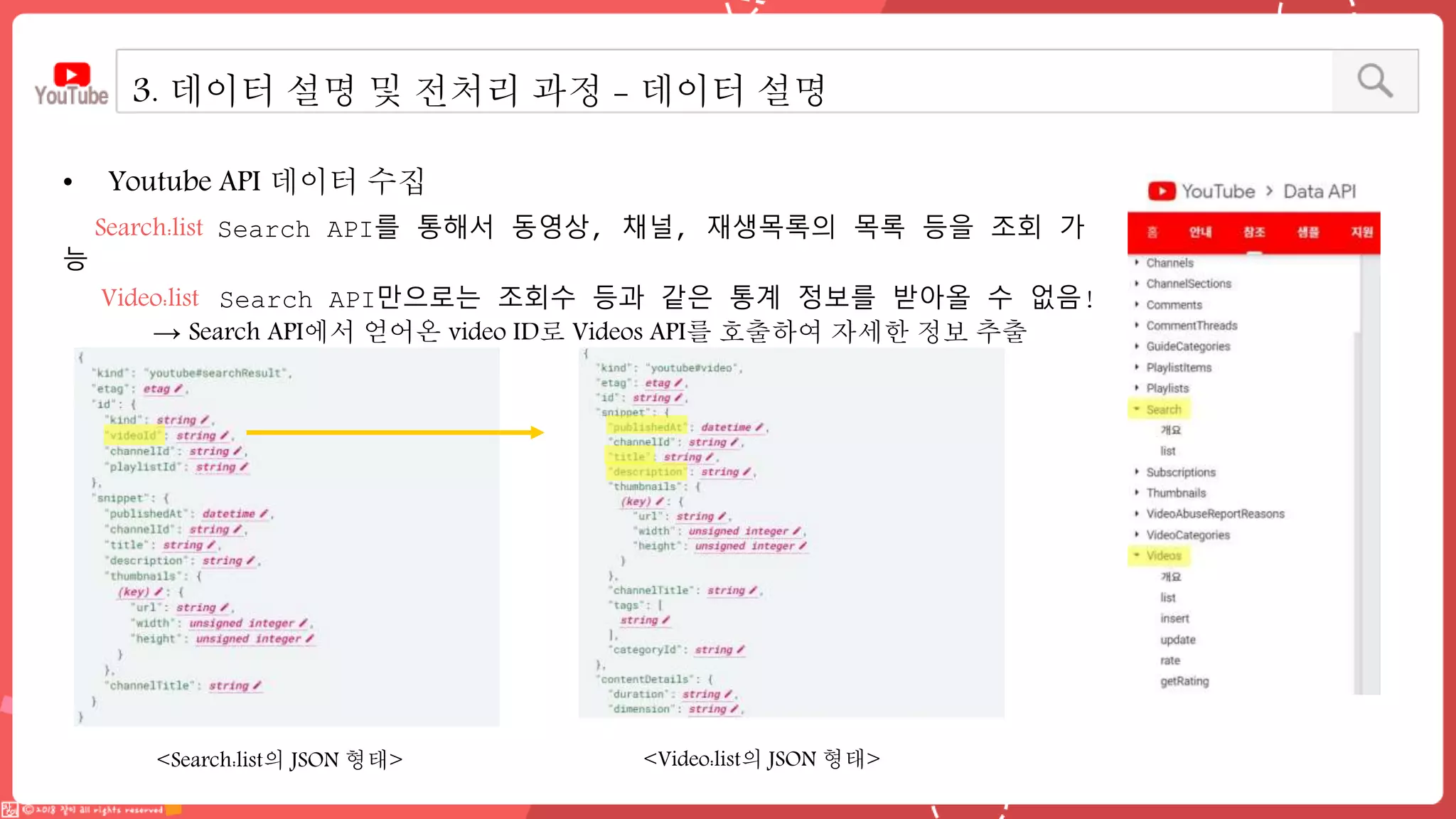

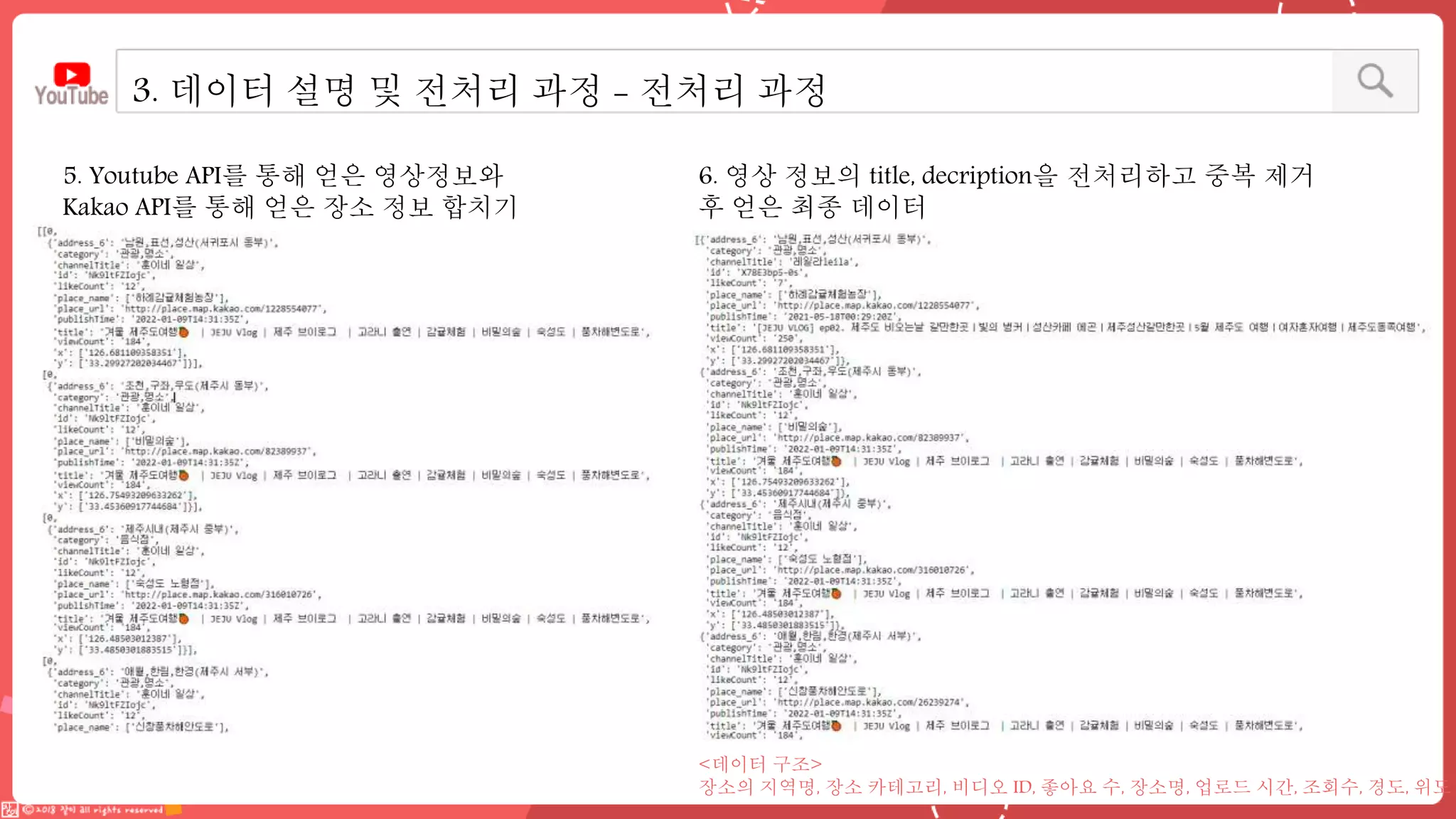

데이터 엔지니어링 프로젝트를 진행한 YouPlace팀에서는 아래와 같은 프로젝트를 진행했습니다.

<aside>

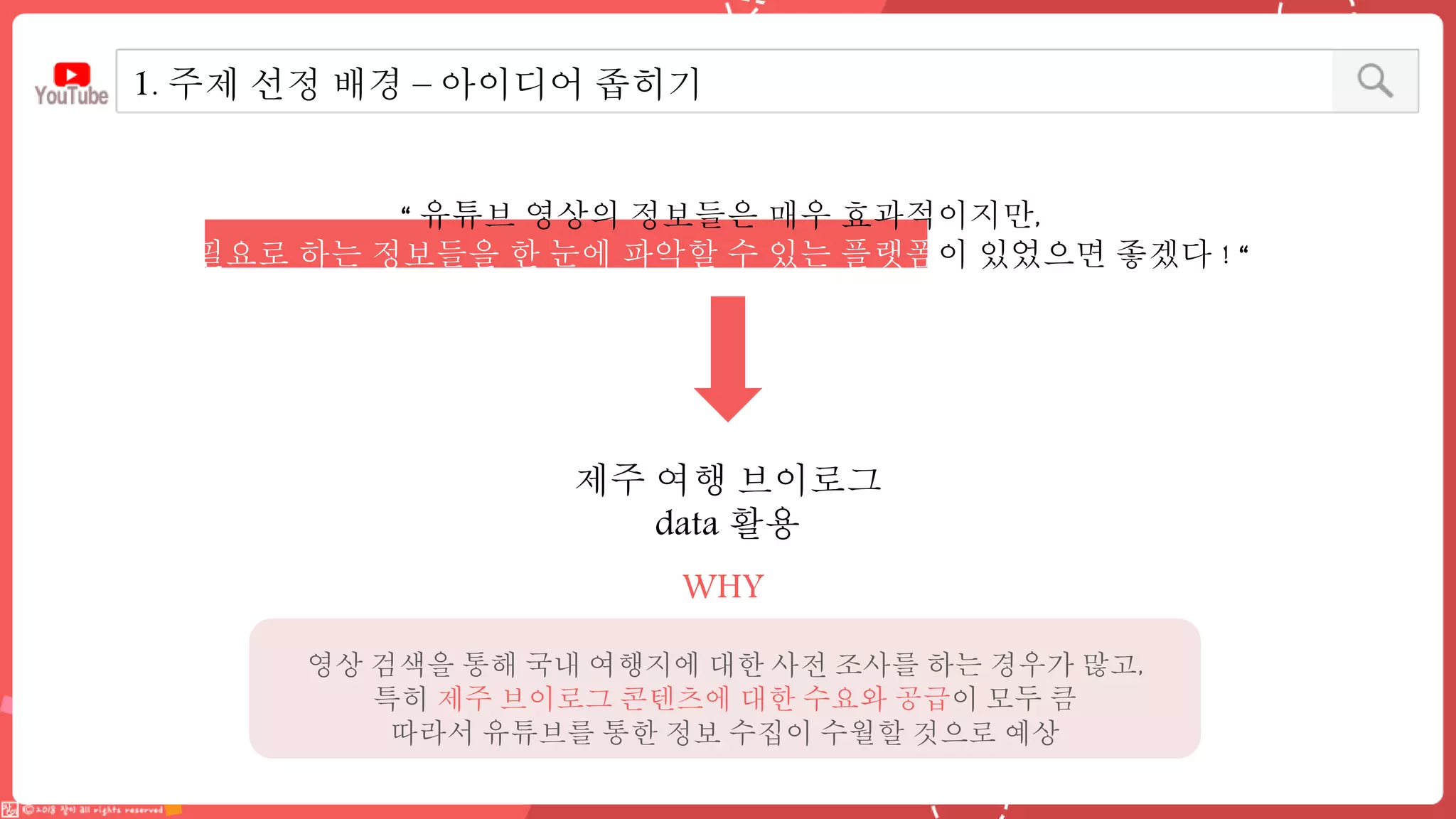

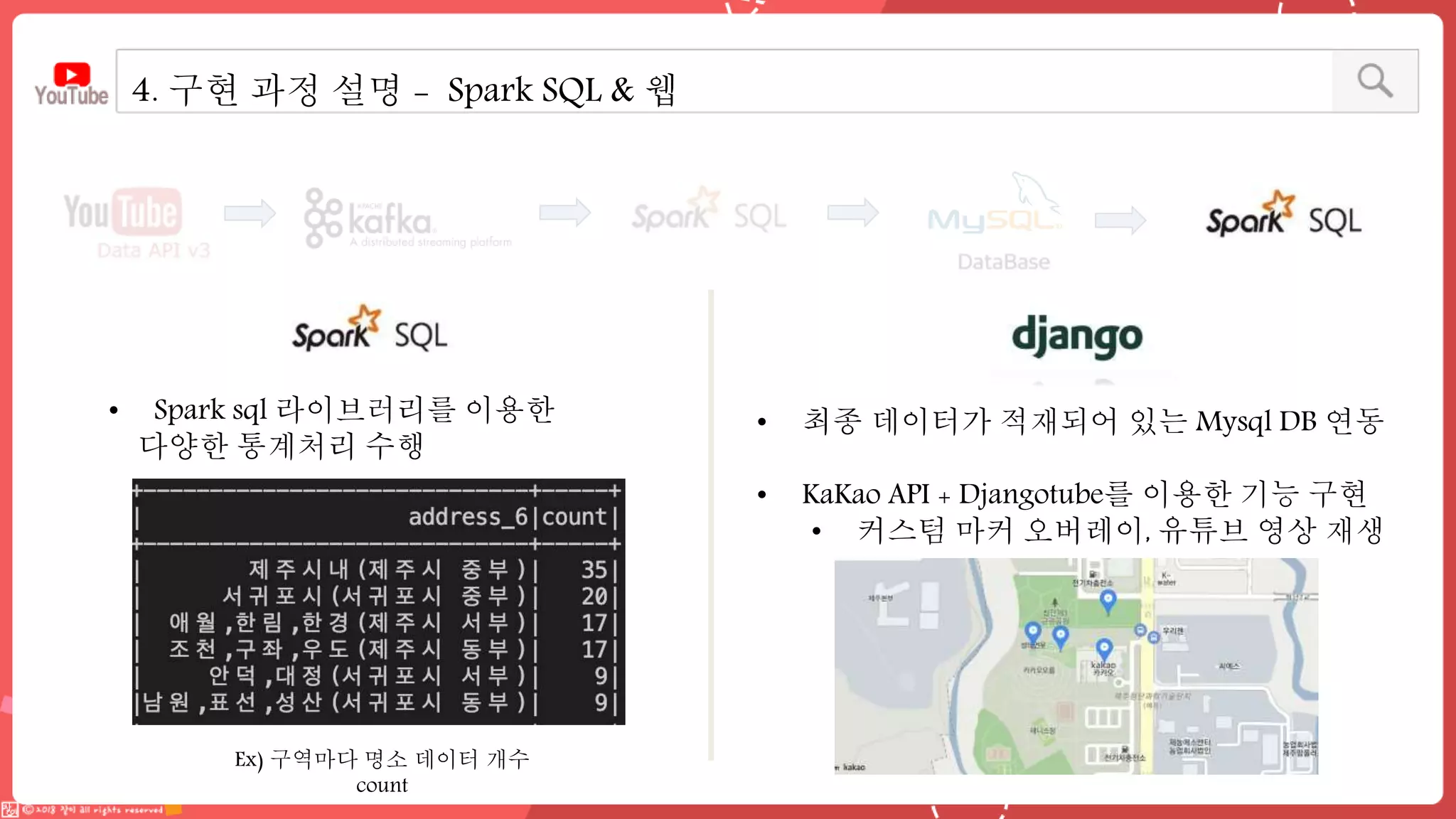

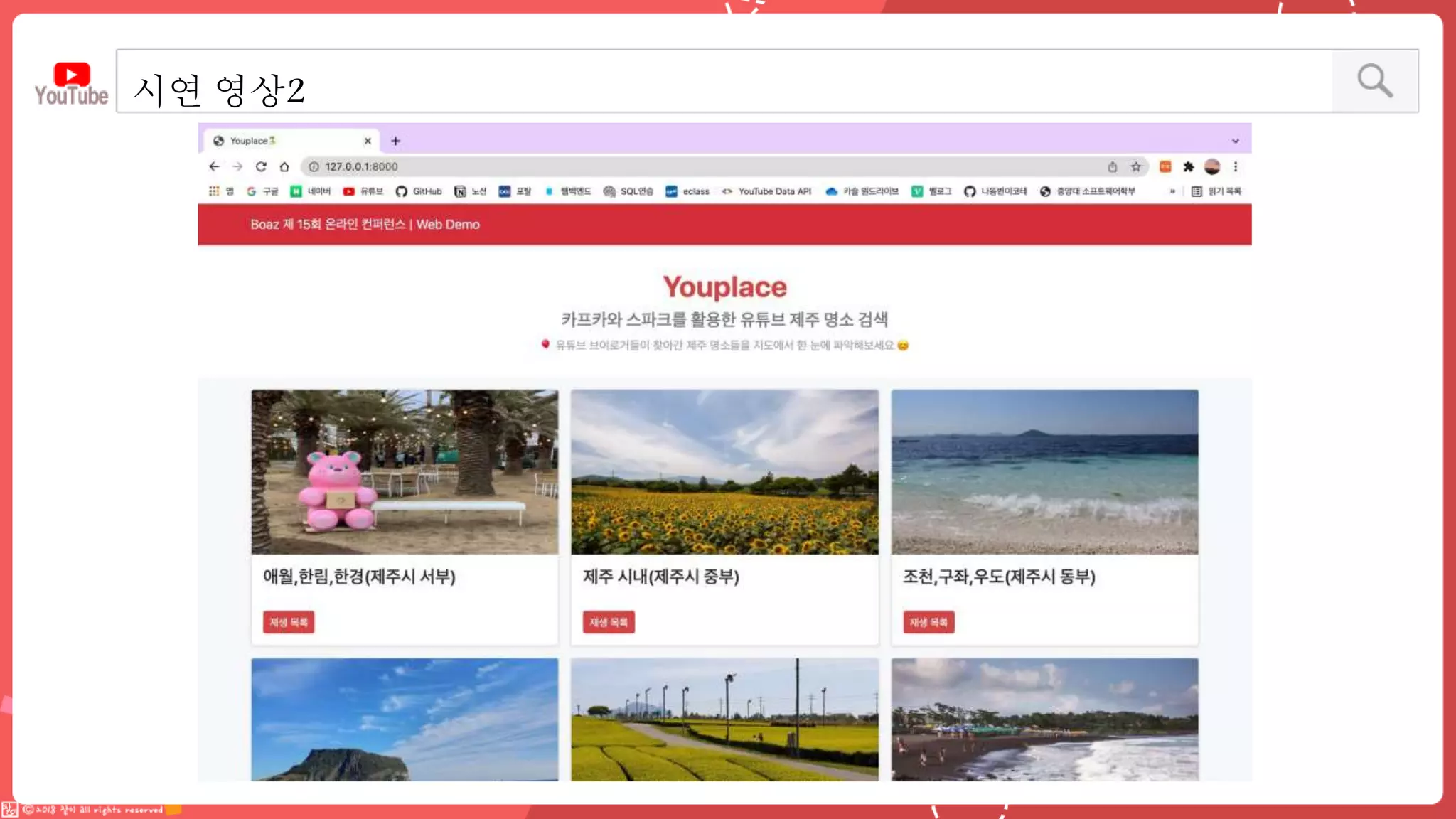

이젠 검색도 유튜브 시대

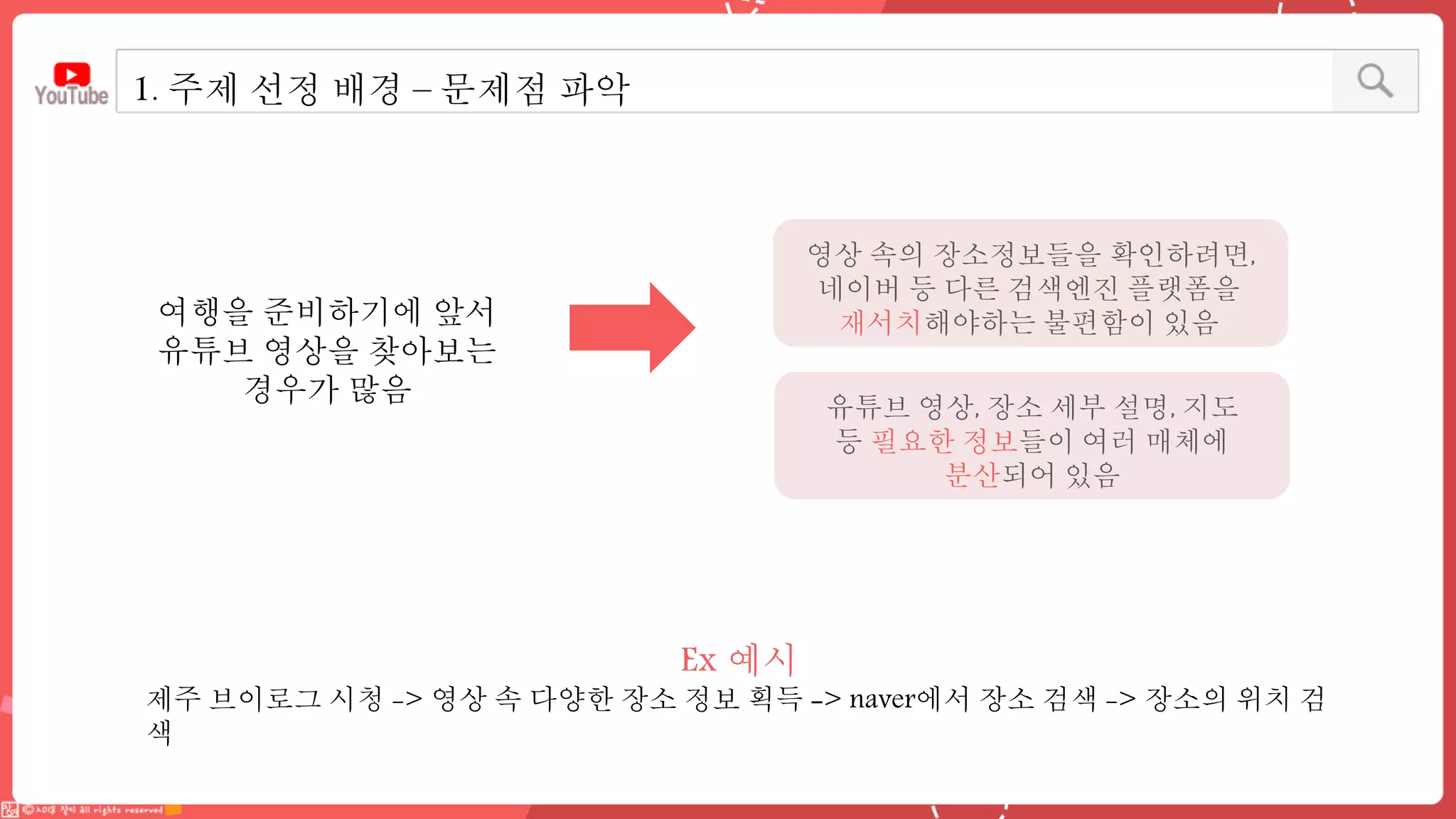

제주여행을 계획할 때 브이로그 영상을 많이 참고하실텐데요

수많은 영상들과 영상 속 분산된 명소들을 하나 하나 찾으려 생각하면 막막하지 않으셨나요?

이러한 고민을 갖고 계신 분들을 위해, 유튜브 브이로거들이 찾아간 여행 명소들을 지도에서 한 눈에 파악할 수 있도록 만들었어요

(github : https://github.com/Boaz-Youplace)

16기 엔지니어링 고은서 | 중앙대학교 소프트웨어학부

16기 엔지니어링 류정화 | 성신여자대학교 융합보안공학과

16기 엔지니어링 송경민 | 국민대학교 소프트웨어학과

![제 15회 보아즈(BOAZ) 빅데이터 컨퍼런스 - [YouPlace 팀] : 카프카와 스파크를 활용한 유튜브 영상 속 제주 명소 검색](https://image.slidesharecdn.com/10youplace-220124105901/75/15-BOAZ-YouPlace-25-2048.jpg)