Almacenes de datos, olap y minería de datos

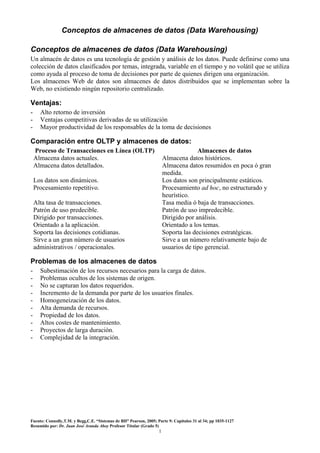

- 1. Conceptos de almacenes de datos (Data Warehousing) Conceptos de almacenes de datos (Data Warehousing) Un almacén de datos es una tecnología de gestión y análisis de los datos. Puede definirse como una colección de datos clasificados por temas, integrada, variable en el tiempo y no volátil que se utiliza como ayuda al proceso de toma de decisiones por parte de quienes dirigen una organización. Los almacenes Web de datos son almacenes de datos distribuidos que se implementan sobre la Web, no existiendo ningún repositorio centralizado. Ventajas: - Alto retorno de inversión Ventajas competitivas derivadas de su utilización Mayor productividad de los responsables de la toma de decisiones Comparación entre OLTP y almacenes de datos: Proceso de Transacciones en Línea (OLTP) Almacena datos actuales. Almacena datos detallados. Almacenes de datos Almacena datos históricos. Almacena datos resumidos en poca ó gran medida. Los datos son principalmente estáticos. Procesamiento ad hoc, no estructurado y heurístico. Tasa media ó baja de transacciones. Patrón de uso impredecible. Dirigido por análisis. Orientado a los temas. Soporta las decisiones estratégicas. Sirve a un número relativamente bajo de usuarios de tipo gerencial. Los datos son dinámicos. Procesamiento repetitivo. Alta tasa de transacciones. Patrón de uso predecible. Dirigido por transacciones. Orientado a la aplicación. Soporta las decisiones cotidianas. Sirve a un gran número de usuarios administrativos / operacionales. Problemas de los almacenes de datos - Subestimación de los recursos necesarios para la carga de datos. Problemas ocultos de los sistemas de origen. No se capturan los datos requeridos. Incremento de la demanda por parte de los usuarios finales. Homogeneización de los datos. Alta demanda de recursos. Propiedad de los datos. Altos costes de mantenimiento. Proyectos de larga duración. Complejidad de la integración. Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 1

- 2. Conceptos de almacenes de datos (Data Warehousing) Arquitectura de un almacén de datos Las principales componentes de un almacén de datos son: 1. Fuentes de Datos operacionales: todos los datos operacionales previamente almacenados en BDs, archivos propietarios, estaciones primarias de trabajo e incluso en sistemas externos como Internet, bases de datos comerciales ó bases de datos dependientes de los proveedores ó clientes de la organización. 2. Repositorio de datos operacionales (Operacional Data Store - ODS): es un almacén de datos operacionales actuales e integrados que se utilizan para el análisis. 3. Gestor de carga (ó componente de interfaz): realiza todas las operaciones asociadas con la extracción y carga de los datos en el almacén. Se incluyen transformaciones simples. 4. Gestor del almacén de datos: realiza las operaciones asociadas con la gestión de datos dentro del almacén. Incluye el análisis de los datos para garantizar su coherencia, transformación y combinación de datos de origen, creación de índices y vistas, generalización de agregaciones y desnormalizaciones, y el archivado y copia de seguridad de los datos. 5. Gestor de consultas (ó componente de servicio): realiza todas las operaciones asociadas con la gestión de las consultas de los usuarios: dirigir consultas hacia tablas apropiadas y planificar su ejecución. 6. Datos detallados: área del almacén que guarda todos los datos detallados contenidos en el esquema de la BD. 7. Datos poco resumidos y muy resumidos: guarda todos los datos, poco ó muy resumidos (agregados), que hayan sido establecidos por el gestor de datos como resúmenes predefinidos. 8. Datos de archivo / copia de seguridad: guarda los datos detallado y resumidos con el propósito de mantener un archivo y disponer de copias de seguridad. 9. Metadatos: guarda todas las definiciones de metadatos (datos acerca de los datos) utilizadas por todos los procesos del almacén. Se utilizan para propósitos tales como: Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 2

- 3. Conceptos de almacenes de datos (Data Warehousing) - los procesos de extracción y carga: los metadatos “mapean” las fuentes de datos sobre una vista común de los datos utilizada dentro del almacén - el proceso de gestión del almacén: los metadatos se utilizan para automatizar la producción de tablas de resúmenes - como parte del proceso de gestión de consultas: los metadatos se usan para dirigir una consulta a la fuente de datos más apropiada. 10. Herramientas de acceso para usuarios finales: - Consulta y generación de informes: Incluyen generación de informes de producción –de carácter operacional, periódicos ó con altos volúmenes de tareas- y escritores de informes – diseñados para usuarios finales, de bajo costo-. Las herramientas de consulta para almacenes de datos relacionales están diseñadas para aceptar SQL ó generar instrucciones SQL con el fin de consultar los datos del almacén. - Desarrollo de aplicaciones: Puede requerirse por algunos usuarios. - Sistemas de información ejecutiva (EIS): Inicialmente para ayuda a la toma de decisiones estratégicas de alto nivel. Se han ampliado para incluir soporte para todos los niveles de gestión. - Procesamiento analítico en línea (OLAP): Basadas en el concepto de BDs multidimensionales. Permiten analizar los datos mediante vistas complejas de carácter multidimensional. Genera modelos retrospectivos. - Minería de Datos: Proceso de descubrimiento de nuevas correlaciones, patrones y tendencias significativas procesando grandes cantidades de datos mediante técnicas estadísticas, matemáticas y de inteligencia artificial. Posee la capacidad de construir modelos predictivos. Flujos de datos en un almacén Los almacenes de datos se centran en la gestión de cinco flujos principales de datos: Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 3

- 4. Conceptos de almacenes de datos (Data Warehousing) 1. Flujo de entrada: Constituido por lo procesos asociados con la extracción, limpieza y carga de los datos de los sistemas de origen en el almacén de datos. 2. Flujo ascendente: Constituido por los procesos asociados con la adición de valor a los datos del almacén, mediante los procesos de resumen, empaquetado y distribución de los datos. 3. Flujo descendente: Son los procesos asociados con el archivado y la realización de copias de seguridad de los datos en el almacén. 4. Flujo de salida: Procesos asociados con la puesta de los datos a disponibilidad de los usuarios finales. 5. Metaflujo: Procesos asociados con la gestión de los datos sobre los datos: metadatos. Herramientas y tecnologías de almacén de datos 1. Herramientas de extracción, limpieza y transformación - Generadores de código: Crean programas de transformación 3GL / 4GL personalizados, basado en las especificaciones de datos de origen y de destino. - Replicación de datos: emplean disparadores (triggers) en BDs ó usan el registro de actividad para capturar cambios efectuados en un origen de datos y aplicarlos sobre una copia ubicada en otro sistema diferente. - Motores de transformación dinámica: dirigidos por reglas, capturan datos de un sistema de origen a intervalos definidos por el usuario, los transforman y envían para su carga en un entorno destino. 2. Sistemas de Gestión de Bases de Datos para almacenes de datos Los requisitos para un Sistema de Gestión de Bases de Datos Relacional (SGBDR) para almacenes de datos incluyen: - velocidad de carga buena, a partir del requerimiento de carga incremental de nuevos datos de manera periódica, con ventanas temporales cortas. - el procesamiento de la carga, lo que incluye pasos para incluir datos nuevos, actualizar, convertir, filtrar, indexar y actualizar metadatos. - la gestión de la calidad de los datos, ya que deben garantizarse: coherencia local, coherencia global e integridad referencial a pesar de los posibles problemas en los orígenes de datos. - la velocidad de las consultas no debe disminuir. Las técnicas de gestión basadas en hechos y en análisis ad hoc no deben ser ralentizadas ó inhibidas por las prestaciones del SGBR del almacén de datos. - escalabilidad en el rango de almacenamiento: el SGBDR no debe tener limitaciones de arquitectura en lo que respecta ala tamaño de la BD, y debe soportar gestión modular y paralela. En caso de fallo, debe soportar una disponibilidad continua y proporcionar mecanismos para la recuperación. Debe permitir usar dispositivos de almacenamiento masivo: discos ópticos, y dispositivos de gestión jerárquica de almacenamiento. La velocidad de las consultas no debe depender del tamaño de la BD, sino solamente de su complejidad. - escalabilidad en cuanto a número de usuarios: los SGBDR deben ser capaces de soportar miles de usuarios concurrentes sin que por ello sufran una degradación en la velocidad de procesamiento de las consultas. - Almacén de datos en red: capacidad para coopera en una red de almacenes de datos. Debe incluir herramientas que coordinen las transferencias de subconjuntos de datos entre diversos almacenes. - Administración del almacén: demandan alta flexibilidad y gran facilidad de administración. El SGBD debe proporcionar controles para implementar límites de utilización de los recursos, contabilidad de costos, mecanismos de asignación de prioridad a las consultas, para optimización y control de la carga de trabajo, etc. Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 4

- 5. Conceptos de almacenes de datos (Data Warehousing) - Análisis dimensional integrado: para proporcionar las máximas prestaciones a las herramientas OLAP relacionales. Soporte para creación rápida y simple de los tipos de resúmenes precalculados y para automatizar la creación de agregados precalculados. Los cálculos dinámicos de agregados deben ser coherentes con las prestaciones de procesamiento interactivo que esperan los usuarios finales. - Funcionalidad avanzada de consultas: Debe proporcionarse un conjunto completo y avanzado de operaciones que permitan cálculos analíticos complejos, análisis secuenciales y comparativos y acceso coherente a datos detallados y de resumen. 3. Metadatos de un almacén de datos Su objetivo principal es mostrar cual es el camino que lleva hacia el origen de los datos, de modo que los administradores del almacén de datos conozcan la historia de cualquier elemento almacenado. Su gestión es una tarea compleja y difícil. Se usan para diversos propósitos, resultando elementos críticos para conseguir una plena integración del almacén. El principal problema de integración consiste en sincronizar los diversos tipos de metadatos utilizados en el almacén. 4. Herramientas de administración y gestión Deben ser capaces de soportar tareas tales como: - monitorizar la carga de datos desde múltiples fuentes; - comprobar la calidad e integridad de los datos; - gestionar y actualizar los metadatos; - monitorizar el rendimiento de la BD para garantizar tiempos de respuesta cortos a las consultas y eficiente empleo de los recursos; - auditar el uso del almacén para atribuir los costos respectivos a los distintos usuarios; - replicar, dividir y distribuir los datos; - purgar los datos; - archivar y realizar copias de seguridad; - implementar mecanismos de recuperación ante fallos; - gestionar adecuadamente la seguridad. Mercados de datos (Data Marts) Un subconjunto de un almacén de datos que soporta los requisitos de un departamento ó área de negocios concreto. Las principales características que diferencian a los mercados de datos de los almacenes de datos son: - un mercado de datos se centra únicamente en los requisitos de los usuarios asociados con un departamento ó área de negocio concreto; - los mercados de datos no contienen normalmente datos operacionales detallados, a diferencia de lo que sucede con los almacenes de datos; - como los mercados de datos contienen menos información que un almacén de datos, son más fáciles de comprender y de utilizar. Razones para crear un mercado de datos: - Proporcionar a los usuarios acceso a los datos que necesiten analizar de manera mas frecuente. - Proporcionar los datos en una forma que se adapte a la vista colectiva que tiene de los datos un grupo de usuarios pertenecientes a un departamento ó área de negocios concreto. - Mejorar el tiempo de respuesta a las consultas del usuario final, gracias a la reducción en el volumen de los datos a los que hay que acceder. - Proporcionar datos apropiadamente estructurados según dicten los requisitos de las herramientas de accesos para usuarios finales, las cuales pueden requerir sus propias estructuras de BD internas. Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 5

- 6. Conceptos de almacenes de datos (Data Warehousing) - - Los mercados de datos emplean normalmente menos datos, por lo que las tareas de limpieza, carga, transformación e integración de los datos son más sencillas, lo que trae como resultado que la implementación y puesta en marcha sea más simple que establecer un almacén corporativo. El costo de implementación de los mercados es inferior al requerido para un almacén corporativo. Los usuarios potenciales están claramente definidos y son más fáciles de convencer para que colaboren con un proyecto de mercado de datos que para un proyecto de almacén corporativo. Cuestiones fundamentales en los mercados de datos - Funcionalidad: Las capacidades se han incrementado. La complejidad y el tamaño de algunos mercados de datos es comparables con algunos almacenes corporativos de baja gama. - Tamaño: Los usuarios esperan tiempos de respuesta más cortos. - Velocidad de carga: Deben equilibrarse dos componentes críticos: tiempo de respuesta de las consultas del usuario final y velocidad de carga de los datos. - Acceso de los usuarios a múltiples mercados de datos: Una técnica posible es replicar datos entre diferentes mercados, otra construir mercados de datos virtuales. - Acceso Internet / intranet al mercado de datos: bajo costo, utilizando navegadores. - Administración: Necesidad de gestionar y coordinar centralizadamente las actividades de los mercados de datos. Surgen problemas con las versiones, coherencia e integridad de los datos y metadatos, seguridad del nivel corporativo y con los ajustes del rendimiento. Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 6

- 7. Conceptos de almacenes de datos (Data Warehousing) - Instalación: Cada vez son más complejos de construir. Diseño de almacenes de datos Diseño de la BD para un almacén de datos Se necesita responder a preguntas tales como: ¿Qué requisitos de usuario son los más importantes? ¿Qué datos deben considerarse en primer lugar? ¿Deberá reducirse el alcance del proyecto para que sea más manejable y al mismo tiempo proporcionar una infraestructura que pueda crecer posteriormente hasta convertirse en un almacén de datos completo de ámbito corporativo? Modelado de la dimensionalidad Técnica de diseño lógico que trata de presentar los datos de una manera estándar e intuitiva que permita un acceso de alto rendimiento. Utiliza los conceptos del modelado Entidad – Relación (ER), con algunas restricciones importantes. Todo modelo dimensional (dimensional model – DM) está compuesto de una tabla con una clave principal compuesta, denominada tabla de hechos, y un conjunto de tablas mas pequeñas denominadas tablas de dimensión. Cada tabla de dimensión tiene una clave principal simple (no compuesta) que se corresponde con exactamente uno de los componentes de la clave compuesta de la tabla de hechos. Todas las claves naturales se sustituyen por claves subrogadas de manera que toda combinación entre la tabla de hechos y las de dimensiones están basadas en estas claves subrogadas. - Esquema (ó combinación) en estrella: Estructura lógica que tiene una tabla de hechos que contiene datos factuales en el centro, rodeada por tablas de dimensión que contienen datos de referencia. - Esquema en copo de nieve: Variante en el que las tablas de dimensión no contienen datos desnormalizados. - Esquema en copo de estrella: Estructura híbrida que contiene mezcla de esquemas en estrella y en copo de nieve. La forma predecible y estándar del modelo dimensional ofrece ventajas para un entorno de almacén de datos: - Eficiencia: La coherencia de la estructura de BD subyacente permite un acceso más eficiente a los datos por parte de las distintas herramientas, incluyendo las de consultas y generación de informes. - Posibilidad de gestionar requisitos cambiantes, ya que el esquema puede adaptarse a cambios en los requisitos de los usuarios producto de que todas las dimensiones son equivalentes en términos de proporcionar acceso a la tabla de hechos. El diseño está mejor adaptado para soportar consultas ad hoc. - Ampliabilidad para: a) permitir adición de nuevos hechos, siempre que sean coherentes con la granularidad fundamental de la tabla de hechos existente; b) adición de nuevas dimensiones, siempre y cuando haya un único valor de dicha dimensión definido para cada registro de hechos existente; c) Adición de nuevos atributos dimensionales; y d) descomposición de los registros de dimensión existentes para tener un menor nivel de granularidad a partir de un cierto instante temporal. - Capacidad de modelar situaciones empresariales comunes. - Procesamiento de consultas predecible, ya que en el nivel mas bajo, cada tabla de hechos debe ser consultada de manera independiente. Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 7

- 8. Conceptos de almacenes de datos (Data Warehousing) Metodología de diseño de BDs para DW Un aspecto importante en el trabajo con almacenes de datos es comprender que un modelo ER se descompone normalmente en múltiples modelos DM. Los diferentes DM se asocian mediante tablas de dimensión conformadas (“compartidas”). Comúnmente se emplea la llamada “Metodología de los Nueve pasos”: 1. Selección del proceso: Hace referencia al tema objetivo de un mercado concreto. 2. Selección de la granularidad: Decidir exactamente qué es lo que va a representar cada registro de la tabla de hechos. Determina también la granularidad de las tablas de dimensión. 3. Identificación y conformación de las dimensiones: Se establece el contexto para consultar los hechos. Un buen conjunto de dimensiones hace que el mercado sea comprensible y fácil de usar. 4. Selección de los hechos: La granularidad determina cuáles hechos pueden emplearse en el mercado de datos. 5. Almacenamiento de los valores precalculados en la tabla de hechos: Análisis para evaluar posibilidad de empleo de valores precalculados. 6. Terminación de las tablas de dimensión: Se añaden tantas descripciones textuales, intuitivas y comprensibles para los usuarios, como sea posible. El uso de un mercado de datos está determinado por el ámbito y naturaleza de los atributos de las tablas de dimensión. 7. Selección de la duración de la BD: Hasta que momento del pasado debe retroceder la tabla de hechos. 8. Control de dimensiones lentamente cambiantes. 9. Selección de las prioridades de consulta y de los modos de consulta: Considera los aspectos del diseño físico. Criterios para verificar la dimensionalidad de un almacén de datos Se dividen en tres grupos amplios: 1- Arquitectura: Son características fundamentales de la forma en que el sistema completo está organizado. 2- Administración: Son tácticos, pero esenciales para la operación adecuada de un almacén de datos orientado dimensionalmente. 3- Expresión: Capacidades analíticas necesarias en situaciones reales. Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 8

- 9. Procesamiento Analítico en Línea (OLAP) OLAP El Procesamiento Analítico en Línea (OLAP) es la síntesis, análisis y consolidación dinámica de grandes volúmenes de datos multidimensionales. Aplicaciones: - cálculo de presupuestos, - análisis de rendimiento financiero, - análisis y previsión de ventas, - análisis e investigación de mercados y - segmentación de mercados / clientes. Características - Vistas multidimensionales de los datos: requisito fundamental para la construcción de un modelo de negocio “realista”. Una vista multidimensional de los datos proporciona la base para el procesamiento analítico, al permitir un acceso flexible a los datos corporativos. Debe tratar todas las dimensiones de manera equitativa. No debe influenciar los tipos de operaciones permitidas sobre una determinada dimensión ni la tasa a la que estas operaciones se realicen. Debe permitir que los usuarios analicen los datos según cualquier dimensión y en cualquier nivel de agregación, manteniendo una misma funcionalidad y facilidad de uso. Igualmente, debe soportar todas las vistas multidimensionales de los datos en la manera mas intuitiva posible. Los sistemas OLAP deben ocultar lo más posible a los usuarios la sintaxis de consultas complejas y proporcionar tiempos de respuesta siempre cortos para todas las consultas, independientemente de su complejidad. - Soporte para cálculos complejos: El software debe proporcionar diversos métodos de cálculo suficientemente potentes, como los requeridos para realizar previsiones de ventas, que utilizan algoritmos de cálculos de tendencias: medias móviles y crecimientos porcentuales. - Inteligencia temporal: Característica clave. Debe poderse definir conceptos como acumulados de año, comparaciones entre períodos, etc. Beneficios: - mayor productividad de los usuarios finales de la organización, de los desarrolladores de los departamentos de tecnologías de la información, acceso controlado y oportuno a la información de carácter estratégico; - reducción en la carga de trabajo de desarrollo de aplicaciones, pues brinda autosuficiencia para los usuarios finales que pueden desarrollar sus propios modelos y cambios de esquema; - se conserva el control sobre la integridad de los datos corporativos, ya que los sistemas OLAP dependen de los almacenes de datos y de los sistemas OLTP para refrescar sus datos de origen; - menor frecuencia de consultas y menor tráfico de los sistemas OLTP ó en el almacén de datos; - mayores ingresos y beneficios potenciales al permitir que la organización responda rápidamente a las demandas del mercado. Representación de datos multidimensionales – Cubos Los servidores de BDs OLAP utilizan estructuras multidimensionales para almacenar los datos y relaciones entre los mismos. La mejor forma de visualizar estructuras multidimensionales es como cubos de datos. Cada lado de un cubo se denomina dimensión. El tiempo de respuesta depende de cuantas celdas se sumen en la marcha. Con el incremento del número de dimensiones, el número de celdas del cubo crece exponencialmente. Sin embargo, la mayoría de las consultas tratan con datos resumidos de alto nivel, por lo que pueden previamente agregarse (consolidarse) todos los totales y subtotales lógicos según todas las dimensiones. Esta agregación previa puede ser especialmente valiosa ya que las dimensiones típicas son de naturaleza Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 9

- 10. Procesamiento Analítico en Línea (OLAP) jerárquica. Imponer jerarquía predefinida para cada dimensión permite agregación lógica previa y, a la inversa, profundización lógica. Operaciones analíticas comunes: - Consolidación: implica agregación de datos, como totalizaciones simples ó expresiones complejas que impliquen datos relacionados. - Profundización: operación inversa de la consolidación. Implica mostrar datos de detalle comprendidos en datos consolidados. - Navegación (pivotaje): capacidad de examinar los datos desde diferentes puntos de vista, con el fin de analizar tendencias y encontrar patrones. La pre-agregación, las jerarquías dimensionales y la gestión de datos dispersos pueden reducir significativamente el tamaño de la base de datos y las necesidades de cálculo. Estas técnicas eliminan la necesidad de efectuar combinaciones multitabla y proporcionan un acceso rápido y directo a las matrices de datos, acelerando la ejecución de las consultas multidimensionales. Los servidores OLAP tienen la capacidad de almacenar datos multidimensionales de manera comprimida, para maximizar el empleo del espacio. Los datos densos, que existen para un alto porcentaje de celdas, pueden almacenarse independientemente de los datos dispersos, aquellos en que un porcentaje altamente significativo de celdas están vacías. La capacidad de un SGBD para omitir celdas vacías ó repetitivas contribuye a reducir el tamaño del cubo y la cantidad de procesamiento. Estas optimizaciones minimizan necesidades de almacenamiento físico, permitiendo el análisis de grandes cantidades de datos, con incremento en las prestaciones, etc. Reglas de Codd para las herramientas OLAP: 1. Vista conceptual multidimensional 2. Transparencia 3. Accesibilidad 4. Prestaciones coherentes en la generación de informes 5. Arquitectura cliente – servidor 6. Dimensionalidad genérica 7. Gestión dinámica de matrices dispersas 8. Soporte multiusuario 9. Operaciones interdimensionales no restringidas 10. Manipulación de datos intuitiva 11. Generación flexible de informes 12. Dimensiones y niveles de agregación ilimitados Categorías de herramientas OLAP - OLAP multidimensional (MOLAP): Utilizan estructuras especializadas de datos y SGBD multidimensionales para organizar, navegar y analizar los datos. Los problemas de desarrollo asociados con la tecnología MOLAP son: a) Sólo pueden almacenarse y analizarse de manera eficiente una cantidad limitada de datos. Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 10

- 11. Procesamiento Analítico en Línea (OLAP) - - - b) La navegación y el análisis de datos están limitados. El soporte de nuevos requisitos puede demandar la reorganización física de los datos. c) Requieren un conjunto diferente de capacidades y herramientas para construir y mantener la BD, incrementando el costo y complejidad de las tareas de soporte. OLAP relacional (ROLAP): Soportan productos SGBDR mediante el uso de un nivel de metadatos, evitándose así crear una estructura de datos multidimensional estática. Algunos productos ROLAP disponen de motores SQL mejorados para soportar la complejidad del análisis multidimensional; pero otros productos recomiendan usar BDs altamente desnormalizadas como el esquema en estrella. Los problemas de desarrollo asociados con la tecnología ROLAP son: a) Problemas de rendimiento asociados con el procesamiento de consultas complejas que requieran efectuar múltiples pasadas a través de los datos relacionales. b) Desarrollo de middleware para facilitar el desarrollo de aplicaciones multidimensionales: software que convierta la relación bidimensional en una estructura multidimensional. c) Desarrollo de una opción para crear estructuras multidimensionales persistentes, junto con las funciones para ayudar a administrarlas. OLAP híbrido (HOLAP): Proporciona capacidades limitadas de análisis, bien mediante SGBDR ó por un servidor MOLAP intermedio. El servidor suministra un cubo de datos que se almacena, analiza y mantiene localmente. Los problemas de desarrollo asociados con la tecnología HOLAP son: a) La arquitectura provoca una significativa redundancia de los datos y puede causar problemas en las redes que soporten muchos usuarios. b) La capacidad de cada usuario para construir un cubo personalizado puede provocar una falta de coherencia entre los datos de diferentes usuarios. c) Sólo puede mantenerse de manera eficiente una cantidad limitada de datos. OLAP de escritorio (Desktop OLAP - DOLAP): Almacenan los datos OLAP en archivos situados en la plataforma del cliente y soportan el procesamiento multidimensional utilizando un motor multidimensional del lado del cliente. Requiere extractos relativamente pequeños de los datos en las máquinas de los clientes, los cuales pueden distribuirse por adelantado ó bajo petición. Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 11

- 12. Procesamiento Analítico en Línea (OLAP) Los problemas de desarrollo asociados con la tecnología DOLAP son: a) Provisión de controles de seguridad apropiados, ya que los datos se extraen físicamente del sistema. b) Se necesita reducir el esfuerzo necesario para implementar y mantener herramientas DOLAP c) Las tendencias actuales apuntan hacia el uso de clientes simples. Extensiones OLAP a la norma SQL Una limitación de SQL para los analistas empresariales es su dificultad para responder a consultas frecuentes en dicho entorno como el cálculo del porcentaje de cambio de una serie de valores entre el mes actual y el correspondiente del año anterior, ó calcular una serie de medias móviles, sumas acumulativas y otras funciones estadísticas. El estándar SQL: 2003 (ISO/IEC 9075-2) soporta la funcionalidad OLAP al proporcionar una serie de extensiones para: 1.- Capacidades de agrupación ampliadas (T431) La agregación se proporciona mediante extensiones a la cláusula GROUP BY: 1.1.- Extensión ROLLUP a GROUP BY: Permite calcular múltiples niveles de subtotales según un grupo especificado de dimensiones. SELECT … GROUP BY ROLLUP (lista de columnas) 1.2.- Extensión CUBE para GROUP BY: Forma un conjunto especificado de columnas de agrupamiento y crea subtotales para todas las posibles combinaciones. SELECT… GROUP BY CUBE (lista de columnas) CUBE puede utilizarse en cualquier situación donde sea necesario informe de tablas cruzadas. Es especialmente adecuado en aquellas columnas que usen múltiples dimensiones, en lugar de columnas que representen diferentes niveles de una misma dirección. 2.- Operadores OLAP elementales (T611) Los operadores OLAP elementales del estándar SQL soportan diversas operaciones: Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 12

- 13. Procesamiento Analítico en Línea (OLAP) 2.1.- Funciones de clasificación ordenada: Calcula la posición de un registro en relación con los restantes registros del conjunto de datos, basándose en los valores de un conjunto de medidas. Hay distintos tipos de funciones de clasificación. Ejemplos: RANK ( ) OVER (ORDER BY lista_de_Columnas) DENSE_RANK( ) OVER (ORDER BY lista_de_Columnas) La diferencia entre ambos operadores está en que DENSE_RANK no deja huecos en la secuencia de clasificación cuando existen empates para un cierto puesto. 2.2.- Cálculos de ventana móvil: Pueden utilizarse para calcular agregados acumulativos, móviles y centrados. Se devuelve un valor para cada fila de una tabla que dependerá de otras filas dentro de la ventana correspondiente. Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 13

- 14. Minería de Datos Minería de Datos (Data Mining ) Proceso de extraer información válida, previamente desconocida, comprensible y útil de bases de datos de gran tamaño y utilizar dicha información para tomar decisiones de negocios. Ejemplos de aplicaciones: - Comercio al por menor / marketing Identificación de patrones de compra de los clientes Determinación de asociaciones entre las características demográficas de los clientes Predicción de la respuesta a las campañas de publicidad Análisis de cestas de la compra - Banca Detección de patrones de uso fraudulento de tarjetas de crédito Identificación de clientes leales Predicción de clientes que tienen probabilidad de cambiar de suministrador de servicio Determinación de los gastos realizados por ciertos grupos de clientes - Seguros Análisis de partes Predicción de los clientes que suscriben nuevas pólizas - Medicina Caracterización del comportamiento de los pacientes para predecir las visitas quirúrgicas Identificación de terapias médicas adecuadas para diferentes enfermedades Técnicas de Minería de datos Hay cuatro operaciones principales: 1. Modelado predictivo Puede utilizarse para analizar una base de datos existente con el fin de determinar ciertas características esenciales (modelo) acerca del conjunto de datos. Se utilizan observaciones para formar un modelo de las características más importantes de algún tipo de fenómeno. Es similar al proceso de aprendizaje humano. El modelo se desarrolla utilizando una técnica de aprendizaje supervisado que tiene dos fases: entrenamiento y prueba. La fase de entrenamiento construye un modelo utilizando una muestra de datos históricos denominada conjunto de entrenamiento. Las pruebas permiten comprobar el modelo utilizando datos nuevos, no empleados previamente para el entrenamiento. Clasificación: Técnica empleada para establecer una clase predeterminada específica para cada registro de una BD. Hay dos tipos básicos: inducción en árbol e inducción neuronal. Predicción de valores: Se utiliza para estimar un valor numérico continuo que esté asociado con un registro de BD. 2. Segmentación de la Base de Datos Su objetivo es realizar la partición de la BD en un número desconocido de segmentos ó clústeres de registros similares: compartiendo un conjunto de propiedades, y que, por ello, se consideran Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 14

- 15. Minería de Datos homogéneos. Los segmentos tienen una alta homogeneidad interna y alta heterogeneidad externa. Este enfoque utiliza aprendizaje NO supervisado para descubrir subconjuntos homogéneos dentro de una base de datos con el fin de mejorar la precisión de los perfiles. Se asocia con las técnicas de agrupación neuronal ó demográfica, que se distinguen por los tipos permitidos de datos de entrada, los métodos utilizados para calcular la distancia entre los registros y la presentación de los segmentos resultantes para su análisis. 3. Análisis de enlaces Trata de establecer vínculos, denominados asociaciones, entre los registros individuales ó entre los conjuntos de registros de una BD. Hay tres tipos: a) descubrimiento de asociaciones: trata de encontrar elementos que impliquen la presencia de otros elementos en el mismo suceso; b) descubrimiento de patrones secuenciales: trata de encontrar patrones entre sucesos tales que la presencia de un conjunto de elementos es seguida por otro conjunto de elementos en una BD de sucesos a lo largo de un período de tiempo; y c) descubrimiento de secuencias temporales similares: se utiliza para descubrir enlaces entre dos conjuntos de datos que sean dependientes del tiempo, y está basado en el grado de semejanza exhibido por ambas series temporales. 4. Detección de desviaciones Técnica novedosa que identifica las excepciones: que expresa la desviación con respecto a una cierta expectativa ó a una norma previamente conocida. El proceso de Minería de Datos Existe una especificación denominada Proceso estándar intersectorial para la minería de datos (CRoss Industry Standard Process for Data Mining – CRISP-DM) cuyo objetivo es hacer que los grandes proyectos de DM funcionen de manera eficiente y que sean mas baratos, fiables y con mejor factibilidad de gestión. La metodología CRISP-DM es un modelo de proceso jerárquico. El proceso se divide en seis fases genéricas: a) Comprensión del negocio: Se centra en comprender los requisitos y objetivos del proyecto desde la perspectiva del negocio. b) Comprensión de los datos: Incluye la recopilación inicial de datos y se preocupa por establecer sus principales características. c) Preparación de los datos: Actividades para construir el conjunto final de datos al que pueden aplicársele las herramientas de modelado. d) Modelado: Propiamente Minería. Implica seleccionar las técnicas de modelado, los parámetros y evaluar el modelo. e) Evaluación: Valida el modelo desde el punto de vista del análisis de datos. f) Implantación: El conocimiento obtenido y reflejado en el modelo tiene que organizarse y presentarse de una manera comprensible por parte de los usuarios. Herramientas Las características más importantes son: 1) Preparación de los datos: Aspecto que demanda mayor tiempo. Puede dar soporte a operaciones de limpieza, transformación, etc., de datos, así como para muestreo con vistas a la creación de conjuntos para entrenamiento y validación, etc. 2) Selección de las operaciones (algoritmos) de minería de datos: Su comprensión asegurará que cumplan los requisitos que demandan los usuarios. Es importante conocer como los distintos algoritmos tratan los tipos de datos de las variables de respuesta y variables predictoras (columnas de la BD que pueden usarse para construir un modelo predictor de los valores de otra columna), la rapidez con que llevan a cabo la fase de entrenamiento y la velocidad con que Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 15

- 16. Minería de Datos operan sobre nuevos datos. Debe analizarse su sensibilidad al ruido (diferencia entre un modelo y sus predicciones), establecer sensibilidad a la falta de datos de un algoritmo dado y robustez de patrones que dicho algoritmo descubre en presencia de datos irrelevantes ó incorrectos. 3) Escalabilidad y prestaciones del producto: Consideraciones importantes cuando se trabaja con datos crecientes en términos del número de filas ó columnas, posiblemente con controles de validación sofisticados. Puede demandar el uso de tecnologías de multiprocesamiento simétrico (Symmetric Multi Processing – SMP) ó de procesamiento masivamente paralelo (Massively Parallel Processing – MPP) 4) Funcionalidades para comprender los resultados, proporcionadas mediante medidas que describan la precisión y lo significativo de los datos, permitiendo que el usuario analice la sensibilidad del resultado. También es útil la presentación de resultados con el empleo de varias maneras alternativas, por ejemplo, visualmente. Una matriz de confusión muestra el número real de valores de una clase comparándolo con el número predicho. Ilustra la capacidad predictiva del modelo y presenta los detalles necesarios para ver donde pudiera estar fallando. El análisis de sensibilidad determina la sensibilidad del modelo respecto a pequeñas fluctuaciones de un valor predictor. Permite evaluar los efectos que tienen el ruido y los cambios ambientales sobre la precisión del modelo. Las técnicas de visualización permiten mostrar los datos gráficamente para facilitar la comprensión de su significado. Las capacidades van desde las simples gráficas de dispersión hasta representaciones multidimensionales complejas: Minería de datos y almacenes de datos Un desafío principal para las organizaciones es identificar los datos más adecuados para aplicar estas técnicas. La Minería de Datos necesita una fuente de datos unificada, independiente, limpia, integrada y auto coherente. Un almacén de datos está bien preparado para proporcionar los datos requeridos por la Minería de Datos. Fuente: Connolly,T.M. y Begg,C.E. “Sistemas de BD” Pearson, 2005; Parte 9: Capítulos 31 al 34; pp 1035-1127 Resumido por: Dr. Juan José Aranda Aboy Profesor Titular (Grado 5) 16